Bonjour à tous et à toutes, ami(e)s du Framablog !

Par un heureux hasard du calendrier, la publication de cette nouvelle chronique Librologique coïncide avec le vingtième anniversaire du noyau Linux. Après nous être intéressés à Richard Stallman, c’est donc le moment idéal pour nous pencher sur une autre personnalité marquante du logiciel Libre… Quant à moi, je vous retrouve la semaine prochaine… et d’ici là, dans les commentaires !

V. Villenave.

Librologie 2 : Linus a gagné

Il y a tout juste vingt ans, un jeune étudiant en informatique finlandais, Linus Torvalds[1], publie un bout de programme qui deviendra plus tard le noyau du système d’exploitation le plus répandu au monde.

Il y a tout juste vingt ans, un jeune étudiant en informatique finlandais, Linus Torvalds[1], publie un bout de programme qui deviendra plus tard le noyau du système d’exploitation le plus répandu au monde.

Plus ou moins fortuite, cette édification se fera par tâtonnements mais Linus sait ce qu’il veut et ne se prive pas de le faire savoir : au fil des ans, il se fera remarquer par un nombre impressionnant de citations toujours abruptes, souvent désopilantes, qui en sont venues à constituer sa marque de fabrique, voire sa persona : lire un message de Linus sans pique ni acidité, est toujours décevant.

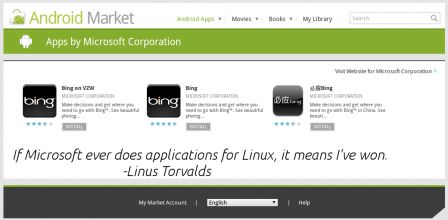

Parmi ses souffre-douleurs de prédilection, on trouve des programmes (Emacs, GNOME), des techniques de programmation (le langage C++, les micronoyaux, le système de fichiers HFS+), et des entreprises (SCO, Oracle, Microsoft). Il est particulièrement réjouissant pour tout Libriste de voir Torvalds s’en prendre à l’empire de Microsoft, dont la domination hégémonique sur les systèmes d’exploitation remonte aux origines de l’informatique personnelle (et dont la haine des principes Libres n’est plus à démontrer) :

Je vous assure que mon but n’est pas de détruire Microsoft. Ce sera un effet collatéral tout à fait involontaire.

Ou, dans un même ordre d’idées :

Le jour où Microsoft développera des applications pour Linux, cela voudra dire que j’aurai gagné.

Le noyau Linux a donc été fondé il y a plus de vingt ans, et vient d’atteindre sa troisième version majeure. Se combinant avec d’autres programmes du projet GNU, il forme le système d’exploitation GNU/Linux qui s’est répandu dans le monde, particulièrement dans les domaines des serveurs et des supercalculateurs, qu’il domine très largement. Sous une forme plus réduite, le noyau Linux est également embarqué dans la grande majorité des équipements informatiques domestiques et professionnels : télévisions, box Internet, ordinateurs de bord… Enfin il s’est aussi emparé des téléphones mobiles, en particulier avec le système Android développé par l’entreprise Google.

Ce dernier point est d’une actualité brûlante, puisqu’Android est en pleine ascension et dépasse à la fois les mobiles proposés par Microsoft et les iPhone® d’Apple. Les applications Android se multiplient et sont devenues un format de distribution incontournable… y compris pour les concurrents de Google… ce qui inclut Microsoft.

Ce qui nous renvoie, comme l’ont remarqué de nombreux commentateurs ces derniers jours, à la citation que nous évoquions à l’instant :

Le paysage a changé. Les marchés à conquérir ne se situent plus sur le bureau des utilisateurs, mais dans les téléphones portables et le « nuage » des services Internet. Microsoft n’a plus, aujourd’hui, d’autre choix que de présenter des applications pour Android, et même de contribuer au code de Linux. Il tire davantage de profit des ventes d’Android que de son propre système d’exploitation mobile.

En d’autres termes, nous y sommes : Linus a gagné.

Ce qui explique l’enthousiasme des Libristes et inconditionnels de l’open source. Le projet Linux, rappelons-le, est développé par une communauté d’informaticiens du monde entier, dont beaucoup sont financés par de grandes entreprises (voir plus bas), mais dont une proportion conséquente est faite de bénévoles qui gagnent leur vie dans des domaines parfois étrangers à l’informatique. De là à voir en la personne de Linus Torvalds un hérault du pro-am il n’y a qu’un pas : la victoire de Linus sur Microsoft serait ainsi une revanche de l’illégitimité.

Joie et liesse : Linus a gagné.

Certes, mais à quel prix ?

D’un point de vue technique, le système Android est certes construit sur le noyau Linux, mais il y apporte une surcouche sous une licence différente, qui ne garantit pas la réciprocité du logiciel Libre digne de ce nom. Des commentateurs ont d’ailleurs fait remarquer combien le développement d’Android diffère de celui de Linux en particulier, et des logiciels Libres en général.

D’un point de vue éthique, le noyau Linux est resté sous la version 2 de la licence GPL, ce qui autorise bien des abus d’un point de vue Libriste : des versions modifiées peuvent en être distribuées sans nécessairement rendre publiques lesdites modifications, les serveurs sous GNU/Linux servent à des sites qui privatisent les données, et assujettissent leurs utilisateurs. Linux a sans doute « gagné », mais certainement pas les libertés civiques — même si le PDG de la Linux Foundation s’en défend.

Ce qui nous invite à nous interroger sur les modalités d’expression de la persona publique de Linus Torvalds. D’une génération (et d’une culture politique) différente de celle de Richard Stallman, il s’oppose volontiers à ce dernier, notamment sur le plan terminologique (dont nous avons vu combien il importe à

Ce qui nous invite à nous interroger sur les modalités d’expression de la persona publique de Linus Torvalds. D’une génération (et d’une culture politique) différente de celle de Richard Stallman, il s’oppose volontiers à ce dernier, notamment sur le plan terminologique (dont nous avons vu combien il importe à rms). Parangon du mouvement open source, il se construit une persona inversée (et donc symétrique) de celle de Stallman, et se décrit complaisamment comme non-idéologue et « pragmatiste » — qualificatif que Stallman lui-même, paradoxalement, revendique également — nous y reviendrons.

Attardons-nous un instant sur cette posture à travers trois fragments relativement longs du discours de Torvalds, dont nous allons voir qu’il va bien au-delà des citations-choc.

Je ne crois pas qu’il y ait d’idéologie (dans le projet Linux), et je ne crois pas qu’il *devrait* y avoir d’idéologie. Et ce qui compte ici, c’est le singulier — je pense qu’il peut exister *beaucoup* d’idéologies. Je le fais pour mes propres raisons, d’autres gens le font pour les leurs. Je pense que le monde est un endroit compliqué, et que les gens sont des animaux intéressants et compliqués qui entreprennent des choses pour des raisons complexes. Et c’est pour cela que je ne crois pas qu’il devrait y avoir *une* idéologie. Je pense qu’il est très rafraîchissant de voir des gens travailler sur Linux parce qu’ils peuvent rendre le monde meilleur en propageant la technologie et en la rendant accessible à plus de monde — et ils pensent que l’open source est un bon moyen d’accomplir cela. C’est _une_ idéologie. Et une excellente, pour moi. Ce n’est pas vraiment pour cette raison que j’ai entrepris Linux moi-même, mais cela me réchauffe le cœur de le voir utilisé en ce sens. Mais je pense _aussi_ qu’il est génial de voir toutes ces entreprises commerciales utiliser de l’open source tout simplement parce que c’est bon pour les affaires. C’est une idéologie entièrement différente, et je pense qu’elle est, elle aussi, parfaitement acceptable. Le monde serait _nettement_ pire si l’on n’avait pas d’entreprises réalisant des choses pour de l’argent. Aussi, la seule idéologie qui m’inspire vraiment du mépris et de l’aversion est celle qui consiste à exclure toutes les autres. Je méprise les gens dont l’idéologie est « la seule véritable », et pour qui s’éloigner de ces règles morales en particulier est « mal » ou « malfaisant ». Pour moi, c’est juste mesquin et stupide. Donc, le plus important dans l’open source, n’est pas l’idéologie — il s’agit simplement que tout le monde puisse l’utiliser pour ses propres besoins et ses propres raisons. La licence de copyright sert à maintenir en vie cette notion d’ouverture, et à s’assurer que le projet ne se fragmente pas au fil des gens qui garderaient cachées leur améliorations, et donc doivent ré-inventer ce qu’ont fait les autres. Mais la licence n’est pas là pour imposer telle ou telle idéologie.

Ces propos de Torvalds méritent d’être ici reproduits in extenso. Tout d’abord parce qu’ils suffisent à mettre en mouvement notre détecteur de mythes : on y retrouve une vision prétendument « naturelle » des choses, ainsi qu’une propension à s’abstraire de toute implication ou responsabilité éthique : « le mythe, écrit Roland Barthes, est une parole dépolitisée ». Et de fait, il n’est pas rare qu’un discours qui rejette toute idéologie ait pour fonction de masquer une idéologie sous-jacente, le plus souvent contre-révolutionnaire : nous y reviendrons prochainement.

Est-ce le cas ici ? Linus Torvalds prête certainement le flanc à de telles accusations, en particulier dans ses rapports vis-à-vis des grandes entreprises (le développement de Linux, et le salaire de Linus lui-même, a fait l’objet de nombreux financements d’entreprises, en particulier IBM).

Cependant son point de vue ne me semble pas dépourvu d’ambiguïtés : ainsi, loin de les rejeter, il prend acte des motivations « idéologiques » de certains contributeurs et utilisateurs, et s’en déclare même proche.

Autre ambiguïté primordiale : Torvalds est, et demeure, cet informaticien brillant qui prit un jour la décision, là où rien ne l’y obligeait, de publier son travail sous une licence Libre (la GPL), dans le but explicite d’ouvrir au monde entier, sans distinction de provenance ni de capital, des outils techniques (et par extension, une forme de connaissance, comme nous allons également le voir) :

À l’origine, explique-t-il en 1997, j’avais publié Linux et son code source complet sous un copyright qui était en fait bien plus contraignant que la GPL : il n’autorisait aucun échange d’argent quel qu’il soit (c’est-à-dire que non seulement je ne voulais pas essayer d’en tirer profit moi-même, mais j’interdisais à quiconque de le faire).

(…)

Je voulais que Linux soit aisément disponible sur ftp, et je voulais qu’il ne soit onéreux pour _personne_. (…) Je ne me sentais pas rassuré vis-à-vis de la GPL au début, mais je voulais témoigner ma reconnaissance pour le compilateur GCC (du projet GNU) dont Linux dépendait, et qui était bien sûr GPL.

Rendre Linux GPL est sans aucun doute la meilleure chose que j’aie jamais faite.

Les paradoxes ne manquent pas ici, à commencer par cette reconnaissance qu’exprime spontanément Linux Torvalds envers le projet GNU, lui qui se refusera pourtant toujours à dire « GNU/Linux » plutôt que seulement « Linux » pour désigner le système d’exploitation Libre… Autre paradoxe intéressant au plus haut point : nous voyons ici que c’est la licence GNU GPL qui est venue libérer Linus lui-même de ses craintes, en particulier vis-à-vis de l’exploitation commerciale de son travail.

Le dernier fragment sur lequel je voudrais m’arrêter ici est une interview recueillie dix ans plus tard, sur laquelle Torvalds revient sur sa (non-) « idéologie » personnelle :

Je pense que l’open source est la bonne voie à suivre, de la même façon que je préfère la science à l’alchimie : tout comme la science, l’open source permet aux gens d’ajouter leur pierre à l’édifice solide de la connaissance pré-existante, plutôt que de se cacher de manière ridicule.

Cependant je ne crois pas qu’il faille considérer l’alchimie comme « malfaisante ». Elle est juste hors de propos : on ne pourra évidemment jamais réussir aussi bien barricadé chez soi qu’au grand jour avec des méthodes scientifiques.

C’est pourquoi la FSF (de Richard Stallman) et moi divergeons sur des notions fondamentales. J’adore absolument la GPL version 2 — qui incarne ce modèle de « développer au grand jour ». Avec la GPL v.2, nous tenions quelque chose où tout le monde pouvait se retrouver et partager selon ce modèle.

Mais la FSF semble vouloir changer ce modèle, et les ébauches de la GPL version 3 ne servent plus à développer du code au grand jour mais à déterminer ce que l’on peut faire de ce code. Pour reprendre l’exemple de la science, cela reviendrait à dire que non seulement la science doit être ouverte et validée par des pairs, mais qu’en plus on vous interdit de vous en servir pour fabriquer une bombe.

Et ce dernier exemple de « fabriquer des bombes » donne lieu, à son tour, à un nouveau paradoxe : les arguments soulevés ici par le créateur du noyau Linux trouvent un écho frappant dans certaines prises de position de… Richard Stallman. J’en veux pour illustration la critique toute pragmatique que fait la FSF d’une licence « Hacktiviste », la HESSLA, dont le propos est précisément d’interdire tout usage des logiciels qui ne serait pas conforme aux droits de l’Homme (dans un même ordre d’idées, on lira avec intérêt la licence CrimethInc. N© !, que je découvre à l’instant et qui vaut également son pesant de cacahuètes). Un autre exemple du pragmatisme de Stallman est à trouver dans la migration de Wikipédia vers les licences Creative Commons en 2008.

Le pragmatisme n’est donc pas nécessairement une posture de mercenaire, et le discours de Linus Torvalds (particulièrement si on le considère sur les deux décennies écoulées) me semble plus ambigu que celui d’un programmeur sans éthique ou d’un entrepreneur sans foi ni loi. Certes, Torvalds n’est ni un intellectuel ni un philosophe, et sa culture politique semble celle d’un simple spectateur. Cependant son propos apparaît comme pleinement politique, même lorsqu’il s’agit d’affirmer la neutralité idéologique du code qu’il écrit :

Je n’aime pas les DRM moi-même, mais en fin de compte je me vois comme un « Oppenheimer ». Je refuse que Linux soit un enjeu politique, et je pense que les gens peuvent utiliser Linux pour tout ce qu’ils veulent — ce qui inclut certainement des choses que je n’approuve pas personnellement.

La GPL exige qu’on publie les sources du noyau, mais ne limite pas ce qu’on peut faire avec le noyau. Dans l’ensemble, ceci est un exemple de plus de ce pourquoi rms me traite de « seulement un ingénieur », et pense que je n’ai pas d’idéaux.

(En ce qui me concerne, ce serait plutôt une vertu : essayer d’améliorer le monde un tant soit peu sans essayer d’imposer ses propres valeurs morales aux autres. Vous pouvez faire ce qui vous chante, je m’en fous, je suis seulement un ingénieur qui veut faire le meilleur système d’exploitation possible.)

Cette position me renvoie à la phrase faussement attribuée à Voltaire sur la liberté d’expression (« je ne suis pas d’accord avec ce que vous dites, mais je me battrai jusqu’à la mort pour que vous ayez le droit de le dire »), et qui est en fait d’origine anglo-saxonne. L’on sait combien cet esprit post-Lumières (d’ailleurs plus ou moins bien compris), qui défend la liberté comme un absolu, est important aux États-Unis : peut-être n’est-ce pas un hasard si c’est dans ce pays qu’est né le mouvement Libre… Et si c’est de ce même pays que Torvalds a récemment acquis la nationalité.

Alors, Linus a-t-il gagné ? Pour un personnage aussi marquant et aussi vocal, il est étrange qu’on ne l’ait que très peu entendu s’exprimer sur l’avènement d’Android. La sortie du noyau Linux version 3, coincidant avec le 20e anniversaire du projet, s’est faite dans le calme et avec une humilité remarquable, et j’avoue n’avoir vu passer aucun message de Linus Torvalds revendiquant sa « victoire » — laquelle est pourtant acquise et incontestable, pour douce-amère qu’elle puisse être par ailleurs.

Linux a gagné, mais seulement en se rendant acceptable par les entreprises : c’est-à-dire sous une forme dégradée, aseptisée, dépolitisée dirait Barthes, débarrassée du « bazar » idéologique que représente le mouvement Libre, et que d’aucuns (à commencer par Richard Stallman) voient comme essentiel. Essentiel d’un point de vue intellectuel, puisque le mouvement Libre se pense originellement comme un mouvement social ; primordial également d’un point de vue affectif, le logiciel et la culture Libre reposant souvent sur des communautés de bénévoles dont la motivation n’est jamais tout à fait exempte de composantes idéalistes ou romantiques — et auxquelles Linus lui-même, nous l’avons vu, n’a pas toujours été étranger.

Ce sont ces valeurs et cet esprit que voile, sous l’aspect d’une victoire technique, l’avènement du noyau Linux sous ses avatars et déclinaisons plus ou moins lointaines. Et la victoire que promettait le jeune Linus d’il y a vingt ans, semble aujourd’hui faire tristement défaut au triomphe d’un Torvalds quadragénaire.

Il y a tout juste vingt ans, un jeune étudiant en informatique finlandais,

Il y a tout juste vingt ans, un jeune étudiant en informatique finlandais,

Ce qui nous invite à nous interroger sur les modalités d’expression de la persona publique de Linus Torvalds. D’une génération (et d’une culture politique) différente de celle de

Ce qui nous invite à nous interroger sur les modalités d’expression de la persona publique de Linus Torvalds. D’une génération (et d’une culture politique) différente de celle de  Tout le monde connaît le fameux discours

Tout le monde connaît le fameux discours

Il est désormais acquis qu’une expérience de contributeurs dans une ou plusieurs communautés du logiciel libre est un atout dans le secteur professionnel informatique. Mais, dans ce monde qui bouge et qui commence à mettre de l’« open » à toutes les sauces, elle pourrait l’être également bien au-delà.

Il est désormais acquis qu’une expérience de contributeurs dans une ou plusieurs communautés du logiciel libre est un atout dans le secteur professionnel informatique. Mais, dans ce monde qui bouge et qui commence à mettre de l’« open » à toutes les sauces, elle pourrait l’être également bien au-delà. C’est un billet très HOT que nous vous proposons aujourd’hui. Mais HOT pour

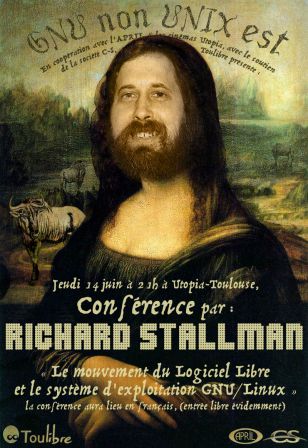

C’est un billet très HOT que nous vous proposons aujourd’hui. Mais HOT pour  Au confluent de nombreux phénomènes communautaires (qu’il a d’ailleurs lui-même suscités), la personne de Richard Matthew Stallman, communément désigné par ses initiales

Au confluent de nombreux phénomènes communautaires (qu’il a d’ailleurs lui-même suscités), la personne de Richard Matthew Stallman, communément désigné par ses initiales  Certainement influencé par ces courants en son temps, et lui-même athée revendiqué, Richard Stallman s’est employé à subvertir à sa façon les codes des rituels religieux : ainsi de sa brillante idée de célèbrer, tous les 25 décembre,…

Certainement influencé par ces courants en son temps, et lui-même athée revendiqué, Richard Stallman s’est employé à subvertir à sa façon les codes des rituels religieux : ainsi de sa brillante idée de célèbrer, tous les 25 décembre,…  Une des constantes du folklore stallmanien, qui marque (et amuse) toujours quiconque assiste à une des nombreuses conférences que

Une des constantes du folklore stallmanien, qui marque (et amuse) toujours quiconque assiste à une des nombreuses conférences que  C’est en ce sens que doivent être lues, je pense, les pages « philosophie » du projet GNU : il ne s’agit bien évidemment pas d’ouvrages philosophiques au sens où l’entendent, par exemple, les universitaires et chercheurs en philosophie. Richard Stallman ne propose pas de redéfinir notre vision du monde, et son « apport » à la philosophie, si tant est même qu’il existe, se limite à rappeler des notions simples de droits de l’Homme, de partage et d’entraide, sur lesquelles se fondent le

C’est en ce sens que doivent être lues, je pense, les pages « philosophie » du projet GNU : il ne s’agit bien évidemment pas d’ouvrages philosophiques au sens où l’entendent, par exemple, les universitaires et chercheurs en philosophie. Richard Stallman ne propose pas de redéfinir notre vision du monde, et son « apport » à la philosophie, si tant est même qu’il existe, se limite à rappeler des notions simples de droits de l’Homme, de partage et d’entraide, sur lesquelles se fondent le