Il y a 3 ans nous traduisions un article issu du blog de Google et rédigé par l’un de ses hauts gradés Jonathan Rosenberg : The meaning of open. Il y expliquait pourquoi et comment la célèbre entreprise prônait l’ouverture à tous ses étages.

Le même auteur récidive ici en dépassant la problématique Google pour affirmer non sans un certain optimisme (à l’américaine) que c’est le futur tout entier qui est désormais ouvert et que c’est très bien comme ça.

Remarque 1 : Nous avons choisi de traduire tout du long « open » par « ouverture » ou « ouvert ». L’adéquation n’est pas totalement satisfaisante, mais laisser le terme d’origine en anglais eut été selon nous plus encore source de confusion.

Remarque 2 (troll et hors-sujet ?) : À comparer avec la situation française où l’on semble actuellement beaucoup plus préoccupé de savoir ce que nous prend ou nous donne l’État que de promouvoir ou pratiquer l’ouverture. Sans oublier, évidemment, la fameuse taxe Google qui « sauvera » la presse !

Le futur est ouvert

The Future Is Open

Jonathan Rosenberg – octobre 2012 – ThinkWithGoogle.com

(Traduction Framalang : nobo, peupleLa, KoS, Smonff, ehsavoie, tibs, Louson, goofy, Khyvodul, Pandark, lgodard, Kiwileaks)

Il y a trois ans, Jonathan Rosenberg, alors vice-président délégué à la gestion de la production, a écrit un mémo (NdT : que nous avions traduit) expliquant pourquoi les entreprises ouvertes seraient les gagnantes du futur. Aujourd’hui, consultant au service du management, il a vu la réalité dépasser ses rêves les plus fous.

Il y a bientôt trois ans, en décembre, j’ai envoyé un courriel à mes chers collègues de Google, pour essayer de donner une définition claire d’un terme galvaudé : Ouvert. Je trouvais gênant qu’entre nos murs, il prenne différents sens selon les personnes, et que trop de Googlers ne comprennent pas l’engagement fondamental de l’entreprise pour ce qui est ouvert. En me référant à la fois aux technologies ouvertes et aux informations ouvertes, j’ai présenté la philosophie sous-jacente à notre volonté de transparence. Rechercher des systèmes ouverts, avais-je argumenté, nous a menés, et continuera de nous mener vers deux résultats souhaitables : Google devient meilleur, et le monde avec lui.

L’argument était convaincant, et plus tard, un billet sur le blog de Google , « The Meaning of Open », permit de clarifier encore plus ce concept parfois difficile à appréhender. Dans les semaines qui ont suivi, j’ai reçu des messages pleins de profondeur de la part d’un public divers et varié : enseignants ou écrivains qui appréciaient ce point de vue de l’intérieur de Google, chefs d’entreprise qui m’expliquaient comment l’ouverture avait influencé leurs affaires, étudiants surpris d’une position qui allait entièrement à l’encontre de la stratégie de fermeture qu’on leur avait enseignée. Trois ans ont passé, et ce qui me saute aux yeux dans ce manifeste c’est que… j’avais tort !

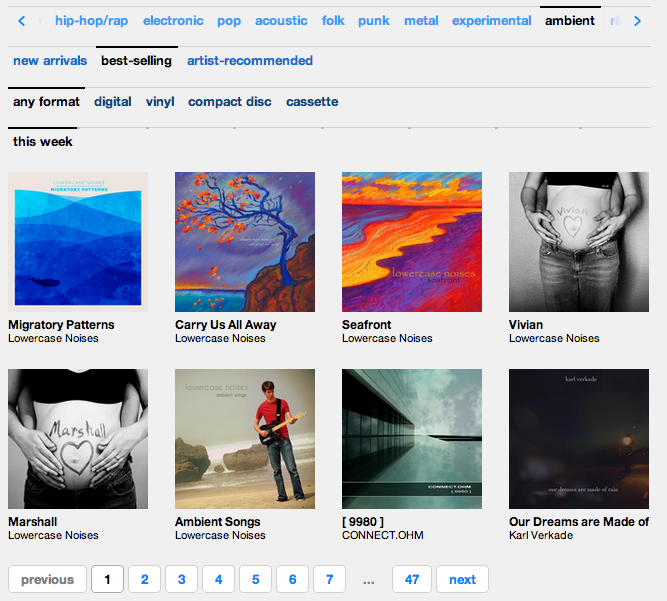

On ne peut pas dire que le développement ouvert n’ait pas fait progresser Google et le reste du monde. Seulement c’est arrivé beaucoup plus vite que je ne l’avais imaginé. C’est au beau milieu d’un des gestes les plus banals du vingt-et-unième siècle que j’en ai pris conscience : je vérifiais mon téléphone, un Droid Razr Maxx. Je fixais la chose, et j’en voyais toute la diversité : deux douzaines d’applications, du New York Times à Flipboard, de Dialer One à OpenTable, de RunKeeper à SlingPlayer, créées par un tas de développeurs différents, sur un téléphone conçu par Motorola. Il m’est apparu que ce que je regardais n’était pas simplement un appareil mobile, mais l’incarnation physique de la façon dont un écosystème ouvert peut se disséminer à travers le monde presque du jour au lendemain.

Sans aucun doute, j’ai toujours senti que cette idée tenait debout – mais je n’avais pas anticipé l’ampleur avec laquelle les règles du jeu entre les secteurs privés et publics allaient être réécrites. C’est la conséquence de trois tendances techniques qui ont évolué à une vitesse étonnante. Premièrement : Internet rend l’information plus libre et omniprésente que ce que j’aurais pu croire ; pratiquement tout ce qui se passait hors ligne est maintenant en ligne. Deuxièmement : ce qui était une vision du potentiel des mobiles est vraiment devenu réalité, puisque les machines sont devenues plus puissantes et plus rapides que prévu, facilitant une portée globale et une connectivité sans précédent. Troisièmement : l’informatique dans le nuage (NdT : Cloud computing) a permis une puissance de calcul infinie à la demande. Et nous sommes loin d’avoir fini. Alors même que j’écris ces lignes, Google Fiber s’apprête à déployer un service à un gigabit à Kansas City, indice que la connectivité est sur le point de franchir une nouvelle limite.

La conjonction de ces progrès techniques a un effet paradoxal : aussi nouveaux soient-ils, ils finissent par ramener les entreprises aux fondamentaux. La gamme et la qualité des produits sont maintenant les facteurs les plus importants pour déterminer le succès d’une entreprise. Historiquement, les entreprises pouvaient profiter d’une pénurie d’information, de connectivité ou de puissance de calcul pour attirer et conserver leurs clients et repousser les concurrents.

De nos jours, les clients peuvent prendre des décisions bien plus éclairées en accédant aux informations des autres consommateurs. En effet, ils renforcent mutuellement leur pouvoir de décision par leurs échanges via des sites comme Yelp et toute une flopée de réseaux sociaux. Une société ne peut plus complètement contrôler l’environnement de ses clients. Au moment où les frontières de la distribution se sont effondrées – pensez aux moyens de transports mondialisés et bon marché, pensez aux étalages infinis des détaillants en ligne – les consommateurs ont de plus en plus de contrôle par eux-mêmes. Avec ce nouveau paradigme, et des marchés toujours plus compétitifs, les sociétés n’ont plus d’autre choix que de se concentrer sur la qualité et les gammes de produits. Si elles ne le font pas, une autre le fera à leur place.

Avec autant de changements en si peu de temps la nécessité de l’ouverture s’est imposée comme une tactique commerciale décisive pour atteindre à la fois l’excellence et la déclinaison des produits. Ouvrir un produit à toute une armée de créatifs est le plus court chemin pour créer de l’innovation et de la diversité, puisque cela permet à chaque contributeur de se focaliser sur ce qu’il fait le mieux et que cela encourage les contributions d’un public le plus large possible.

Chrome et Android, qui ont tous deux décollé depuis que « The Meaning of Open » a été publié, illustrent parfaitement ce principe. Avec chacun d’eux, nous avons maintenu un seul objectif simple dès le début : rendre le produit aussi robuste que possible. Comme nous l’avons appris maintes et maintes fois, il n’y a pas de route plus rapide et plus fiable qu’une route ouverte : davantage de mains travaillant sur un même produit ne peuvent que l’améliorer. L’ouverture permet de prototyper un concept, ou de le tester dans ses toutes premières étapes. Qui plus est, les systèmes ouverts tolèrent mieux les défaillances – et attirent une communauté d’utilisateurs plus fidèles. Ils savent que la motivation première d’un système ouvert est l’excellence ; si la société essaie d’imposer un autre agenda, la communauté de développeurs le repérera immédiatement et se révoltera. En proposant un produit ouvert, la société renonce à la possibilité de faire autre chose que de le rendre meilleur pour l’utilisateur.

Les résultats parlent d’eux-mêmes. Si vous possédiez un smartphone en 2006, il y a des chances pour que « Blackberry » ou « Nokia » ait été inscrit dessus. Il y a encore trois ans, Android représentait à peine 5% du marché. Aujourd’hui nous avons dépassé les 51%, et il y a de fortes chances pour que votre smartphone ait été fabriqué par Samsung, HTC, Motorola ou un autre partenaire d’Android.

Android a même débarqué dans des secteurs que nous n’avions pas anticipés, tels que les téléviseurs, les voitures, les avions, et même les appareils domestiques. (Voyez Ouya, une nouvelle console de jeux vidéo basée sur Android. Sans un Android ouvert, ce genre d’innovation n’existerait pas). Il semble clair à présent que si vous vous investissez dans un système ouvert, vous vous engagez dans une compétition perpétuelle pour garder votre place d’innovateur principal.

La question de l’ouverture n’a pas été moins opérante pour le navigateur Chrome, qui s’est construit par dessus le projet open source Chromium. Aujourd’hui, Chrome est sept fois plus rapide qu’il ne l’était lorsqu’il a été lancé il y a à peine 4 ans, et le nouveau code est disponible pour le monde entier à mesure qu’il se développe. Travailler ainsi au grand jour rend plus difficile le fait d’avoir des agendas cachés ou quoi que ce soit de dissimulé ; faites mal les choses, et une communauté mondiale de développeurs vous repérera instantanément.

Faire de l’ouverture une tactique commerciale peut nécessiter de nouvelles compétences organisationnelles. La vitesse est primordiale, comme l’est la rigueur du processus de décision. Un écosystème ouvert encourage le bouillonnement d’idées. Or trouver de bonnes idées, c’est facile ; ce qui est difficile, c’est de choisir parmi elles. L’ouverture des données peut offrir un avantage concurrentiel important aux entreprises, mais seulement si elles sont correctement positionnées pour pouvoir en profiter. L’autre tactique — qui est notamment utilisée par Apple et nos équipes de recherche — est de garder le système plus fermé, et d’y exercer un contrôle total. Cette approche nécessite son propre jeu de compétences organisationnelles, au-delà de la vitesse d’exécution, puisque l’excellence du produit et son innovation prennent leur source uniquement en interne. Les deux approches peuvent évidemment toutes les deux réussir, mais selon notre expérience, quand il s’agit de construire une plateforme entière, l’ouverture est le chemin le plus sûr vers la réussite.

Heureusement, de plus en plus d’organisations perçoivent ce message. Dans Wikinomics, les auteurs Don Tapscott et Anthony D. Williams racontent l’histoire de Goldcorp, une entreprise de mines d’or de Toronto, qui semblait sur le déclin à la fin des années 90. Face à un marché en baisse, une foule de problèmes internes et ce qui semblait être un filon épuisé, le PDG Rob McEwen fit précisément l’inverse de ce que n’importe quel livre sur le business dirait : il commença par donner le peu que l’entreprise avait encore.

Plus exactement, il publia sur le site de l’entreprise 400 Mo d’informations concernant le site minier de 220 kilomètres carrés de Goldcorp. Plutôt que de conserver jalousement ses derniers lambeaux d’information propriétaire, il offrit un prix de 500,000$ à quiconque parviendrait à utiliser ces données, afin de trouver de l’or contenu dans le sol. Ce fut un énorme succès. Plus de 80% des cibles identifiées par le public donnèrent des quantités significatives d’or. Avec ce petit investissement initial, la société tira du sol l’équivalent plus de 3 milliards de dollars en or.

Évidemment, McEwen était seulement en train de s’accorder avec les principes profonds du mouvement open source. Dans les premiers jours confus de l’internet, une éthique d’universalité et d’égalitarisme s’était propagée. « Les jardins cernés de murs (NdT : Walled gardens), tout plaisants qu’ils soient, ne pourront jamais rivaliser en diversité, en richesse et en innovation avec le marché fou et palpitant du Web de l’autre côté du mur » a écrit Tim Berners-Lee, l’inventeur du World Wide Web. Google a toujours prospéré sur cette diversité, cette richesse et cette innovation. C’est ce qui nous a permis de lancer des créations comme Chrome et Android, et c’est ce qui a permis à une entreprise d’extraction vétuste d’éblouir le monde avec des succès similaires et pour des raisons similaires.

Aussi spectaculaire que soit l’histoire de Goldcorp, c’est seulement la partie émergée de l’iceberg. En effet, ce qui avait commencé comme un concept de geek au sein de communautés scientifiques s’est propagé dans tous les domaines, des affaires à la politique, de la santé à l’éducation et bien au-delà. Chez Google, nous envisageons un certain nombre de possibilités au-delà du secteur technique, où l’ouverture pourrait amener des progrès modestes et immenses à la fois.

L’éducation

De Stanford à la Corée, des universités et des enseignants du monde entier commencent à distribuer gratuitement des contenus éducatifs de très grande qualité sous licence libre. Qui plus est, des personnes vivant dans les endroits les plus reculés ont de plus en plus accès à ces contenus. La bande passante et la connectivité ont fait sauter de nombreuses barrières de la société en matière d’éducation.

Tout au bout d’un long chemin de terre à Bombay, un étudiant muni d’un téléphone peut maintenant suivre les cours du MIT au plus haut niveau. De façon tout aussi intéressante, ce même étudiant peut devenir professeur. Grâce à des organisations véritablement démocratiques, telles que la Khan Academy, une organisation à but non lucratif, qui propose en ligne plus de 3 000 cours en vidéo. Partout dans le monde des personnes peuvent à la fois disposer de et contribuer à une bibliothèque de ressources qui ne cesse de croître, depuis des leçons de physique jusqu’à des manuels de finance. Nous savons déjà à quel point l’éducation publique a transformé la société au cours du vingtième siècle. Les possibilités offertes par une éducation ouverte et en ligne semblent tout aussi illimitées.

Les gouvernements

Prétendre à la transparence gouvernementale est une chose mais des exemples comme celui du Canada avec sa Déclaration officielle de Gouvernement Ouvert, en sont une autre. Ce document reconnaît l’ouverture comme un état actif et non passif : il ne s’agit pas seulement de donner aux citoyens un libre accès aux données chaque fois que possible, mais bien de définir une « culture active de l’engagement » comme finalité de ces mesures.

Tandis que toujours plus de villes, de régions et de gouvernements fédéraux avancent dans cette direction, il y a tout lieu de croire que cela finira par payer financièrement (au moment où les données GPS ont été mises en libre accès public à la fin des années 80, par exemple, on estime que les services commerciaux qui en ont tiré parti ont contribué à hauteur de 67.6 milliards de dollars à la valeur économique des États-Unis). À l’inverse, on pourrait dire que lorsque le régime égyptien a verrouillé Internet en janvier 2011, cela a poussé les citoyens à descendre dans la rue pour avoir plus d’informations, et à venir grossir les foules de la place Tahrir. Il est ici probable que le retour à un système plus fermé ait accéléré la chute du gouvernement.

Le système de santé

PatientsLikeMe est un site de réseautage social de santé construit sur des bases de données ouvertes du Département de la Santé des États-Unis. Il ouvre la voie à d’autres initiatives, comme procurer aux patients des moyens de partager des informations et d’apprendre entre personnes souffrant de symptômes similaires. Les chercheurs pourraient également tirer profit de plus d’ouverture dans l’industrie.

L’ouverture des données sur la santé pourrait permettre à des études épidémiologiques à grande échelle de réaliser des percées importantes tout en mettant en place des garde-fous plus forts que jamais pour assurer au patient le respect de la confidentialité. En mettant à la disposition des chercheurs son registre des malformations congénitales, la Californie a permis aux médecins d’accéder à une mine d’informations relatives à l’impact des facteurs environnementaux sur la santé. Et bien sûr, Google Flu Trends a déjà prouvé sa pertinence pour analyser et prévoir l’arrivée d’un virus particulier, tout simplement en permettant que l’information soit partagée et rassemblée.

La science

Chercheurs, institutions, et agences de financement du monde entier commencent à prendre conscience qu’un meilleur partage et une meilleure collaboration sur les résultats de recherches scientifique peuvent mener à des recherches plus rapides, plus efficaces, de meilleure qualité et d’un meilleur impact général. En tant que commissaire européen, Neelie Kroes faisait récemment remarquer dans un discours sur la science et les politiques du libre en Europe, « les chercheurs, les ingénieurs et les petites entreprises ont besoin d’accéder aux résultats scientifiques rapidement et facilement. Si ce n’est pas possible, c’est mauvais pour les affaires ».

Un meilleur accès aux recherches scientifiques peut stimuler l’innovation dans le secteur privé et aider à résoudre des défis importants auxquels le monde doit faire face (les Google ‘Fusion Tables sont un outil que les scientifiques peuvent utiliser pour partager et collaborer sur des ensembles de donnés disparates). Pendant ce temps, l’ouverture dans le domaine scientifique signifie l’ouverture à de tout nouveaux participants. Après avoir échoué pendant plus d’une décennie à résoudre la structure d’une enzyme protéase provenant d’un virus ressemblant au SIDA, les scientifiques ont proposé le défi à la communauté des joueurs. En utilisant le jeu en ligne Foldit, les joueurs ont pu résoudre ce problème en trois semaines.

Les transports

En libérant les données des transports publics, les gouvernements permettent aux entrepreneurs de créer des applications basées sur ces données, et ainsi d’améliorer l’expérience des citoyens ; ces derniers peuvent également utiliser ces données ouvertes pour signaler des problèmes d’infrastructure. Chez Google, nous avons déjà pu observer comment cela fonctionne. Lorsque nous avons commencé à organiser les informations géographiques mondiales, nous avons constaté que, pour de nombreux endroits, il n’existait tout simplement pas de carte correcte. Nous avons donc créé MapMaker, un outil de cartographie participative qui permet à chacun de créer des annotations sur Google Maps. C’est avec cela qu’un réseau de citoyens cartographes est né, traçant en deux mois plus de 25 000 kilomètres de routes précédemment non cartographiées au Pakistan.

Les tendances technologiques convergentes sont maintenant sur le point de modifier, en fait elles ont déjà commencé à le faire, les domaines historiquement fermés, secrets et dormants. « L’avenir des gouvernements, c’est la transparence,» écrivais-je il y a un an, «L’avenir du commerce, c’est la symétrie de l’information. L’avenir de la culture, c’est la liberté. L’avenir de la science et de la médecine, c’est la collaboration. L’avenir du divertissement, c’est la participation. Chacun de ces avenirs dépend d’un Internet ouvert. »

Je mettrais juste un bémol. Étant donnés les changements radicaux auxquels nous avons assisté ces trois dernières années, le défi s’est déplacé. Nous devons viser plus loin même que l’Internet ouvert. Les institutions dans leur ensemble doivent continuer à adhérer à cette philosophie. Atteindre ces futurs objectifs ne sera pas chose facile. Mais je suis content de pouvoir dire que nous en sommes plus proches que jamais.

Crédit photo : John Martinez Pavliga (Creative Commons By)