Quand les recommandations YouTube nous font tourner en bourrique…

Vous avez déjà perdu une soirée à errer de vidéo en vidéo suivante ? À cliquer play en se disant « OK c’est la dernière… » puis relever les yeux de votre écran 3 heures plus tard… ?

C’est grâce à (ou la faute de, au choix !) l’algorithme des recommandations, une petite recette qui prend plein d’éléments en compte pour vous signaler les vidéos qui peuvent vous intéresser.

Guillaume Chaslot a travaillé sur cet algorithme. Il a même créé un petit outil open-source pour le tester, afin de valider sa théorie : ces recommandations nous pousseraient de plus en plus vers les « faits alternatifs » (ça s’appelle aussi une légende urbaine, un complot, une fiction, du bullshit… vous voyez l’idée.)

Le groupe Framalang a décidé de traduire cet article passionnant.

Ne soyons pas complotistes à notre tour. Cet article ne dit pas que Google veut nous remplir la tête de mensonges et autres légendes numériques. Il s’agirait là, plutôt, d’un effet de bord de son algorithme.

Nous ne doutons pas, en revanche, qu’un des buts premiers de Google avec ses recommandations YouTube est de captiver notre attention, afin de vendre à ses clients notre temps de cerveau disponible (et d’analyser nos comportements au passage pour remplir ses banques de données avec nos vies numériques).

Sauf qu’avec ce genre de vision (et de buts) à court/moyen terme, on ne réfléchit pas aux conséquences sur le long terme. Lorsque l’on représente l’endroit où une grande portion de notre civilisation passe la majeure partie de son temps… C’est problématique, non ?

Tout comme les révélations de Tristan Harris, ce témoignage nous rappelle que, même chez les géants du web, notre monde numérique est tout jeune, immature, et qu’il est grand temps de prendre du recul sur les constructions que nous y avons dressées : car chacun de ces systèmes implique ses propres conséquences.

(« Ce que vous possédez finit par vous posséder », une citation de Fight Club)

Comment l’I.A. de YouTube favorise les « faits alternatifs »

de Guillaume Chaslot, source : Medium.

Traduction : Jerochat, jaaf, dominix, mo, goofy, Asta, Opsylac, Nimanneau, audionuma, Lyn. + les anonymes

Les I.A. sont conçues pour maximiser le temps que les utilisateurs passent en ligne… Et pour ce faire, la fiction, souvent, dépasse la réalité.

Tout le monde a déjà entendu parler des théories du complot, des faits alternatifs ou des fake news qui circulent sur Internet. Comment sont-ils devenus si répandus ? Quel est l’impact des algorithmes de pointe sur leur succès ?

Ayant moi-même travaillé sur l’algorithme de recommandation de YouTube, j’ai commencé à enquêter, et je suis arrivé à la conclusion que le puissant algorithme que j’avais contribué à concevoir joue un rôle important dans la propagation de fausses informations.

Pour voir ce que YouTube promeut actuellement le plus, j’ai développé un explorateur de recommandations open source qui extrait les vidéos les plus recommandées sur une requête donnée. Je les ai comparées aux 20 premiers résultats venant de requêtes identiques sur Google et Youtube Search.

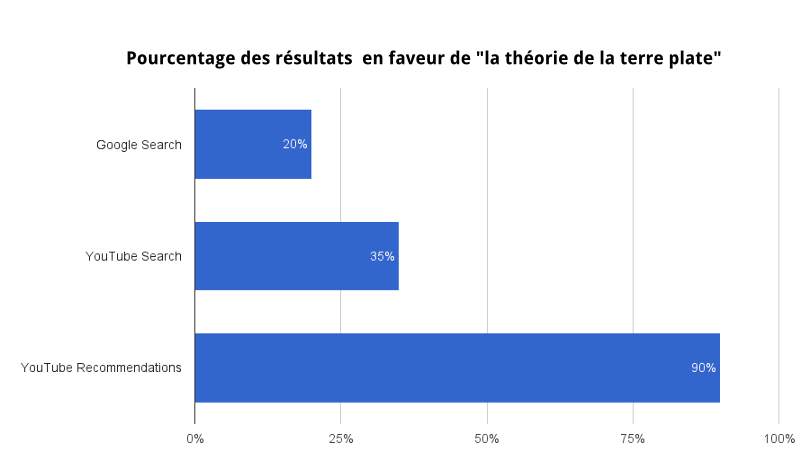

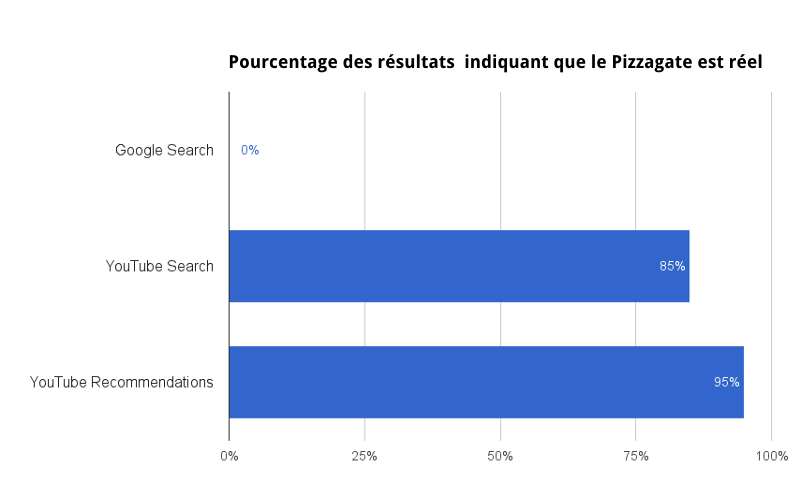

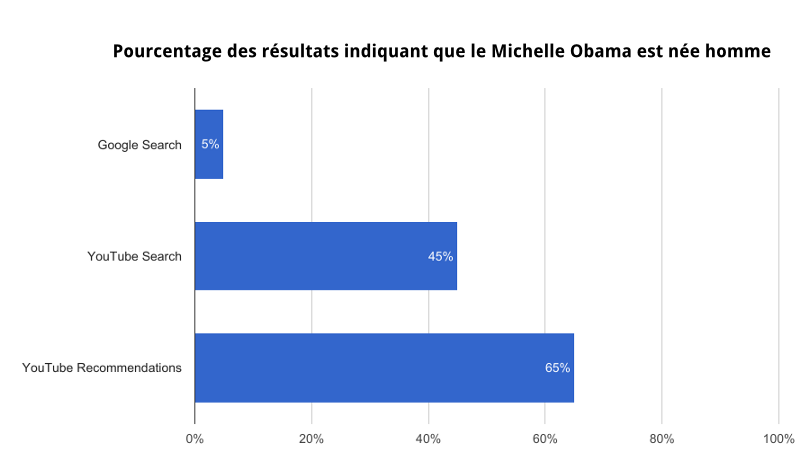

Les résultats sur les 5 requêtes suivantes parlent d’eux-mêmes :

1 — Question élémentaire : « La Terre est-elle plate ou ronde ? »

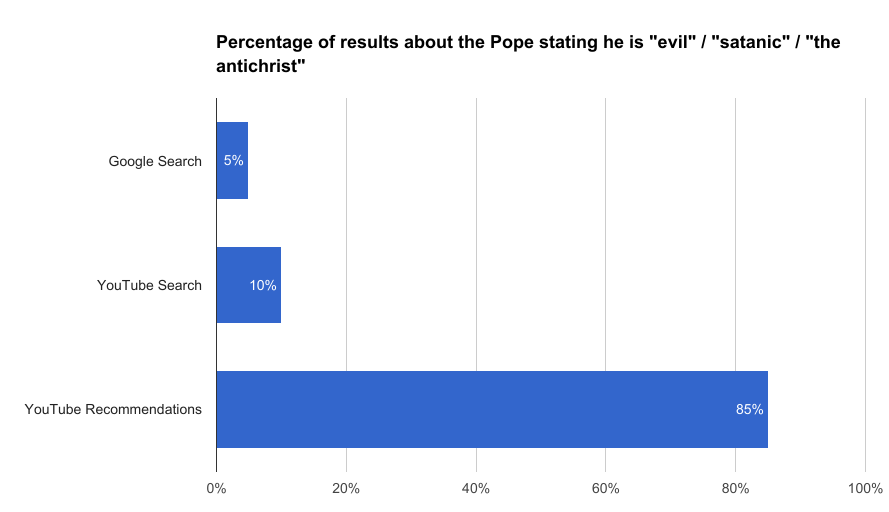

2 — Religion : « Qui est le Pape ? »

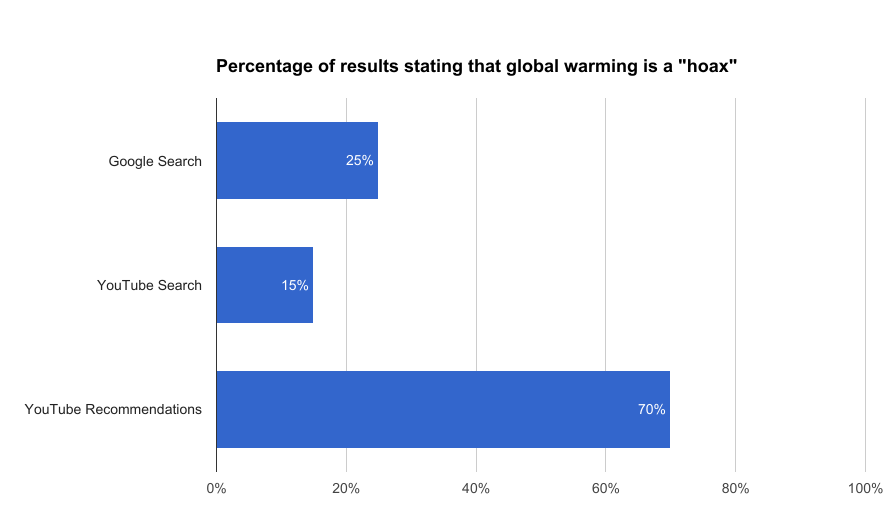

3 —Science : « Le réchauffement climatique est-il une réalité ? »

4 —Conspirations : « Est-ce que le Pizzagate est vrai ? »

Le Pizzagate est une théorie du complot selon laquelle les Clinton auraient été à la tête d’un réseau pédophile en lien avec une pizzeria de Washington. Des vidéos faisant la promotion de cette théorie ont été recommandées des millions de fois sur YouTube pendant les mois précédant l’élection présidentielle américaine de 2016.

5 — Célébrités: « Qui est Michelle Obama ? »

Pourquoi les recommandations sont-elles différentes des résultats de recherche ?

Dans ces exemples, une recherche YouTube et une recommandation YouTube produisent des résultats étonnamment différents, alors que les deux algorithmes utilisent les mêmes données. Cela montre que de petites différences dans les algorithmes peuvent produire de grosses différences dans les résultats. La recherche est probablement optimisée dans un objectif de pertinence, alors que les recommandations prennent sûrement davantage en compte le temps de visionnage.

YouTube ne recommande pas ce que les gens « aiment »

Étonnamment, on remarque que les « j’aime » ou « je n’aime pas » (pouce bleu ou rouge) ont peu d’impact sur les recommandations. Par exemple, beaucoup de vidéos qui prétendent que Michelle Obama est « née homme » ont plus de pouces rouges que de bleus, et pourtant elles sont toujours fortement recommandées sur YouTube. Il semble que YouTube accorde davantage d’importance au temps de visionnage qu’aux « j’aime ».

Ainsi, si « la Terre est plate » maintient les utilisateurs connectés plus longtemps que « la Terre est ronde », cette théorie sera favorisée par l’algorithme de recommandation.

L’effet boule de neige favorise les théories du complot.

Une fois qu’une vidéo issue d’une théorie du complot est favorisée par l’I.A., cela incite les créateurs de contenus à charger des vidéos supplémentaires qui confirment le complot. En réponse, ces vidéos supplémentaires font augmenter les statistiques en faveur du complot. Et ainsi, le complot est d’autant plus recommandé.

Finalement, le nombre important de vidéos qui soutiennent une théorie du complot rend cette dernière plus crédible. Par exemple, dans l’une des vidéos sur le thème de « la terre plate », l’auteur a commenté

Il y a 2 millions de vidéos sur la « terre plate » sur YouTube, ça ne peut pas être des c***!

Ce que nous pouvons faire

L’idée ici n’est pas de juger YouTube. Ils ne le font pas intentionnellement, c’est une conséquence involontaire de l’algorithme. Mais chaque jour, les gens regardent plus d’un milliard d’heures de contenu YouTube.

Parce que YouTube a une grande influence sur ce que les gens regardent, il pourrait également jouer un rôle important en empêchant la propagation d’informations alternatives, et le premier pas vers une solution serait de mesurer cela.

Faites des expériences avec l’explorateur de recommandations si vous souhaitez découvrir ce que YouTube recommande le plus au sujet des thèmes qui vous tiennent à cœur.