RGPD : la Quadrature au carré

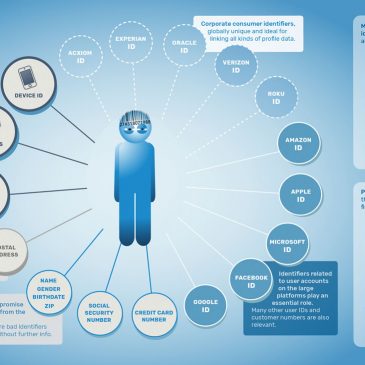

Le 16 avril dernier, la Quadrature du Net a lancé un appel inédit en France pour une action de groupe contre les GAFAM. Cette action s’appuiera sur l’application prochaine du Règlement général sur la protection des données (RGPD).