Dan Gillmor, qui avait l’an dernier expliqué pourquoi il disait au revoir à google, Microsoft et Apple dans un article que nous avons publié, fait aujourd’hui le point sur ses choix et constate qu’il ne regrette rien. D’autres bonnes raisons de migrer sont apparues, comme l’accélération de la re-centralisation du Web, l’hégémonie croissante des grands acteurs et bien sûr la surveillance généralisée.

Dan Gillmor évoque avec précision les matériels et logiciels qu’il a adoptés progressivement, fait état également sans à priori des avancées et des faiblesses des produits open source. Il reconnaît la difficulté relative du passage au Libre intégral (il peine encore à se dégoogliser 😉 ) mais les valeurs qu’il défend sont celles de l’indépendance, du choix libre pour l’utilisateur de ses usages et de ses produits…

Je suis passé à Linux et c’est encore mieux que ce que j’espérais

Dire adieu à Microsoft et Apple n’a jamais été aussi facile, ni aussi satisfaisant

par Dan Gillmor

Article original sur Medium : I Moved to Linux and It’s Even Better Than I Expected

Traduction Framalang : line, goofy, Sphinx, r0u, david_m, Manegiste, sebastien, teromene, galadas, roptat, Omegax, didimo

Un beau jour du printemps 2012, j’ai refermé mon MacBookAir pour la dernière fois. À partir de ce moment, mon environnement informatique (en tout cas, en ce qui concerne mon portable) était GNU/Linux. J’ai abandonné, autant que possible, les environnements propriétaires et obsédés du contrôle qu’Apple et Microsoft ont de plus en plus imposés aux utilisateurs d’ordinateurs personnels.

Un beau jour du printemps 2012, j’ai refermé mon MacBookAir pour la dernière fois. À partir de ce moment, mon environnement informatique (en tout cas, en ce qui concerne mon portable) était GNU/Linux. J’ai abandonné, autant que possible, les environnements propriétaires et obsédés du contrôle qu’Apple et Microsoft ont de plus en plus imposés aux utilisateurs d’ordinateurs personnels.

Presque quatre ans plus tard, me voici, et j’écris cet article sur un portable qui tourne sous le système d’exploitation Linux, avec LibreOffice Writer, et non sur une machine Mac ou Windows avec Microsoft Word. Tout va bien.

Non, c’est même mieux que ça, tout est sensationnel.

Je recommanderais ce changement à beaucoup de personnes (pas à tout le monde, ni à n’importe quel prix, mais à quiconque n’est pas effrayé à l’idée de poser une question à l’occasion, et plus particulièrement quiconque réfléchit à la trajectoire prise par la technologie et la communication au 21ème siècle). Plus que tout, aux gens qui se soucient de leur liberté.

Ils nous ont donné plus de confort, et nous avons dit collectivement : « Génial ! »

L’informatique personnelle remonte à la fin des années 1970. Elle a défini une ère de la technologie où les utilisateurs pouvaient adapter ce qu’ils achetaient de toutes sortes de manières. Lorsque l’informatique mobile est arrivée sous la forme de smartphones, la tendance s’est inversée. Les constructeurs, en particulier Apple, ont gardé bien plus de contrôle. Ils nous ont donné plus de confort, et nous avons dit collectivement : « Génial ! ».

Il y a quelques mois, lorsque Apple a annoncé son iPad Pro, une grande tablette avec un clavier, son président Tim Cook l’a appelée « la plus claire expression de notre vision pour le futur de l’informatique personnelle ». « Ouh là, ça craint » me suis-je dit à ce moment-là. Entre autres, dans l’écosystème iOS, les utilisateurs ne peuvent obtenir leurs logiciels que sur l’Apple store, et les développeurs sont obligés de les vendre au même endroit seulement. C’est peut-être la définition de l’informatique personnelle pour Apple, mais pas pour moi.

Pendant ce temps-là, Windows 10 de Microsoft (sur presque tous les points, une grande avancée en termes de facilité d’utilisation par rapport à Windows 8) ressemble de plus en plus à un logiciel espion déguisé en système d’exploitation (une appellation qui pourrait être injuste, mais pas de beaucoup). Oui, la mise à jour depuis les versions précédentes, extrêmement répandues, est gratuite, mais elle prend des libertés extraordinaires avec les données des utilisateurs et le contrôle de ceux-ci, d’après ceux qui en ont analysé le fonctionnement interne.

Ce n’est pas exactement un duopole commercial. Le système d’exploitation Chrome OS de Google fait tourner un nouvel arrivant : le Chromebook, vendu par différents constructeurs. Mais il comporte plus de limites et oblige ses utilisateurs à être totalement à l’aise (je ne le suis pas) sous l’emprise d’une entreprise qui repose sur la surveillance pour soutenir son modèle économique basé sur la publicité.

Ainsi, pour ceux qui ont le moindre intérêt à garder une indépendance substantielle dans l’informatique mobile ou de bureau, Linux semble être le dernier refuge. Sur toute une gamme de machines, des super-ordinateurs aux serveurs, en passant par les téléphones portables et les systèmes embarqués, Linux est déjà incontournable. Je suis content d’avoir franchi le pas.

Avant d’expliquer le comment, il est vital de comprendre le contexte de ma petite rébellion. La re-centralisation est la nouvelle norme dans les technologies et les communications, une tendance qui m’a préoccupé il y a quelque temps sur ce site, quand je décrivais de manière plus générale mes efforts pour me sevrer des produits et services d’entreprises fournis par Apple (c’est fait), Microsoft (fait en grande partie) et Google (encore difficile). Le gain en confort, comme je le disais à l’époque, ne vaut pas les compromis que nous concédons.

Un duopole mobile ?

Comme j’en discuterai plus bas, je dois me demander à quel point il est pertinent de déclarer son indépendance sur son ordinateur personnel, puisque l’informatique évolue de plus en plus vers les appareils mobiles. Qu’on le veuille ou non, Apple et Google en ont plus ou moins pris le contrôle avec iOS et Android. Apple, comme je l’ai dit, est un maniaque obsédé du contrôle. Même si Google distribue gratuitement une version ouverte d’Android, de plus en plus de pièces essentielles de ce système d’exploitation sont intégrées en un amas logiciel terriblement verrouillé qui emprisonne les utilisateurs dans le monde de Google contrôlé par la publicité. Peut-on parler de « duopole » mobile ?

La re-centralisation est particulièrement terrifiante au vu du pouvoir croissant de l’industrie des télécommunications, qui se bat bec et ongles pour contrôler ce que vous et moi faisons des connexions que nous payons, malgré le jugement bienvenu de la FCC (commission fédérale des communications aux États-Unis) en faveur de la « neutralité du net » en 2015. Comcast détient le monopole du véritable haut débit sur la vaste majorité de son territoire, même si l’on distingue quelques concurrents ici et là. Les fournisseurs d’accès par câble avancent rapidement pour imposer des limites d’utilisation qui n’ont rien à voir avec la capacité disponible et tout à voir avec l’extension de leur pouvoir et de leurs profits, comme l’expliquait en détail Susan Crawford. Et les fournisseurs de téléphonie mobile piétinent allègrement la neutralité du net avec leurs services « zero-rated » (où l’accès à certains services spécifiques n’est pas décompté du volume de données du forfait), que la FCC considère de manière incompréhensible comme innovants.

Pendant ce temps, pour la simple et bonne raison que les utilisateurs préfèrent souvent le confort et la simplicité apparente d’un outil à la garantie de leurs libertés, des acteurs centralisés comme Facebook se constituent des monopoles sans précédents. Comme pour Google et son outil de recherche, ils recueillent les bénéfices grandissants des effets du réseau, que des concurrents vont trouver difficile sinon impossible à défier.

Goulets d’étranglement

N’oublions pas le gouvernement, qui a horreur de la décentralisation. Les services centralisés créent des goulots d’étranglement et rendent le travail facile aux services de police, espions, contrôleurs et service des impôts. L’état de surveillance raffole de la collecte de données sur ces goulots d’étranglement, ce qui met finalement en danger les communications et libertés de tous.

Les goulots d’étranglement permettent aussi de soutenir des modèles économiques qui génèrent beaucoup d’argent pour les campagnes politiques. Hollywood en est un excellent exemple ; la quasi prise de contrôle du Congrès par les lobbies du copyright a conduit à l’adoption de lois profondément restrictives comme dans le système du copyright en vigueur.

Les droits d’auteur sont la clé de ce que mon ami Cory Doctorow appelle « la prochaine guerre civile dans l’informatique générique », une campagne, parfois agressive, pour empêcher les gens qui achètent du matériel (vous et moi, de manière individuelle et dans nos écoles, entreprises et autres organisations) de réellement en être propriétaires. Les lois sur le droit d’auteur sont l’arme des maniaques du contrôle, puisqu’elles les autorisent à nous empêcher par des moyens légaux de bricoler (ils diraient trafiquer) les produits qu’ils vendent.

Les perspectives ne sont pas toutes aussi sombres. Le mouvement des makers ces dernières années est l’un des antidotes à cette maladie du contrôle total. Il en est de même avec les composantes-clés de la plupart des projets de makers : les projets de logiciel libre et open source dont les utilisateurs sont explicitement encouragés à modifier et copier le code.

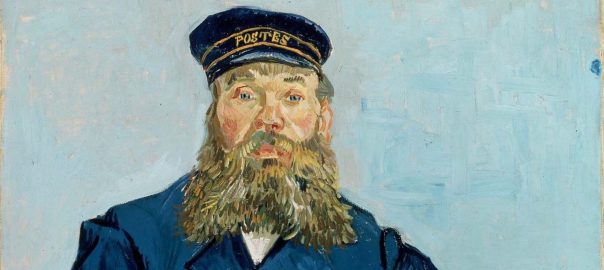

Image par Ian Burt via Flickr | CC BY 2.0

C’est là que Linux entre en scène. Même si nous nous servons davantage de nos appareils mobiles, des centaines de millions d’entre nous travaillent encore beaucoup avec leurs ordinateurs mobiles et de bureau. Linux et les autres logiciels développés par la communauté ne représentent peut-être qu’une solution partielle, mais clairement utile. Il vaut mieux commencer avec quelque chose et l’améliorer, que d’abandonner directement.

J’ai installé Linux un bon nombre de fois au cours des dernières années, depuis qu’il est devenu un véritable système d’exploitation. Mais je suis toujours retourné sous Windows ou Mac, en fonction de mon système principal de l’époque. Pourquoi ? Il restait encore trop d’aspérités et, pendant longtemps, Linux n’avait pas assez d’applications pour réaliser ce dont j’avais besoin. Les inconvénients étaient trop importants pour ma patience limitée, en utilisation quotidienne.

Mais cela s’est progressivement amélioré et, en 2012, j’ai décidé qu’il était temps. J’ai demandé à Cory Doctorow quelle version de Linux il utilisait. C’était une question fondamentale, car Linux se décline en de nombreuses variantes. Les développeurs ont pris le noyau essentiel du code et ont créé différentes versions, adaptées aux divers besoins, goûts et genres d’informatique. Bien que tous utilisent les composants essentiels, sur le modèle du logiciel libre, certains ajoutent du code propriétaire, comme Flash, pour mieux s’adapter aux pratiques informatiques des utilisateurs. Le matériel représentait également une question cruciale, car les ordinateurs ne sont pas tous gérés de manière fiable par Linux, à cause des incompatibilités matérielles.

Cory m’a dit qu’il utilisait Ubuntu sur un Lenovo ThinkPad. J’étais déjà convaincu par les ThinkPads, grâce à la fiabilité du matériel et le bon service après-vente du constructeur, sans oublier la possibilité de mettre à jour les composants matériels internes. Comme j’ai tendance à acheter des modèles récents, je rencontre parfois des problèmes de compatibilité avec le matériel Lenovo le plus récent. J’ai bricolé mon modèle actuel, un T450s, par tous les moyens, en remplaçant le disque dur mécanique par un disque SSD rapide et en ajoutant autant de mémoire vive (RAM) que j’ai pu.

Je penchais également pour Ubuntu, une version de Linux créée par une entreprise appelée Canonical, avec à sa tête un ancien entrepreneur informatique du nom de Mark Shuttleworth, que je connais aussi depuis longtemps. Ubuntu est connu pour son excellente gestion des ThinkPads, surtout s’ils ne sont pas flambants neufs. J’ai utilisé Ubuntu sur quatre ThinkPads différents depuis ma conversion. On apprécie Ubuntu à l’usage parce que Canonical a une vision bien définie de la façon dont les choses doivent fonctionner.

Libre à vous de tester une autre « distribution » Linux, comme on appelle les différentes versions. Il y en a trop pour les nommer toutes, ce qui est à la fois le meilleur et le pire atout de l’écosystème Linux. Les nouveaux utilisateurs devraient presque toujours essayer une des distributions les plus populaires, qui aura été testée de manière plus poussée et offrira la meilleure assistance de la part de la communauté ou de l’entreprise qui l’a créée.

L’une de ces distributions est Linux Mint. Elle est basée sur Ubuntu (qui est elle-même basée sur Debian, une version encore plus proche de la version de base de Linux). Mint m’est apparue comme à beaucoup d’autres personnes comme probablement la meilleure distribution Linux pour ceux qui ont utilisé des systèmes propriétaires et souhaitent la transition la plus simple possible. Je suis parfois tenté de changer moi-même, mais je vais garder Ubuntu, à moins que Canonical ne le foire complètement, ce que je n’espère pas.

Avant de faire le grand saut, j’ai demandé à bon nombre de personnes des conseils sur la façon migrer au mieux mes usages informatiques depuis des programmes propriétaires vers des programmes open source. Plusieurs m’ont suggéré ce qui s’est avéré être un bon conseil : j’ai cessé d’utiliser l’application Mail d’Apple et j’ai installé Thunderbird de Mozilla sur mon Mac, et après un mois, je me suis tellement habitué à cette manière différente (pas si différente non plus) de gérer mon courrier électronique (non, je n’utilise pas Gmail, sauf pour un compte de secours). J’ai aussi installé LibreOffice, une sorte de clone open source de Microsoft Office, qui est moins courant mais adéquat pour arriver à ses fins dans la plupart des cas.

Comme la plupart des gens qui utilisent un ordinateur personnel, je passe mon temps presque exclusivement sur tout petit nombre d’applications : navigateur internet, client courriel, traitement de texte. Sous Linux, j’ai installé Firefox et Chromium, une variante open source du Chrome de Google. Comme déjà mentionné, Thunderbird faisait bien son job pour gérer mes courriels, et LibreOffice était satisfaisant en tant que logiciel de traitement de texte.

Mais j’avais encore besoin d’utiliser Windows pour certaines choses. En particulier, le logiciel de cours en ligne que j’utilisais à mon université refusait de fonctionner sous Linux, quel que soit le navigateur utilisé. J’ai donc installé Windows dans une machine virtuelle, afin de faire tourner Windows et ses programmes à l’intérieur de Linux. J’ai aussi installé Windows sur une partition séparée de mon disque dur pour les occasions encore plus rares où j’aurais besoin d’utiliser un Windows natif, contrairement à un Windows virtuel ce qui réduit les performances.

Aujourd’hui je n’ai presque plus jamais besoin de Windows. LibreOffice s’est énormément amélioré. Pour l’édition collaborative, Google Docs (hum… j’ai déjà dit que se passer de Google est difficile, hein ?) est difficile à battre, mais LibreOffice progresse. Le logiciel utilisé dans mon université pour les cours en ligne fonctionne maintenant avec Linux. Le seul programme pour lequel j’ai encore besoin de Windows est Camtasia, pour le « screencasting » – enregistrer (et diffuser) ce qu’affiche l’écran, ainsi que le son. Plusieurs programmes de screencasting existent sous Linux, mais ils sont limités. Et parfois, je suis obligé d’utiliser MS PowerPoint pour lire les rares diaporamas qui hoquètent avec le logiciel de présentations de LibreOffice (Impress).

Étrangement, le plus compliqué, dans cette transition, fut de m’adapter aux différentes conventions utilisées pour les claviers : désapprendre le style Apple et réapprendre les combinaisons Windows, équivalentes pour la plupart à celles utilisées par Linux. Au bout de quelques mois, tout était rentré dans l’ordre.

La fréquence de mise à jour des logiciels est un des aspects que je préfère avec Linux. Ubuntu et de nombreuses autres versions proposent régulièrement des mises à jour même si je préfère choisir les versions qui disposent d’un support étendu (aussi appelées versions « LTS » soit Long Term Support en anglais). Ils corrigent rapidement les failles de sécurité qui sont trouvées et il se passe souvent moins d’une semaine entre deux mises à jour, un rythme beaucoup plus élevé que celui auquel j’étais habitué avec Apple.

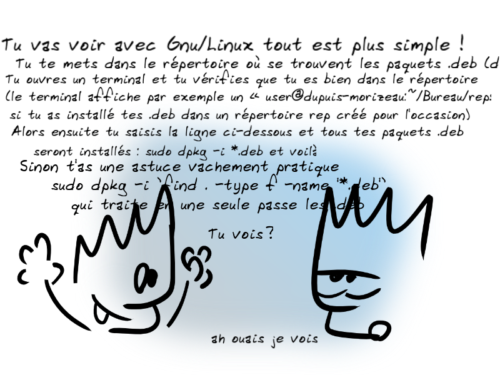

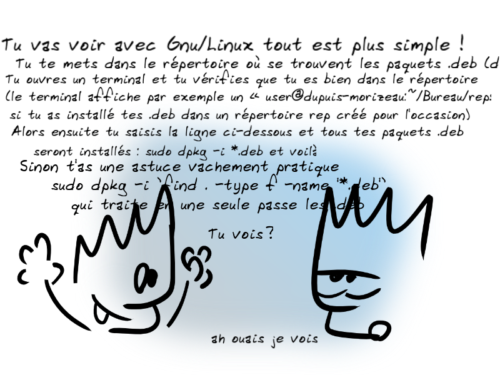

Ce que j’aime le moins avec Linux, c’est qu’il faut parfois faire quelque chose qui pourrait paraître intimidant pour un nouvel utilisateur. Personne ne devrait avoir à ouvrir une interface en ligne de commande pour saisir sudo apt-get update ou autre. Personne ne devrait avoir à faire face à un avertissement indiquant que l’espace disque est insuffisant pour que la mise à jour du système puisse être appliquée (ce qui nécessitera alors de retirer les composants obsolètes du système d’exploitation, une opération qui n’est pas à la portée de tout le monde). Personne ne devrait découvrir, après une mise à jour, qu’un composant matériel a cessé de fonctionner, ce qui m’est arrivé avec mon trackpad, inutilisable jusqu’à ce que je trouve une solution grâce à un forum (oui, cela peut arriver avec Windows mais les fabricants testent beaucoup plus le fonctionnement de leur matériel avec les logiciels Microsoft. Quant à Apple, ça arrive également, mais il a l’avantage de produire du matériel et des logiciels qui sont associés de façon harmonieuse).

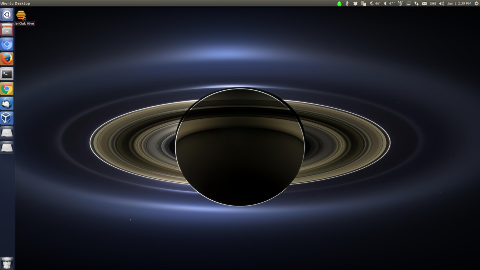

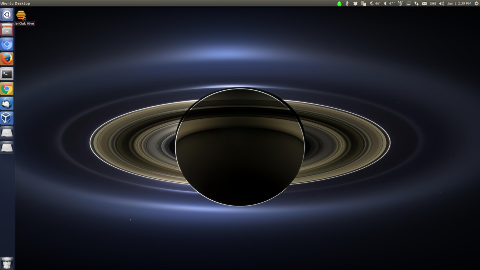

Le bureau de Dan Gillmor sous Ubuntu

Lorsqu’il y a un problème, les communautés apparues autour du logiciel libre et open source s’avèrent incroyablement utiles. Poussant toujours un peu les limites pour adopter ce système, je demande souvent de l’aide. Je reçois toujours des réponses. Certains experts super pointus de ces forums peuvent être condescendants voire irrespectueux si on ose poser une question qui leur semblera simplissime ou qui a déjà reçu une réponse par ailleurs. On trouve également cette aide précieuse (et cette éventuelle intempérance) pour Windows, Mac et les autres systèmes mobiles (certains fanatiques d’Apple sont parfois étonnamment violents avec les hérétiques) mais il existe une atmosphère unique lorsqu’il s’agit de personnes œuvrant sur des technologies ouvertes, pour tous.

Si vous souhaitez essayer Linux sur votre ordinateur, c’est plutôt simple. Ubuntu, ainsi que d’autres distributions, vous permettent de créer un DVD ou une clé USB contenant le système d’exploitation et de nombreuses applications et vous pouvez démarrer votre ordinateur en utilisant ce support de test. C’est une bonne technique pour savoir si le matériel que vous avez à votre disposition fonctionnera avec. Ce sera vraisemblablement le cas si vous n’utilisez pas un ordinateur flambant neuf. Linux brille particulièrement par son support des ordinateurs déjà anciens.

Pour éviter les soucis d’installation de Linux, on peut acheter un ordinateur avec le système d’exploitation pré-installé et obtenir des mises à jour régulières, adaptées au matériel. J’ai réfléchi à différents modèles fabriqués par des entreprises comme Dell, System76, ZaReason entre autres. Je viens de visiter une entreprise appelée Purism, qui vend des ordinateurs portables construits uniquement avec du matériel et du logiciel non-propriétaire, du moins autant qu’il est possible à l’heure actuelle. Le modèle Librem 13 est impressionnant, Purism a adapté Linux pour ce matériel ergonomique et j’ai hâte de l’essayer.

Je voyage beaucoup et penche plutôt en faveur d’une entreprise qui dispose de point de dépôt dans différents pays et qui (avec le coût que ça implique) pourra dépêcher un technicien chez moi, à mon bureau ou à mon hôtel si ma machine tombe en panne. Si je dois abandonner Lenovo (et les dernières affaires à leur sujet me font douter), je me dirigerai probablement vers les machines Dell fournies avec Linux.

Vous avez pu remarquer que je n’ai presque pas abordé la question du coût. Pour le système d’exploitation, ce n’est plus nécessaire car Microsoft et Apple ont fait fondre le prix apparent de leur système d’exploitation et il apparaît comme nul. Bien entendu, vous le payez toujours quand vous achetez un ordinateur. Cela dit, même les mises à jour importantes sont devenues gratuites, un changement fondamental si on regarde en arrière. Cependant, en ce qui concerne Microsoft, la « gratuité » semble exister au détriment de la collecte intrusive des données.

En revanche, pour les applications, c’est une autre histoire. Vous pouvez économiser beaucoup d’argent en utilisant des logiciels libres et open source. Comparé à LibreOffice, Microsoft Office reste cher même si les versions de base « Famille et Étudiant » sont abordables et que beaucoup de personnes utilisent MS Office grâce à la version fournie par leur école ou leur entreprise.

Mais voilà, j’apprécie de payer pour certains logiciels, car je veux être sûr, autant que possible, que j’aurai de l’aide si besoin et que les développeurs auront une source de motivation pour continuer à corriger et à améliorer le logiciel. Je serais heureux de pouvoir payer pour des versions de Camtasia et Scrivener sur Linux (ce dernier possède une version communautaire pour Linux). En attendant, je fais des dons à différents projets dont j’utilise les logiciels régulièrement, qu’ils soient créés par des entreprises ou intégralement développés par des bénévoles. Ubuntu a beau être une entreprise qui gagne de l’argent en fournissant des services (une approche populaire et éprouvée dans le monde du logiciel libre et open source), je continue d’y donner. Avec moi, LibreOffice a gagné un utilisateur, mais aussi un donateur. Il en va de même pour d’autres projets.

Linux reste en arrière, enfin « officiellement », quand il s’agit de lire des DVD. Il faut installer certains logiciels jugés illégaux par le cartel du divertissement afin de pouvoir lire les disques que vous avez achetés (Apple a l’air d’un parangon de liberté par rapport à Hollywood). L’utilisation de services de streaming comme Netflix ou Amazon peut également être source d’ennuis. Enfin ça devient plus simple grâce à… humpf l’ajout de verrous numériques (NdT : DRM ou Digital Rights Management) dans certains navigateurs.

Est-ce que tous ces ajustements en valent la peine ? Je dirais que oui. Tout ce qui améliore ou préserve notre capacité à utiliser les technologies comme nous l’entendons en vaut la chandelle par rapport aux voies imposées par des pouvoirs centralisés. Et si nous ne sommes pas plus nombreux à essayer, ces monstres du contrôle verront leur victoire assurée.

Il est probablement presque trop tard pour que Linux devienne un système d’exploitation extrêmement populaire, dans les pays développés tout au moins. Mais il n’est pas trop tard pour que suffisamment d’entre nous l’utilisent afin de garantir des libertés informatiques pour ceux qui les veulent.

Que pouvons-nous faire à propos des écosystèmes mobiles, si nous ne voulons pas leur laisser l’hégémonie sur toute l’informatique personnelle, voilà bien le problème. Des versions tierces d’Android ont émergé au travers de communautés dynamiques telles que XDA Developers, qui veulent plus de liberté. Ubuntu travaille sur un système d’exploitation mobile parmi d’autres nombreux acteurs de la communauté open source ; des années ont été dédiées à tendre vers un système d’exploitation qui puisse fonctionner sur tous les appareils. Mais la domination d’Apple et Google sur le monde mobile en intimide plus d’un.

nous avons vraiment le choix

J’essaie en ce moment beaucoup d’options parmi les appareils possibles dans l’espoir que j’en trouverai un qui soit suffisamment bon pour une utilisation au quotidien, même s’il devait ne pas être aussi pratique que les propriétés privées bien gardées des géants de l’internet (un de mes téléphones est actuellement sous un système d’exploitation appelé Cyanogenmod). Bientôt, je vous en dirai plus sur la façon dont ça se passe.

En attendant, souvenez-vous : nous avons vraiment le choix – nous pouvons faire des choix qui repoussent les limites des libertés technologiques. Récemment, mon choix a consisté à me détacher libérer de l’emprise de ceux qui veulent tout contrôler. J’espère vous donner à réfléchir pour faire de même. En fonction de ce que nous choisissons, nous avons beaucoup à gagner, et à perdre.

(1) Même si cela va vexer certaines personnes, j’ai fait référence à GNU/Linux par son nom de loin le plus couramment utilisé – Linux, tout simplement – après la première occurrence. Pour en savoir plus à ce propos, les Wikipédiens ont rassemblé tout un tas de sources pertinentes.

Merci à Evan Hansen et Steven Levy.

Biographie et plus d’informations : http://dangillmor.com/about (Photo par Joi Ito)

Tout le monde pense que les bibliothèques ont un rôle positif à jouer dans le monde, mais ce rôle diffère suivant que vous parliez à un bibliothécaire ou à leur tutelle. Demandez à un membre de leur tutelle ce que les bibliothèques ont en commun, et il répondra probablement : elles partagent les livres avec les gens. Les bibliothécaires auront une réponse différente : elles partagent un ensemble de valeurs. Il est temps pour les bibliothèques de défendre ces valeurs en soutenant l’accès à Internet et en menant le combat pour conserver un Internet ouvert, libre et sans propriétaire.

Tout le monde pense que les bibliothèques ont un rôle positif à jouer dans le monde, mais ce rôle diffère suivant que vous parliez à un bibliothécaire ou à leur tutelle. Demandez à un membre de leur tutelle ce que les bibliothèques ont en commun, et il répondra probablement : elles partagent les livres avec les gens. Les bibliothécaires auront une réponse différente : elles partagent un ensemble de valeurs. Il est temps pour les bibliothèques de défendre ces valeurs en soutenant l’accès à Internet et en menant le combat pour conserver un Internet ouvert, libre et sans propriétaire.

Les bibliothèques ne sont pas seulement des points d’accès à des contenus culturels ou scientifiques. Ce sont aussi depuis longtemps des lieux d’apprentissage du rapport à l’information, des espaces d’exercice de la liberté d’expression et plus généralement, du vivre-ensemble et de la citoyenneté. Les bibliothécaires américains ont été sensibilisés plus tôt à la question de la protection de la vie privée, notamment parce qu’ils ont été frappés de plein fouet par le Patriot Act après les attentats de 2001. Le texte initial prévoyait en effet la possibilité pour le FBI d’accéder aux fichiers des usagers des bibliothèques pour connaître la teneur de leurs lectures.

Les bibliothèques ne sont pas seulement des points d’accès à des contenus culturels ou scientifiques. Ce sont aussi depuis longtemps des lieux d’apprentissage du rapport à l’information, des espaces d’exercice de la liberté d’expression et plus généralement, du vivre-ensemble et de la citoyenneté. Les bibliothécaires américains ont été sensibilisés plus tôt à la question de la protection de la vie privée, notamment parce qu’ils ont été frappés de plein fouet par le Patriot Act après les attentats de 2001. Le texte initial prévoyait en effet la possibilité pour le FBI d’accéder aux fichiers des usagers des bibliothèques pour connaître la teneur de leurs lectures. Un beau jour du printemps 2012, j’ai refermé mon MacBookAir pour la dernière fois. À partir de ce moment, mon environnement informatique (en tout cas, en ce qui concerne mon portable) était

Un beau jour du printemps 2012, j’ai refermé mon MacBookAir pour la dernière fois. À partir de ce moment, mon environnement informatique (en tout cas, en ce qui concerne mon portable) était