Le Framablog termine l’année avec une traduction de poids qui offre quelque part une excellente transition entre la décennie précédente et la décennie suivante, parce que le vaste sujet évoqué sera, mais en fait est déjà, un enjeu crucial pour l’avenir.

Le Framablog termine l’année avec une traduction de poids qui offre quelque part une excellente transition entre la décennie précédente et la décennie suivante, parce que le vaste sujet évoqué sera, mais en fait est déjà, un enjeu crucial pour l’avenir.

Le mot « open » est servi à toutes les sauces en ce moment dans le monde anglophone. Un peu comme l’écologie, c’est un mot à la mode qui pénètre de plus en plus de domaines, et tout le monde se doit de l’être ou de feindre de l’être sous peine d’éveiller les soupçons, voire la réprobation.

Mais dans la mesure où il n’en existe pas de définition précise, chacun le comprend comme il veut ou comme il peut. Et l’écart peut être grand entre un logiciel libre et une multinationale qui se déclarent tous deux comme « open ». Une multinationale comme Google par exemple !

Il n’est pas anodin que le vice-président de la gestion des produits et du marketing, Jonathan Rosenberg, ait pris aujourd’hui sa plume pour publiquement expliquer (ou tenter d’expliquer) dans le détail ce que Google entendait par « open », dans un récent billet du blog officiel de la société intitulé, excusez du peu, The meaning of Open (comme d’autres s’interrogent sur the meaning of life).

Tout comme l’autre géant Facebook, Google est en effet actuellement sous la pression de ceux qui, entre autres, s’inquiètent du devenir des données personnelles traitées par la société[1]. Et cette pression ira croissante au fur et à mesure que Google aura une place de plus en plus grande sur Internet, à grands coups de services qui se veulent à priori tous plus intéressants les uns que les autres.

« Don’t be evil » est le slogan à double tranchant que s’est donné Google. Nous ne sommes certainement pas en face du diable, mais ce n’est pas pour autant que nous allons lui accorder le bon Dieu sans confession.

À vous de juger donc si, dans le contexte actuel, ce document est une convaincante profession de foi.

Nous avons choisi de traduire tout du long « open » par « ouverture » ou « ouvert ». L’adéquation n’est pas totalement satisfaisante, mais laisser le terme d’origine en anglais eut été selon nous plus encore source de confusion.

L’ouverture selon Google

Google and The meaning of open

Jonathan Rosenberg – 21 décembre 2009 – Blog officiel de Google

(Traduction non officielle Framalang : Goofy et Olivier)

La semaine dernière j’ai envoyé un email interne sur le sens de « l’ouverture » appliquée à Internet, Google et nos utilisateurs. Dans un souci de transparence, j’ai pensé qu’il pouvait être opportun de partager également ces réflexions à l’extérieur de notre entreprise.

Chez Google nous sommes persuadés que les systèmes ouverts l’emporteront. Ils conduisent à davantage d’innovation, de valeur, de liberté de choix pour les consommateurs et à un écosystème dynamique, lucratif et compétitif pour les entreprises. Un grand nombre d’entre elles prétendront à peu près la même chose car elles savent que se positionner comme ouvertes est à la fois bon pour leur image de marque et totalement sans risque. Après tout, dans notre industrie il n’existe pas de définition précise de ce que peut signifier « ouvert ». C’est un terme à la Rashomon (NdT : expression issue du film éponyme de Kurosawa) : à la fois extrêmement subjectif et d’une importance vitale.

Le thème de l’ouverture est au centre de nombreuses discussions ces derniers temps chez Google. J’assiste à des réunions autour d’un produit où quelqu’un déclare que nous devrions être davantage « ouverts ». Il s’ensuit un débat qui révèle que même si l’« ouverture » fait l’unanimité, nous ne sommes pas forcément d’accord sur ce qu’elle implique concrètement.

Face à ce problème récurrent, j’en arrive à penser que nous devrions exposer notre définition de l’ouverture en termes suffisamment clairs, afin que chacun puisse la comprendre et la défendre. Je vous propose ainsi une définition fondée sur mes expériences chez Google et les suggestions de plusieurs collègues. Ces principes nous guident dans notre gestion de l’entreprise et dans nos choix sur les produits, je vous encourage donc à les lire soigneusement, à les commenter et les débattre. Puis je vous invite à vous les approprier et à les intégrer à votre travail. Il s’agit d’un sujet complexe et si un débat à lieu d’être (ce dont je suis persuadé), il doit être ouvert ! Libre à vous d’apporter vos commentaires.

Notre définition de l’ouverture repose sur deux composantes : la technologie ouverte et l’information ouverte. La technologie ouverte comprend d’une part l’open source, ce qui veut dire que nous soutenons activement et publions du code qui aide Internet à se développer, et d’autre part les standards ouverts, ce qui signifie que nous adhérons aux standards reconnus et, s’il n’en existe pas, nous travaillons à la création de standards qui améliorent Internet (et qui ne profitent pas seulement à Google). L’information ouverte comprend selon nous trois idées principales : tout d’abord les informations que nous détenons sur nos utilisateurs servent à leur apporter une valeur ajoutée, ensuite nous faisons preuve de transparence sur les informations les concernant dont nous disposons, et enfin nous leur donnons le contrôle final sur leurs propres informations. Voilà le but vers lequel nous tendons. Dans bien des cas nous ne l’avons pas encore atteint, mais j’espère que la présente note contribuera à combler le fossé entre la théorie et la pratique.

Si nous pouvons incarner un engagement fort à la cause de l’ouverture, et je suis persuadé que nous le pouvons, nous aurons alors une occasion unique de donner le bon exemple et d’encourager d’autres entreprises et industries à adopter le même engagement. Et si elles le font, le monde s’en trouvera un peu meilleur.

Les systèmes ouverts sont gagnants

Pour vraiment comprendre notre position, il faut commencer par l’assertion suivante : les systèmes ouverts sont gagnants. Cela va à l’encontre de tout ce en quoi croient ceux qui sont formatés par les écoles de commerce, ceux qui ont appris à générer une avantage compétitif durable en créant un système fermé, en le rendant populaire, puis en tirant profit du produit pendant tout son cycle de vie. L’idée répandue est que les entreprises devraient garder les consommateurs captifs pour ne laisser aucune place à la concurrence. Il existe différentes approches stratégiques, les fabricants de rasoirs vendent leurs rasoirs bon marché et leurs lames très cher, tandis que ce bon vieux IBM fabrique des ordinateurs centraux coûteux et des logiciels… coûteux aussi. D’un autre côté, un système fermé bien géré peut générer des profits considérables. Cela permet aussi à court terme de mettre sur le marché des produits bien conçus, l’iPod et l’iPhone en sont de bons exemples, mais finalement l’innovation dans un système fermé tend à être, au mieux, incrémentale (est-ce qu’un rasoir à quatre lames est vraiment tellement mieux qu’un rasoir à trois lames ?). Parce que la priorité est de préserver le statu quo. L’autosatisfaction est la marque de fabrique de tous les systèmes fermés. Si vous n’avez pas besoin de travailler dur pour garder votre clientèle, vous ne le ferez pas.

Les systèmes ouverts, c’est exactement l’inverse. Ils sont compétitifs et bien plus dynamiques. Dans un système ouvert, un avantage compétitif n’est pas assujetti à l’emprisonnement des consommateurs. Il s’agit plutôt de comprendre mieux que tous les autres un système très fluctuant et d’utiliser cette intuition pour créer de meilleurs produits plus innovants. L’entreprise qui tire son épingle du jeu dans un système ouvert est à la fois douée pour l’innovation rapide et la conception avant-gardiste ; le prestige du leader dans la conception attire les consommateurs et l’innovation rapide les retient. Ce n’est pas facile, loin de là, mais les entreprises qui réagissent vite n’ont rien à redouter, et lorsqu’elles réussissent elles peuvent générer de gigantesques dividendes.

Systèmes ouverts et entreprises prospères ne sont pas inconciliables. Ils tirent parti de l’intelligence collective et incitent les entreprises à une saine concurrence, à l’innovation et à miser leur succès sur le mérite de leurs produits et pas seulement sur un brillant plan marketing. La course à la carte du génome humain est un bon exemple.

Dans leur livre Wikinomics, Don Tapscott et Anthony Williams expliquent comment, au milieu des années 90, des entreprises privées ont découvert et breveté de grandes portions des séquences de l’ADN et ont prétendu contrôler l’accès à ces données et leur tarif. Faire ainsi du génome une propriété privée a fait grimper les prix en flèche et a rendu la découverte de nouveaux médicaments bien plus difficile. Et puis, en 1995, Merck Pharmaceuticals et le Centre de Séquençage du Génome de l’Université de Washington ont changé la donne avec une nouvelle initiative « ouverte » baptisée l’Index Génétique Merck. En trois ans seulement ils ont publié plus de 800 000 séquences génétiques et les ont mises dans le domaine public et bientôt d’autres projets collaboratifs ont pris le relais. Tout cela au sein d’un secteur industriel où la recherche initiale et le développement étaient traditionnellement menés dans des laboratoires « fermés ». Par sa démarche « ouverte », Merck a donc non seulement modifié la culture d’un secteur entier mais aussi accéléré le tempo de la recherche biomédicale et le développement des médicaments. L’entreprise a donné aux chercheurs du monde entier un accès illimité à des données génétiques, sous forme d’une ressource « ouverte ».

Les systèmes ouverts permettent l’innovation à tous les niveaux, voilà une autre différence majeure entre les systèmes ouverts et fermés. Ils permettent d’innover à tous les étages, depuis le système d’exploitation jusqu’au niveau de l’application, et pas uniquement en surface. Ainsi, une entreprise n’est pas dépendante du bon vouloir d’une autre pour lancer un produit. Si le compilateur GCC que j’utilise a un bogue, je peux le corriger puisque le compilateur est open source. Je n’ai pas besoin de soumettre un rapport de bogue et d’espérer que la réponse arrivera rapidement.

Donc, si vous essayez de stimuler la croissance d’un marché entier, les systèmes ouverts l’emportent sur les systèmes fermés. Et c’est exactement ce que nous nous efforçons de faire avec Internet. Notre engagement pour les systèmes ouverts n’est pas altruiste. C’est simplement dans notre intérêt économique puisque un Internet ouvert génère un flot continu d’innovations qui attirent les utilisateurs et créé de nouveaux usages, pour finalement faire croître un marché tout entier. Hal Varian note cette équation dans son livre Les règles de l’information :

le gain = (la valeur totale ajoutée à une industrie) x (la part de marché dans cette industrie)

Toutes choses étant égales par ailleurs, une augmentation de 10% de l’un ou l’autre de ces deux facteurs devrait produire au résultat équivalent. Mais dans notre marché une croissance de 10% génèrera un revenu bien supérieur parce qu’elle entraîne des économies d’échelle dans tout le secteur, augmentant la productivité et réduisant les coûts pour tous les concurrents. Tant que nous continuerons d’innover en sortant d’excellents produits, nous prospèrerons en même temps que tout notre écosystème. Nous aurons peut-être une part plus petite, mais d’un plus grand gâteau.

En d’autres termes, l’avenir de Google dépend de la sauvegarde d’un Internet ouvert, et notre engagement pour l’ouverture développera le Web pour tout le monde, y compris Google.

La technologie ouverte

Pour définir l’ouverture, il faut commencer par les technologies sur lesquelles repose Internet : les standards ouverts et les logiciels open source.

Les standards ouverts

Le développement des réseaux a toujours dépendu des standards. Lorsqu’on a commencé à poser des voies ferrées à travers les États-Unis au début du 19ème siècle, il existait différents standards d’écartement des voies. Le réseau ferré ne se développait pas et n’allait pas vers l’ouest jusqu’à ce que les diverses compagnies ferroviaires se mettent d’accord sur un écartement standard. (Dans ce cas précis la guerre de standards a été une vraie guerre : les compagnies ferroviaires sudistes furent obligées de convertir plus de 1100 miles au nouveau standard après que la Confédération eut perdu contre l’Union pendant la Guerre Civile.)

Il y eut un autre précédent en 1974 quand Vint Cerf et ses collègues proposèrent d’utiliser un standard ouvert (qui deviendrait le protocole TCP/IP) pour connecter plusieurs réseaux d’ordinateurs qui étaient apparus aux USA. Ils ne savaient pas au juste combien de réseaux avaient émergé et donc « l’Internet », mot inventé par Vint, devait être ouvert. N’importe quel réseau pouvait se connecter en utilisant le protocole TCP/IP, et grâce à cette décision à peu près 681 millions de serveurs forment aujourd’hui Internet.

Aujourd’hui, tous nos produits en développement reposent sur des standards ouverts parce que l’interopérabilité est un élément crucial qui détermine le choix de l’utilisateur. Quelles en sont les implications chez Google et les recommandation pour nos chefs de projets et nos ingénieurs ? C’est simple : utilisez des standards ouverts autant que possible. Si vous vous risquez dans un domaine où les standards ouverts n’existent pas, créez-les. Si les standards existants ne sont pas aussi bons qu’ils le devraient, efforcez-vous de les améliorer et rendez vos améliorations aussi simples et documentées que possible. Les utilisateurs et le marché au sens large devraient toujours être nos priorités, pas uniquement le bien de Google. Vous devriez travailler avec les organismes qui établissent les normes pour que nos modifications soient ajoutées aux spécifications validées.

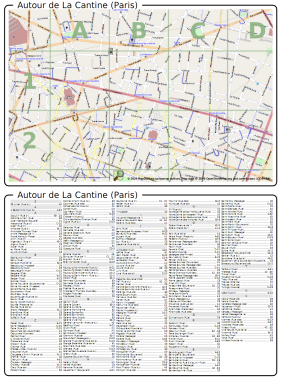

Nous maitrisons ce processus depuis un certain temps déjà. Dans les premières années du Google Data Protocol (notre protocole standard d’API, basé sur XML/Atom), nous avons travaillé au sein de l’IEFT (Atom Protocol Working Group) à élaborer les spécifications pour Atom. Mentionnons aussi notre travail récent au WC3 pour créer une API de géolocation standard qui rendra plus facile le développement d’applications géolocalisées pour le navigateur. Ce standard aide tout le monde, pas seulement nous, et offrira aux utilisateurs beaucoup plus d’excellentes applications mises au point par des milliers de développeurs.

Open source

La plupart de ces applications seront basées sur des logiciels open source, phénomène à l’origine de la croissance explosive du Web de ces quinze dernières années. Un précédent historique existe : alors que le terme « Open Source » a été créé à la fin des années 90, le concept de partage de l’information utile dans le but de développer un marché existait bien avant Internet. Au début des années 1900, l’industrie automobile américaine s’accorda sur une licence croisée suivant laquelle les brevets étaient partagés ouvertement et gratuitement entre fabricants. Avant cet accord, les propriétaires du brevet des moteurs à essence à deux temps contrôlaient carrément l’industrie.

L’open source de nos jours va bien plus loin que le groupement de brevets de l’industrie automobile naissante, et a conduit au développement des composants logiciels sur lesquels est bâti Google : Linux, Apache, SSH et d’autres. En fait, nous utilisons des dizaines de millions de lignes de code open source pour faire tourner nos produits. Nous renvoyons aussi l’ascenseur : nous sommes les plus importants contributeurs open source du monde, avec plus de 800 projets pour un total de 20 millions de lignes de code open source, avec quatre projets (Chrome, Android, Chrome OS et le Google Web Toolkit) qui dépassent chacun un million de lignes. Nos équipes collaborent avec Mozilla et Apache et nous fournissons une plateforme d’hébergement de projets open source (code.google.com/hosting) qui en accueille plus de 250 000. Ainsi, non seulement nous savons que d’autres peuvent participer au perfectionnement de nos produits, mais nous permettons également à tout un chacun de s’inspirer de nos produits s’il estime que nous n’innovons plus assez.

Lorsque nous libérons du code, nous utilisons la licence ouverte, standard, Apache 2.0, ce qui signifie que nous ne contrôlons pas le code. D’autres peuvent s’en emparer, le modifier, le fermer et le distribuer de leur côté. Android en est un bon exemple, car plusieurs assembleurs OEM ont déjà tiré parti du code pour en faire des choses formidables. Procéder ainsi comporte cependant des risques, le logiciel peut se fragmenter entre différentes branches qui ne fonctionneront pas bien ensemble (souvenez-vous du nombre de variantes d’Unix pour station de travail : Apollo, Sun, HP, etc.). Nous œuvrons d’arrache-pied pour éviter cela avec Android.

Malgré notre engagement pour l’ouverture du code de nos outils de développement, tous les produits Google ne sont pas ouverts. Notre objectif est de maintenir un Internet ouvert, qui promeut le choix et la concurrence, empêchant utilisateurs et développeurs d’être prisonniers. Dans de nombreux cas, et particulièrement pour notre moteur de recherche et nos projets liés à la publicité, ouvrir le code ne contribuerait pas à atteindre ces objectifs et serait même dommageable pour les utilisateurs. La recherche et les marchés publicitaires se livrent déjà une concurrence acharnée pour atteindre les prix les plus justes, si bien que les utilisateurs et les publicitaires ont déjà un choix considérable sans être prisonniers. Sans parler du fait qu’ouvrir ces systèmes permettrait aux gens de « jouer » avec nos algorithmes pour manipuler les recherches et les évaluations de la qualité des publicités, en réduisant la qualité pour tout le monde.

Alors lorsque que vous créez un produit ou ajoutez de nouvelles fonctions, il faut vous demander : est-ce que rendre ce code open source va promouvoir un Internet ouvert ? Est-ce qu’il va augmenter le choix de l’utilisateur, du publicitaire et des partenaires ? Est-ce qu’il va en résulter une plus grande concurrence et davantage d’innovation ? Si c’est le cas, alors vous devriez passer le code en open source. Et quand vous le ferez, faite-le pour de bon ; ne vous contentez pas de le balancer dans le domaine public et puis de l’oublier. Assurez-vous que vous avez les ressources pour maintenir le code et que vos développeurs soient prêt à s’y consacrer. Le Google Web Toolkit, que nous avons développé en public en utilisant un gestionnaire de bogues et un système de version publics, est ainsi un exemple de bonnes pratiques.

L’information ouverte

La création des standards ouverts et de l’open source a transformé le Web en un lieu où d’énormes quantités d’informations personnelles sont régulièrement mises en ligne : des photos, des adresses, des mises à jour… La quantité d’informations partagées et le fait qu’elles soient enregistrées à jamais impliquent une question qu’on ne se posait pas vraiment il y a quelques années : qu’allons-nous faire de ces informations ?

Historiquement, les nouvelles technologies de l’information ont souvent permis l’émergence de nouvelles formes de commerce. Par exemple, quand les marchands du bassin méditerranéen, vers 3000 avant JC ont inventé les sceaux (appelés bullae) pour s’assurer que leur cargaison atteindrait sa destination sans être altérée, ils ont transformé un commerce local en commerce longue distance. Des modifications semblables ont été déclenchées par l’apparition de l’écriture, et plus récemment, par celle des ordinateurs. À chaque étape, la transaction, un accord mutuel où chaque partie trouve son compte, était générée par un nouveau type d’information qui permettait au contrat d’être solidement établi.

Sur le Web la nouvelle forme de commerce, c’est l’échange d’informations personnelles contre quelque chose qui a de la valeur. C’est une transaction à laquelle participent des millions d’entre nous chaque jour et qui a d’énormes avantages potentiels. Un assureur automobile peut surveiller les habitudes de conduite d’un client en temps réel et lui donner un bonus s’il conduit bien, un malus dans le cas contraire, grâce aux informations (suivi GPS) qui n’étaient pas disponibles il y a seulement quelques années. C’est une transaction tout à fait simple, mais nous rencontrerons des cas de figure bien plus délicats.

Supposons que votre enfant ait une allergie à certains médicaments. Est-ce que vous accepteriez que son dossier médical soit accessible par une seringue intelligente en ligne qui empêcherait un médecin urgentiste ou une infirmière de lui administrer accidentellement un tel médicament ? Moi je pourrais le faire, mais vous pourriez décider que le bracelet autour de son poignet est suffisant (NdT : voir allergy bracelet). Et voilà le problème, tout le monde ne prendra pas la même décision, et quand on en vient aux informations personnelles nous devons traiter chacune de ces décisions avec le même respect.

Mais si mettre davantage d’informations en ligne peut être bénéfique pour tout le monde, alors leurs usages doivent être régis par des principes suffisamment responsables, proportionnés et flexibles pour se développer et s’adapter à notre marché. Et à la différence des technologies ouvertes, grâce auxquelles nous souhaitons développer l’écosystème d’Internet, notre approche de l’information ouverte est de créer la confiance avec les individus qui s’engagent dans cet écosystème (les utilisateurs, les partenaires et les clients). La confiance est la monnaie la plus importante en ligne, donc pour la créer nous adhérons à trois principes de l’information ouverte : valeur, transparence et contrôle.

La valeur

En premier lieu, nous devons créer des produits qui ont une valeur aux yeux des utilisateurs. Dans de nombreux cas, nous pouvons faire des produits encore meilleurs si nous disposons de davantage d’informations sur l’utilisateur, mais des problèmes de protection de la vie privée peuvent survenir si les gens ne comprennent pas quelle valeur ajoutée ils obtiennent en échange de leurs informations. Expliquez-leur cette valeur cependant, et le plus souvent ils accepteront la transaction. Par exemple, des millions de gens laissent les organismes de cartes de crédit retenir leurs informations au moment de l’achat en ligne, en échange cela leur évite d’utiliser de l’argent liquide.

C’est ce que nous avons fait lorsque nous avons lancé Interest-Based Advertising (la publicité basée sur l’intérêt des utilisateurs) en mars. L’IBA rend les publicités plus pertinentes et plus utiles. C’est une valeur ajoutée que nous avons créée, basée sur les informations que nous collectons. L’IBA comprend aussi un gestionnaire de préférences de l’utilisateur qui lui explique clairement ce qu’il obtiendra en échange de ses informations, qui lui permet de se désengager ou de régler ses paramètres. La plupart des gens parcourant le gestionnaire de préférences choisissent de régler leurs préférences plutôt que de se désinscrire parce qu’ils ont pris conscience de l’intérêt de recevoir des publicités ciblés.

Telle devrait être notre stratégie : dire aux gens, de façon explicite et en langage clair, ce que nous savons d’eux et pourquoi il leur est profitable que nous le sachions. Vous croyez peut-être que la valeur de nos produits est tellement évidente qu’elle n’a pas besoin d’être expliquée ? Pas si sûr.

La transparence

Ensuite, il nous faut permettre aux utilisateurs de trouver facilement quelles informations nous collectons et stockons à travers tous nos produits. Le tableau de bord Google est à ce titre un énorme pas en avant (NdT : le Google Dashboard). En une page, les utilisateurs peuvent voir quelles données personnelles sont retenues par tel produit Google (ce qui couvre plus de 20 produits, notamment Gmail, YouTube et la recherche) et où ils peuvent contrôler leurs paramètres personnels. Nous sommes, à notre connaissance, la première entreprise sur Internet à offrir un tel service et nous espérons que cela deviendra la norme. Un autre exemple est celui de notre politique de confidentialité, qui est rédigée pour des être humains et non pour des juristes.

Nous pouvons cependant en faire plus encore. Tout produit qui récolte des informations sur les utilisateurs doit apparaître sur le tableau de bord. S’il y est déjà, vous n’en avez pas fini pour autant. À chaque nouvelle version ou nouvelle fonctionnalité, demandez-vous si vous ne devriez pas ajouter quelques nouvelles informations au tableau de bord (peut-être même des informations sur les utilisateurs publiquement disponibles sur d’autres sites).

Réfléchissez aux moyen de rendre vos produits plus transparents aussi. Quand vous téléchargez une application pour Android, par exemple, votre appareil vous dit à quelles informations l’application pourra accéder, concernant votre téléphone et vous-même, et vous pouvez alors décider si vous souhaitez ou non poursuivre. Pas besoin de faire une enquête approfondie pour trouver quelles informations vous divulguez, tout est écrit noir sur blanc et vous êtes libre de décider (NdT : allusion à peine voilée aux récents problèmes rencontrés par l’iPhone sur le sujet). Votre produit entre dans cette catégorie ? Comment la transparence peut-elle servir la fidélisation de vos utilisateurs ?

Le contrôle

Nous devons toujours donner le contrôle final à l’utilisateur. Si nous avons des informations sur lui, comme avec l’IBA, il devrait être facile pour lui de les supprimer et de se désinscrire. S’il utilise nos produits et stocke ses contenus chez nous, ce sont ses contenus, pas les nôtres. Il devrait être capable de les exporter et de les supprimer à tout moment, gratuitement, et aussi aisément que possible. Gmail est un très bon exemple de ce processus puisque nous proposons une redirection gratuite vers n’importe quelle adresse. La possibilité de changer d’opérateur est cruciale, donc au lieu de bâtir des murs autour de vos produits, bâtissez des ponts. Donnez vraiment le choix aux utilisateurs.

S’il existe des standards pour gérer les données des utilisateurs, nous devons nous y conformer. S’il n’existe pas de standard, nous devons travailler à en créer un qui soit ouvert et profite au Web tout entier, même si un standard fermé nous serait plus profitable (souvenez-vous que ce n’est pas vrai !). Entretemps nous devons faire tout notre possible pour que l’on puisse quitter Google aussi facilement que possible. Google n’est pas l’Hôtel California (NdT : en référence à la célèbre chanson des Eagles), vous pouvez le quitter à tout moment et vous pouvez vraiment partir, pour de bon !

Comme le signalait Eric dans une note stratégique « nous ne prenons pas les utilisateurs au piège, nous leur facilitons la tâche s’ils veulent se tourner vers nos concurrents ». On peut comparer cette politique aux sorties de secours dans un avion, une analogie que notre PDG apprécierait. Vous espérez n’avoir jamais à les utiliser, mais vous êtes bien content qu’elles soient là et seriez furieux s’il n’y en avait pas.

Voilà pourquoi nous avons une équipe, le Data Liberation Front (dataliberation.org) (NdT : le Front de Libération des Données), dont le travail consiste à rendre la « désinscription » facile. Leurs derniers hauts faits : Blogger (les gens qui choisissent de quitter Blogger pour un autre service peuvent facilement emporter leurs données avec eux) et les Docs (les utilisateurs peuvent maintenant rassembler tous leurs documents, présentations, feuilles de calcul dans un fichier compressé et le télécharger). Créez vos produits en ayant ceci à l’esprit. Vous pouvez le faire grâce à une bonne API publique (NdT : interface de programmation) répertoriant toutes les données de vos utilisateurs. N’attendez pas d’être en version 2 ou 3, discutez-en le plus tôt possible et faites-en une fonctionnalité dès le démarrage de votre projet.

Lorsque les journalistes du Guardian (un quotidien anglais de premier ordre) ont rendu compte des travaux du Data Liberation Front , ils ont déclaré que c’était « contre-intuitif » pour ceux qui sont « habitués à la mentalité fermée des guerres commerciales passées ». Ils ont raison, c’est contre-intuitif pour les gens qui sont restés coincés dans leur conception d’école de commerce, mais si nous faisons bien notre travail, ce ne sera plus le cas. Nous voulons faire de l’ouverture la norme. Les gens vont s’y habituer doucement, ensuite elle deviendra la norme et ils l’exigeront. Et s’ils ne l’obtiennent pas cela ne leur plaira pas. Nous considèrerons notre mission accomplie lorsque l’ouverture ira de soi.

Plus c’est grand, mieux c’est

Les systèmes fermés sont bien définis et génèrent du profit, mais seulement pour ceux qui les contrôlent. Les systèmes ouverts sont chaotiques et génèrent du profit, mais seulement pour ceux qui les comprennent bien et s’adaptent plus vite que les autres. Les systèmes fermés se développent vite alors que les systèmes ouverts se développent plus lentement, si bien que parier sur l’ouverture nécessite de l’optimisme, de la volonté et les moyens de pouvoir se projeter sur le long terme. Heureusement, chez Google nous avons ces trois atouts.

En raison de notre dimension, de nos compétences et de notre appétit pour les projets ambitieux, nous pouvons relever des défis importants nécessitant de lourds investissements sans perspective évidente de rentabilité à court terme. Nous pouvons photographier toutes les rues du monde pour que vous puissiez explorer le quartier autour de l’appartement que vous envisagez de louer, à plusieurs milliers de kilomètres de chez vous. Nous pouvons numériser des milliers de livres et les rendre largement accessibles (tout en respectant les droits des auteurs et des éditeurs). Nous pouvons créer un système de mail qui vous donne un gigaoctet d’espace de stockage (maintenant plus de 7 gigas, en fait) au moment où tous les autres services ne vous procurent guère qu’une petite fraction de ce volume. Nous pouvons traduire instantanément des pages Web dans n’importe quelle des 51 langues disponibles. Nous pouvons traiter des recherches de données qui aident les agences de santé publiques à détecter plus tôt les pics d’épidémie grippale. Nous pouvons élaborer un navigateur plus rapide (Chrome), un meilleur système d’exploitation pour mobile (Android), et une plateforme de communication entièrement nouvelle (Wave), et puis nous pouvons ouvrir tout cela pour que le monde entier puisse innover sur cette base, afin de la personnaliser et l’améliorer.

Nous pouvons réaliser tout cela parce que ce sont des problèmes d’information et que nous avons des spécialistes en informatique, en technologie, et les capacités informatiques pour résoudre ces problèmes. Quand nous le faisons, nous créons de nombreuses plateformes, pour les vidéos, les cartes, les mobiles, les ordinateurs personnels, les entreprises, qui sont meilleures, plus compétitives et plus innovantes. On nous reproche souvent d’être de trop « gros », mais parfois être plus gros nous permet de nous attaquer à ce qui semble impossible.

Tout ceci sera pourtant vain si nous négocions mal le virage de l’ouverture. Il nous faut donc nous pousser nous-mêmes en permanence. Est-ce que nous contribuons à des standards ouverts qui bénéficient à l’industrie ? Qu’est-ce qui nous empêche de rendre notre code open source ? Est-ce que nous donnons à nos utilisateurs davantage de valeur, de transparence et de contrôle ? Pratiquez l’ouverture autant que vous le pouvez et aussi souvent que possible, et si quelqu’un se demande si c’est la bonne stratégie, expliquez-lui pourquoi ce n’est pas simplement une bonne stratégie, mais la meilleure qui soit . Elle va transformer les entreprises et le commerce de ce tout début du siècle, et quand nous l’aurons emporté nous pourrons effectivement ré-écrire les topos des écoles de commerce pour les décennies à venir.

Un Internet ouvert transformera notre vie tout entière. Il aura le pouvoir d’apporter les informations du monde entier jusque dans le creux de la main de chacun et de donner à chacun le pouvoir de s’exprimer librement. Ces prédictions étaient dans un e-mail que je vous ai envoyé au début de cette année (repris ensuite dans un billet du blog) et qui vous décrivait ma vision du futur d’Internet. Mais maintenant je vous parle d’action, pas de vision. L’Internet ouvert a ses détracteurs, des gouvernements désirant en contrôler l’accès, des entreprises luttant dans leur intérêt exclusif pour préserver le statu quo. Ces forces sont puissantes et si elles réussissent, nous allons nous retrouver entravés dans un Internet fragmenté, stagnant, à coût élevé et à faible concurrence.

Nos compétences et notre culture nous offrent l’occasion et nous donnent la responsabilité d’empêcher que cela n’arrive. Nous croyons que la technologie a le pouvoir de répandre l’information. Nous croyons que l’information a le pouvoir d’améliorer les choses. Nous croyons que la majorité ne profitera de cette révolution que grâce à l’ouverture. Nous sommes des techno-optimistes confiants dans l’idée que le chaos de l’ouverture profite à tout le monde. Et nous nous battrons pour la promouvoir en toutes occasions.

L’ouverture l’emportera. Elle l’emportera sur Internet et gagnera par effet boule de neige beaucoup de domaines de notre vie. L’avenir des gouvernements est la transparence. L’avenir du commerce est l’information réciproque. L’avenir de la culture est la liberté. L’avenir de l’industrie du divertissement est l’interactivité. Chacun de ces futurs dépend de l’ouverture d’Internet.

En tant que chefs de produits chez Google, vous élaborez quelque chose qui nous survivra à tous, et personne ne sait dans quelles directions Google poursuivra son développement, ni à quel point Google va changer la vie des gens. Dans cette perspective, nous sommes comme notre collègue Vint Cerf, qui ne savait pas exactement combien de réseaux feraient partie de ce fameux « Internet » et qui l’a laissé ouvert par défaut. Vint a certainement eu raison. Je crois que le futur nous donnera raison aussi.

S’il n’y a que les imbéciles qui ne changent pas d’avis, alors j’ai l’honneur de vous faire savoir que Microsoft n’en fait plus partie.

S’il n’y a que les imbéciles qui ne changent pas d’avis, alors j’ai l’honneur de vous faire savoir que Microsoft n’en fait plus partie. Le Framablog termine l’année avec une traduction de poids qui offre quelque part une excellente transition entre la décennie précédente et la décennie suivante, parce que le vaste sujet évoqué sera, mais en fait est déjà, un enjeu crucial pour l’avenir.

Le Framablog termine l’année avec une traduction de poids qui offre quelque part une excellente transition entre la décennie précédente et la décennie suivante, parce que le vaste sujet évoqué sera, mais en fait est déjà, un enjeu crucial pour l’avenir. Rien à faire, la culture propriétaire est dans l’ADN de Microsoft.

Rien à faire, la culture propriétaire est dans l’ADN de Microsoft. Quelle est la différence graphique entre la page officielle de la licence Creative Commons

Quelle est la différence graphique entre la page officielle de la licence Creative Commons  « MiMOOo » vous connaissiez ? Nous non plus ! Cherchons alors ensemble à en savoir davantage, parce que cela en vaut la peine…

« MiMOOo » vous connaissiez ? Nous non plus ! Cherchons alors ensemble à en savoir davantage, parce que cela en vaut la peine… Est-ce uniquement par leur licence qu’un noyau Linux et une encyclopédie Wikipédia sont identifiés comme étant libres ?

Est-ce uniquement par leur licence qu’un noyau Linux et une encyclopédie Wikipédia sont identifiés comme étant libres ? Dans la série « les projets pharaoniques (mais sans esclaves) de la culture libre hors logiciels », on cite toujours, et à juste titre, Wikipédia. Mais il se pourrait bien qu’OpenStreetMap vienne rapidement le rejoindre aux yeux du grand public.

Dans la série « les projets pharaoniques (mais sans esclaves) de la culture libre hors logiciels », on cite toujours, et à juste titre, Wikipédia. Mais il se pourrait bien qu’OpenStreetMap vienne rapidement le rejoindre aux yeux du grand public. Mais ça n’est pas fini ! En combinant les données, le très prometteur projet dérivé

Mais ça n’est pas fini ! En combinant les données, le très prometteur projet dérivé  Tous ceux qui ont eu un jour à jouer les touristes à Londres ont pu remarquer l’extrême qualité et la totale… gratuité des grands musées nationaux. Rien de tel pour présenter son patrimoine et diffuser la culture au plus grand nombre. Notons qu’à chaque fois vous êtes accueilli à l’entrée par de grandes urnes qui vous invitent à faire un don, signifiant par là-même qu’ils ne sont plus gratuits si jamais vous décidez d’y mettre votre contribution.

Tous ceux qui ont eu un jour à jouer les touristes à Londres ont pu remarquer l’extrême qualité et la totale… gratuité des grands musées nationaux. Rien de tel pour présenter son patrimoine et diffuser la culture au plus grand nombre. Notons qu’à chaque fois vous êtes accueilli à l’entrée par de grandes urnes qui vous invitent à faire un don, signifiant par là-même qu’ils ne sont plus gratuits si jamais vous décidez d’y mettre votre contribution.