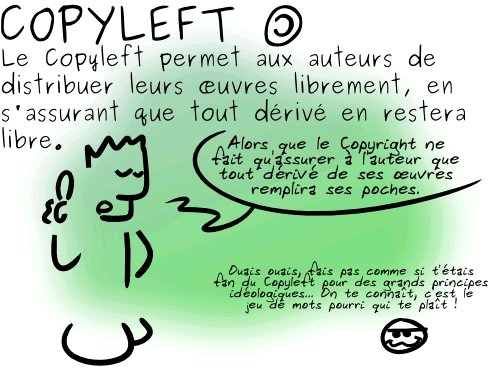

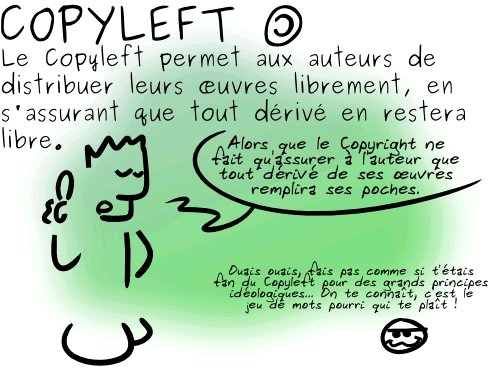

Geektionnerd : Copyleft

Le copyleft, c’est l’obligation de rester libre 😉

Crédit : Simon Gee Giraudot (Creative Commons By-Sa)

Le copyleft, c’est l’obligation de rester libre 😉

Crédit : Simon Gee Giraudot (Creative Commons By-Sa)

« Le libre est à la fois une réponse concrète à des problèmes concrets et un outil de réflexion pour penser les problématiques générales de l’immatériel et la connaissance », nous dit ici Jean-Pierre Archambault, qui n’en est pas à son premier article sur le Framablog.

« Le libre est à la fois une réponse concrète à des problèmes concrets et un outil de réflexion pour penser les problématiques générales de l’immatériel et la connaissance », nous dit ici Jean-Pierre Archambault, qui n’en est pas à son premier article sur le Framablog.

C’est pourquoi la question de la formation aux logiciels libres est l’un des enjeux majeurs de l’éducation de demain[1].

Il s’agit bien entendu d’être capable de les utiliser. Mais bien au-delà il s’agit aussi et surtout de comprendre qu’ils s’inscrivent dans une culture. Une culture de la collaboration, de la création, de l’autonomie et du partage qui ne doit plus être absent du cursus scolaire de nos étudiants.

La question est souvent posée de savoir s’il y a une spécificité de la formation aux logiciels libres. La licence d’un programme n’est pas forcément choisie lors de son écriture. Un traitement de texte reste un traitement de texte. Et une procédure récursive n’est pas intrinsèquement copyleft ou copyright. Nous allons examiner la question du point de vue des logiciels, de la culture informatique, des méthodes organisationnelles de réalisation des logiciels libres, de la portée sociétale du libre et des besoins pédagogiques des enseignants.

Qu’il faille former à Linux comme on forme à Unix, Mac OS X ou Vista va de soi. Idem pour OpenOffice, FireFox ou The Gimp. Ce sont des systèmes et des applications qu’il faut connaître pour s’en servir « intelligemment ». Mais un système d’exploitation, un traitement de texte ou un tableur sont des outils conceptuels compliqués et complexes de par les objets qu’ils traitent et la multitude de leurs fonctionnalités. Il faut veiller à ne pas entrer dans le tunnel sans fin de la formation à la version n d’un progiciel, puis n+1, d’un usager « presse-boutons ». On connaît ce genre de pratiques pour des produits propriétaires dont les versions défilent à grande vitesse, enrichies de fonctionnalités dont l’utilisateur lambda n’a pas nécessairement besoin. Mais qui peuvent présenter des avantages financiers et des rentes de situation pour des officines de formation. Il faut donc pouvoir s’appuyer sur une appropriation initiale des concepts généraux des traitements de texte, tableurs et gestionnaires de bases de données.

L’informatique, le numérique étant partout dans la société, la question posée est celle de la culture générale de l’homme, du travailleur et du citoyen du 21è siècle. Il s’agit là des trois missions fondamentales des systèmes éducatifs. Le libre, c’est le code source que l’on connaît. Et pas la « boîte noire » miraculeuse qui fait tout pour vous : curieuse d’ailleurs cette représentation mentale qu’ont certains de la prothèse du cerveau qu’est l’ordinateur, que l’on pourrait utiliser sans la connaître ni la comprendre. De ce point de vue, le libre s’inscrit pleinement dans la vision qui considère que les usagers de l’informatique doivent comprendre et maîtriser les outils conceptuels qu’ils utilisent. Les créateurs d’informatique aussi, bien évidemment.

Maurice Nivat nous invite opportunément à relire André Leroy Gourhan qui nous a appris que l’outil n’est rien sans le geste qui l’accompagne et l’idée que se fait l’utilisateur de l’outil de l’objet à façonner[2]. Et d’ajouter : « Ce qui était vrai de nos lointains ancêtres du Neanderthal, quand ils fabriquaient des lames de rasoir en taillant des silex est toujours vrai : l’apprentissage de l’outil ne peut se faire sans apprentissage du geste qui va avec ni sans compréhension du mode de fonctionnement de l’outil, de son action sur la matière travaillée, ni sans formation d’une idée précise de la puissance de l’outil et de ses limites ».

Il faut donc former à l’outil. Il faut donner une culture générale informatique à l’ « honnête homme » de notre époque. Or, si une option d’informatique générale a existé au lycée dans les années quatre-vingt, elle a été supprimée au début des années quatre-vingt-dix. La ligne pédagogique selon laquelle les apprentissages doivent se faire à travers les usages de l’outil informatique dans les différentes disciplines existantes, et cela suffit, l’avait emporté, pour des raisons diverses (elle prendra la forme du Brevet informatique et internet, le B2i). Une longue « traversée du désert » commençait. Pour autant, des voix se faisaient entendre. Elles disaient que l’informatique étant partout (dans les autres disciplines scolaires), elle devait être quelque part en particulier, à un moment donné, sous la forme d’une discipline scolaire en tant que telle car la seule utilisation d’un outil, matériel ou conceptuel, ne suffit pas pour le maîtriser.

Gérard Berry, qui avait intitulé sa leçon inaugurale au Collège de France « Pourquoi et comment le monde devient numérique »[3], déclarait dans une interview au journal Le Monde, le 15 avril 2009 : « Du point de vue de l’enseignement de l’informatique, la France rentre résolument dans le XXe siècle. »[4]. Il regrettait que l’« on confonde la notion de computer literacy avec celle de computer sciences ». Et il ajoutait : « Dans les établissements scolaires, on a fait le choix d’enseigner les usages. C’est très insuffisant. C’est la différence entre apprendre à conduire et comprendre comment marche une voiture. Les jeunes quittent le lycée sans connaissance de la science informatique. C’est une aberration ! » .

L’association EPI (Enseignement Public et Informatique) et le groupe ITIC de l’ASTI ont pris ces dernières années de nombreuses initiatives en faveur d’un enseignement de l’informatique au lycée sous la forme d’une discipline d’enseignement général : audiences auprès des autorités de la République, tables rondes, séminaires, textes divers, propositions de programmes scolaires pour le lycée…[5]. Un tel enseignement doit comporter des apprentissages corrrespondant aux grands domaines de la science informatique, à savoir l’algorithmique et la programmation, la théorie de l’information, les machines et leurs architectures, les réseaux, Internet, les bases de données.

Dans le cadre de la réforme du lycée, un enseignement de spécialité optionnel « Informatique et sciences du numérique » a été créé en Terminale S pour la rentrée 2012. Dans son discours devant le Conseil supérieur de l’Éducation, le 10 décembre 2009, s’exprimant sur cette réforme du lycée, Luc Chatel a notamment déclaré : « A l’heure de la société de l’information et de la connaissance, la France a besoin plus que jamais de compétences scientifiques en informatique. Aujourd’hui l’informatique représente 30 % de la recherche et développement dans le monde. Aujourd’hui l’informatique est partout. Nous ne pouvons pas manquer ce rendez-vous majeur et c’est la raison pour laquelle nous proposons en série S une spécialisation « informatique et sciences du numérique » »[6].

Tous ceux qui se sont prononcés en faveur d’une telle mesure se félicitent. Parmi ceux-ci, et ce n’est pas un hasard, figure l’APRIL (« Promouvoir et défendre le logiciel libre »). Dans un communiqué de presse, le 5 janvier 2010, l’association, rappelant qu’«elle a toujours été favorable à ce que l’informatique soit une composante à part entière de la culture générale scolaire de tous les élèves sous la forme notamment d’un enseignement d’une discipline scientifique et technique », souligne « cette première et importante avancée signe d’une certaine rupture »[7]. Elle mentionne que « l’expérience de ces dernières années a clairement montré que le B2i ne fonctionnait pas. Son échec prévisible tient notamment à des problèmes insolubles d’organisation, de coordination et de cohérence des contributions supposées et spontanées des disciplines enseignées. De plus ne sont pas explicitées les connaissances scientifiques et techniques correspondant aux compétences visées. »

Le rapport de la mission parlementaire de Jean-Michel Fourgous, député des Yvelines, sur la modernisation de l’école par le numérique, « Réussir l’école numérique », remis au Ministre de l’Éducation nationale Luc Chatel le 15 février dernier, va dans le même sens[8]. Il met en évidence la portée de cet enseignement de l’informatique : « En créant une matière Informatique et sciences du numérique en terminale, le gouvernement français ouvre enfin la voie de l’apprentissage du numérique et redonne à l’école son rôle d’éducateur. » Et rappelle qu’en définitive le B2i ne correspond pas aux enjeux car « il ne permet pas d’acquérir une culture informatique, permettant de comprendre les techniques sous-tendant le fonctionnement des divers outils numériques… ne prenant pas en compte les connaissances techniques de base nécessaires ».

Si le libre est une composante à part entière de l’informatique, il n’en comporte pas moins des spécificités, qui doivent donner lieu à des enseignements dédiés, notamment dans le Supérieur. Il existe une « science du logiciel libre ». Voir l’article de Roberto Di Cosmo auquel nous nous référons ci-après[9].

Si les collaborations avec des partenaires dispersés géographiquement ne datent pas d’aujourd’hui, avec Internet la situation a radicalement changé. La question est posée de savoir sur quels principes scientifiques se fondent des projets comme Wikipédia ou Linux, exemples extrêmes de travail massivement collaboratif. Et de savoir comment en améliorer la stabilité et la fiabilité. Dans le développement du noyau Linux, chaque erreur, ou chaque fonction manquante ou obsolète, peut entraîner des dysfonctionnements majeurs rendant l’ensemble inutilisable. Malgré tout, le « phénomène Linux » a abouti à des versions de plus en plus complètes, fonctionnelles et stables. En fait, le succès des logiciels libres de qualité reposent sur des approches méthodologiques très structurées. L’organisation modulaire du code source, la sélection sévère des contributions et l’existence d’un noyau central de développeurs s’assurant de la cohérence de l’ensemble jouent un rôle essentiel dans la réussite de Linux. Mais la taille atteinte par Linux est telle que l’on est aux limites de ce qui peut être maîtrisé en s’appuyant sur les capacités organisationnelles des communautés. Les logiciels libres sont donc devenus un champ d’étude à part entière pour les informaticiens. Il faut résoudre des questions scientifiques (par exemple, comment gérer rapidement la modification d’un appel de fonction résultant de l’ajout, du changement ou de la suppression d’un paramètre ?). Le projet Coccinelle a fourni une contribution majeure en introduisant la notion de « patch sémantique ». Le projet Mancoosi vise à développer des algorithmes efficaces pour permettre aux utilisateurs d’exprimer leurs préférences lors de mises à jour et d’obtenir des installations personnalisées.

Toutes ces actions de recherche se traduiront dans des enseignements universitaires, pour le libre mais aussi l’informatique en général.

Dans leur rapport sur l’économie de l’immatériel, Maurice Lévy et Jean-Pierre Jouyet attirent l’attention sur le fait que, dans cette économie, « l’incapacité à maîtriser les TIC constituera (…) une nouvelle forme d’illettrisme, aussi dommageable que le fait de ne pas savoir lire et écrire ». Ils mettent en évidence les obstacles qui freinent l’adaptation de notre pays à l’économie de l’immatériel, notamment « notre manière de penser », invitant à changer un certain nombre de « nos réflexes collectifs fondés sur une économie essentiellement industrielle »[10]. Il faut former à l’informatique.

John Sulston, prix Nobel de médecine, évoquant en décembre 2002 dans les colonnes du Monde Diplomatique les risques de privatisation du génome humain, disait que « les données de base doivent être accessibles à tous, pour que chacun puisse les interpréter, les modifier et les transmettre, à l’instar du modèle de l’open source pour les logiciels ». Il existe une transférabilité de l’approche du libre à la réalisation et la mise à disposition des biens informationnels en général. On a pu le constater à l’occasion des vifs débats qui ont accompagné la transposition par le Parlement en 2006 de la directive européenne sur les Droits d’auteur et les droits voisins dans la société de l’information (DADVSI), ou plus récemment avec la loi Hadopi. Le libre, ses approches et ses méthodes, ses façons efficaces de produire des biens de connaissance qui relèvent du paradigme de la recherche scientifique, ses modèles économiques et ses réponses en termes de propriété intellectuelle, est omniprésent dans les problématiques de l’immatériel. Il faut former à l’informatique libre. Les élèves et les étudiants, travailleurs et citoyens d’aujourd’hui ou de demain, doivent en avoir entendu parler lors de leur scolarité et de leurs études. Le libre est à la fois une réponse concrète à des problèmes concrets et un outil de réflexion pour penser les problématiques générales de l’immatériel et la connaissance.

La création de logiciels libres est un travail collaboratif : cette manière de créer du savoir à plusieurs est particulièrement importante si nous voulons préparer les plus jeunes à entrer dans une société du savoir partagé. Certains d’entre eux seront enseignants. Les enseignants ont besoin de documents, de contenus pédagogiques. Pour se former et pour enseigner. Et ils sont bien placés pour les concevoir et les produire eux-mêmes. L’on sait la transférabilité de l’approche du logiciel libre à la réalisation des contenus pédagogiques. Tout le monde, ou presque, connaît les réalisations remarquables de l’association Sésamath[11], « vaisseau-amiral » de la production collaborative de ressources pédagogiques libres, qui a obtenu un prix spécial de l’UNESCO.

Et il faut attacher une licence à un contenu produit. Les Creative Commons sont de mieux en mieux connues mais il reste du chemin à parcourir. Il faut faire connaître leurs modalités juridiques au service de l’objectif général, clairement exprimé, de favoriser la diffusion et l’accès pour tous aux oeuvres de l’esprit, en conciliant les droits légitimes des auteurs et des usagers. Creative Commons renverse le principe de l’autorisation obligatoire. Il permet à l’auteur d’autoriser par avance, et non au coup par coup, certains usages et d’en informer le public. Il est autorisé d’autoriser. C’est incontournable à l’heure d’Internet et du numérique car, sinon, toute vie intellectuelle serait impossible si l’on ne pouvait parler librement des oeuvres et s’il fallait, pour la moindre citation, demander l’autorisation à l’auteur ou à ses héritiers.

Que de nombreux autres enseignants, à la manière de Sésamath, fabriquent des contenus libres dans des démarches de mutualisation et de coopération est une raison supplémentaire de former au libre.

Jean-Pierre Archambault

CNDP-CRDP de Paris, coordonnateur du pôle de compétences logiciels libres du SCEREN

[1] Extra Ketchup (Creative Commons By-Sa)

[2] « L’informatique, science de l’outil », Maurice Nivat (à paraître dans EpiNet 124) http://www.epi.asso.fr/

[3] Leçon inaugurale le 17 janvier 2008, Cours Séminaires du Collège de France, par Gérard Berry titulaire de la chaire d’innovation technologique Liliane Bettencourt http://www.college-de-france.fr/default/EN/all/inn_tec2007/

[4] « Gérard Berry : L’informatique est une science », de Christian Bonrepaux dans le Cahier Éducation du Monde daté du 16 avril 2009. http://www.lemonde.fr/societe/article/2009/04/15/gerard-berry-l-informatique-est-une-science_1181041_3224.html

[5] $http://www.epi.asso.fr/blocnote/blocsom.htm#itic On pourra aussi se référer, pour les élèves à partir de l’école primaire, à la version francaise de « Computer Science Unplugged » : http://interstices.info/jcms/c_47072/enseigner-et-apprendre-les-sciences-informatiques-a-l-ecole

[6] http://www.education.gouv.fr/cid49972/reforme-du-lycee-discours-devant-le-conseil-superieur-de-l-education.html

[7] http://www.epi.asso.fr/revue/docu/d1001a.htm

[8] http://www.reussirlecolenumerique.fr/

[9] « La science du logiciel libre », Roberto Di Cosmo, La Recherche n°436, décembre 2009 – Professeur à l’Université Paris 7, Roberto Di Cosmo « porte » le projet de centre de recherche sur le logiciel libre de l’INRIA.

[10] Rapport remis à Thierry Breton en décembre 2006.

Le 5 février 2010 était inauguré à l’Université Paris Diderot le premier Centre de Formation Logiciels Libres (ou CF2L) dans le cadre de l’Université numérique Paris Île-de-France (UNPIdF).

Nous en avions annoncé ici-même la création et participé à diffuser le programme.

Cet évènement témoigne de l’intérêt croissant de l’université en général et de celles d’Île-de-France en particulier pour le logiciel libre. J’en veux pour preuve supplémentaire la présence de deux présidents et un vice-président d’université lors de cette inauguration.

Partie prenante de la formation, Framasoft était représenté par Pierre-Yves Gosset et moi-même. D’ordinaire les traditionnels discours officiels ont quelque chose de lisse et de convenu. Or nous avons été très agréablement surpris par l’acuité et la justesse des propos tenus ce soir-là. C’est aussi à cela que l’on mesure le chemin parcouru.

Mention spéciale à Vincent Berger, président de l’Université Paris Diderot et hôte de la manifestation, dont l’intervention m’a tant et si bien marquée que je n’ai pu m’empêcher de l’aborder pour lui demander l’aimable autorisation de la reproduire sur le Framablog.

Qu’il en soit ici chaleureusement remercié. Pour son accord, mais aussi et surtout pour être à la tête d’une université qui fait la part belle à un logiciel libre malicieusement associé ici à un oxymore.

De gauche à droite sur le photographie ci-dessus[1] :

Inauguration du Centre de Formation aux Logiciels Libres

Vendredi 5 février 2010

Salle des thèses, Université Paris Diderot

Mesdames et Messieurs,

Chers collègues,

Nous le savons tous et vous le savez mieux que quiconque, la société de l’information qui est la nôtre est une société de la circulation : circulation des savoirs, circulation des données, circulation des signes. Qui a accès aux moyens de cette communication peut espérer prendre part à cette société de l’information et en être un acteur.

On sait combien l’économie du partage des savoirs est aujourd’hui un enjeu complexe. On sait aussi combien le large accès aux moyens de l’information est un enjeu politique au sens le plus large et le plus noble du terme. L’accès à ces moyens d’information conditionne la réalité de l’exercice démocratique dans un monde aux cultures et aux pratiques toujours plus intégrées et globalisées.

Dans ce contexte, on sait quel est le rôle charnière de l’université. Sa mission hier comme aujourd’hui est de garantir l’accès du plus grand nombre à des savoirs et à des compétences complexes. Son rôle dans l’économie de la connaissance et de l’information lui enjoint de jouer un rôle ambitieux et volontaire dans la promotion et la diffusion d’une culture du partage.

En cela, la pratique universitaire — qu’elle soit pédagogique ou scientifique, qu’elle se déploie dans une salle de TD ou un laboratoire — participe du même esprit que celle du logiciel libre. La dynamique collégiale, l’énergie collective qui ont rendu le développement du logiciel libre possible relève de la même éthique du partage que celle de la recherche et de l’enseignement.

Les outils numériques ouverts ont connu un essor tel qu’aujourd’hui ils répondent à la quasi intégralité de nos besoins en technologie informatique. Accompagner leur développement, former les utilisateurs et les développeurs à leur utilisation et à leur développement, est désormais aussi la tâche de l’université. Le Centre de Formation aux Logiciels Libres (CF2L) répond à cet impératif.

Dans sa conception et sa gestation, ce Centre est aussi exemplaire d’une autre forme de dynamique collaborative que nous défendons aussi : celle qui doit permettre à des universités de dépasser leur logique propre pour faire advenir des synergies porteuse d’avenir, porteuse de nouveau. C’est le cas de l’Université Numérique Paris Ile de France, pilotée par l’université Paris 1 – Panthéon Sorbonne, dont l’une des actions est d’offrir en mutualisation des formations à destination des personnels, quels qu’ils soient, appartenant aux universités franciliennes. C’est aussi le cas du RTC (Regional Training Center), aujourd’hui hébergé par l’Université Paris Descartes, une initiative de l’Université numérique et d’Apple pour former les personnels des universités de la région parisienne aux usages du numérique. En 2011 devrait ouvrir aussi un centre de formation aux outils Microsoft.

Le Centre de Formation que nous inaugurons aujourd’hui s’inscrit dans ce même esprit. Il témoigne de l’investissement ancien de notre établissement dans l’usage et la défense du logiciel libre. L’UFR d’informatique a eu, dès le début des années 80, une action très volontariste dans l’usage et la promotion du numérique ouvert, avec la pratique d’Unix par exemple. L’Université a, dès les années 90 promu l’usage systématique de systèmes d’exploitation libres au sein du Service Commun de Ressources Informatiques Pédagogiques et Technologiques (le SCRIPT), dirigé aujourd’hui par Olivier Cardoso. De nombreux enseignements s’appuient sur des logiciels libres.

J’ouvre ici une parenthèse, j’aime beaucoup l’expression « logiciel libre » qui a le charme des oxymores, comme « la force tranquille . Je me rappelle que lorsque j’étais étudiant en Maths spé, on employait une technique d’intégration qui répondait au nom épatant de « méthode de la variation de la constante ». Le programme d’une révolution, en somme.

Le « logiciel libre » ressemble à la variation de la constante, parce que justement, le logiciel est une succession d’actions élémentaires qui sont censées s’enchaîner « logiquement », c’est-à-dire tout le contraire de la liberté. Je me rappelle aussi de mon sujet de philosophie au baccalauréat, qui s’intitulait « l’acte libre existe-il ? ». Je ne soupçonnais pas un instant que cette courte question deviendrait, bien au delà du petit tracas d’une dissertation de trois heures, le questionnement de toute une vie. Récemment, dans le cadre des discussions sur l’attribution des primes à l’université, nous avons été amenés à discuter de l’excellence, du mérite. Nous nous sommes vite rendu compte que la complexité de la discussion résidait dans le fait que nous touchions ici foncièrement à la question de la liberté. Si quelqu’un réussit davantage dans ses recherches simplement parce qu’il est plus intelligent, parce que le logiciel de ses gènes l’a programmé à être doué de capacités hors normes, peut-on parler de mérite ? Si c’est au contraire son éducation qui l’a programmé à faire preuve des qualités nécessaires pour atteindre l’excellence, où est le mérite ? Le mérite n’est-il pas lié intimement à la possibilité d’un acte libre ? La vie dans son ensemble est-elle un enchaînement logiciel d’actions complexes mais logiques, où laisse-t-elle place à la libre construction de son destin ? Cette expression, le « logiciel libre », m’évoque donc cet éternel sujet de philosophie.

Mais revenons à notre inauguration. Le Centre de Formation implanté à Paris Diderot constitue la suite logique de cet investissement de longue date dans l’économie du logiciel libre. Développé en partenariat avec Paris Descartes, il est aussi un exemple concret des partenariats lancés entre nos deux établissements afin de renforcer notre action commune dans le paysage universitaire francilien et national.

On le sait la liberté a de nombreux visages. L’économie ouverte du logiciel libre est de celle qui permettront demain, comme aujourd’hui, un plus libre partage des compétences informatiques. Nous ne pouvons que nous féliciter de la création de ce centre et remercier tous les collègues qui ont travaillé à sa mise en place, dont Jean-Baptiste Yunès et Thierry Stoehr qui ont été la cheville ouvrière du projet et qui défendent avec une énergie inlassable le développement des TICE et du logiciel libre dans notre établissement.

L’action citoyenne de notre établissement passe aussi par le soutien à cette action et je souhaite réaffirmer que, parmi les nombreux chantiers qui sont les nôtres, le développement de ces technologies engage notre avenir pédagogique. Il engage aussi notre mission de diffusion des savoirs. De cette diffusion nous sommes aussi comptables avec vous.

Je vous remercie.

[1] Crédit photo : Université Paris Diderot

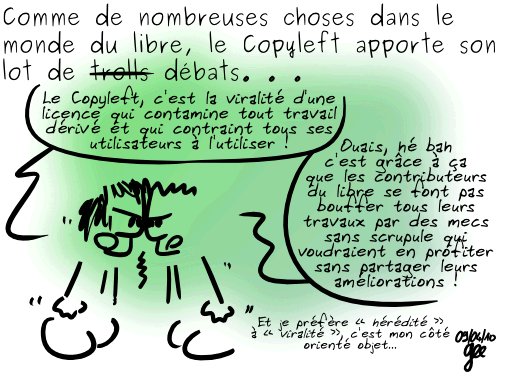

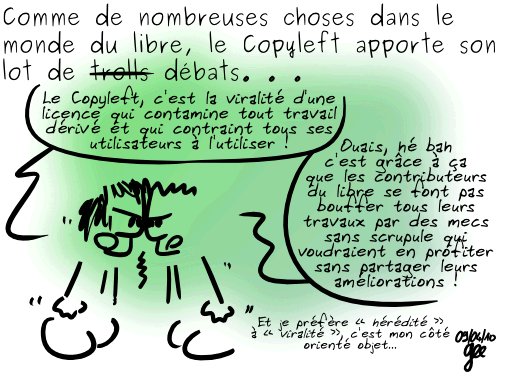

Dans la famille des grands trolls de la communauté, je demande Mono.

On attend avec impatience un futur dessin sur la Fondation Codeplex qui nous valu une belle passe d’armes entre Manuel de Icaza (à l’origine de Mono) et Richard Stallman (co-auteur de sa framabiographie) 😉

J’en profite pour signaler le concours de scénario lancé par notre ami Gee à l’occasion du prochain premier anniversaire de son blog.

Crédit : Simon Gee Giraudot (Creative Commons By-Sa)

On l’a évoqué longuement dans un précédent billet, l’avenir de la vidéo en lecture continue sur le Web est à un tournant de son histoire. Mais plus encore que le logiciel libre, il est fort difficile de sensibiliser le grand public sur ce sujet il est vrai technique et complexe.

On l’a évoqué longuement dans un précédent billet, l’avenir de la vidéo en lecture continue sur le Web est à un tournant de son histoire. Mais plus encore que le logiciel libre, il est fort difficile de sensibiliser le grand public sur ce sujet il est vrai technique et complexe.

L’évènement qui redistribue les cartes est le passage progressif de tous les navigateurs à la nouvelle version 5 du HTML permettant de lire directement une vidéo. C’est une bonne nouvelle parce que nous allons enfin pouvoir nous affranchir du format Flash qui était fermé et nécessitait l’installation d’un plugin propriétaire dédié (et mal supporté sur des OS libres comme GNU/Linux).

Mais si le HTML5 autorise donc les navigateurs à lire directement une vidéo, elle ne dit rien sur le format (ou le codec) dans lequel doit être publiée cette vidéo. Or aujourd’hui deux formats bien différents font acte de candidature : le format Ogg Theora et le format H.264.

Le premier problème c’est que si le Ogg Theora est libre (et gratuit), le H.264 est breveté et demande plusieurs millions par an aux navigateurs qui voudraient l’inclure et le supporter[1].

Le second problème c’est qu’à l’heure actuelle la balance penche nettement en faveur du H.264 qui, avec la future version 9 d’Internet Explorer sera lu par tous les navigateurs sauf Mozilla et Opera.

Il y a alors un double risque. Celui de quitter un format breveté (Flash) pour un autre format breveté (H.264) et celui d’ostraciser les navigateurs Opera et surtout Firefox (qui a déjà fort à faire actuellement avec la concurrence inavouée mais bien réelle de Chrome).

La pression est alors clairement sur les épaules de Mozilla. La fondation va-t-elle persister à refuser le H.264 pour des raisons économiques mais surtout éthiques, en devenant en quelque sorte le porte-drapeau de l’Ogg Theora ? Ou bien va-t-elle abdiquer pour ne pas voir ses parts de marché grignoter par d’autres navigateurs, et c’en sera alors fini des espoirs suscités par le Ogg Theora ?

On sait que l’on peut compter sur Wikimedia (qui a ouvert tout récemment le très opportun site Let’s get video on Wikipedia). Mais qu’adviendra-t-il de Google qui a pour le moment adopté le H.264 pour YouTube alors que la firme peut potentiellement mettre tout le monde d’accord en proposant un troisième format issu d’une récente acquisition ?

Dans l’article traduit ci-dessous, le journaliste Thom Holwerda ne cache pas sa préférence : il souhaite voir Mozilla résister. Mais il nous rappelle fort justement que la décision est également suspendue au choix du format des utilisateurs et développeurs Web lorsqu’ils mettront en ligne leurs futures vidéos.

Au nom du « pragmatisme », certains voudraient privilégier le H.264 ? N’oublions pas que pour les mêmes raisons nous nous enchainâmes à Internet Explorer 6 qui fit stagner pendant de longues années le Web tout entier.

Mozilla: Stick to Your Ideals, Shun H264

Thom Holwerda – 19 mars 2010 – OSNews.com

(Traduction Framalang : Antistress, Goofy et Quentin)

A présent que les caractéristiques d’Internet Explorer 9 ont été rendues publiques, nous connaissons mieux la position de Microsoft quant au codec vidéo à associer à la balise video de HTML5. Microsoft a choisi H264, un codec qu’il fournit déjà avec Windows de toute façon. Cela signifie que, Firefox et Opera mis à part, tous les principaux navigateurs prendront en charge le H264. D’aucuns y voient une raison pour que Mozilla abandonne ses idéaux et ajoute le support de H264. Je dis : Mozilla, reste fidèle à tes idéaux. Les dernières personnes à écouter en cette matière sont les développeurs Web.

Nous connaissons tous la situation de la vidéo via HTML5. Nous avons cette solution merveilleuse – une balise pour la vidéo aussi simple que pour les images – qui permet à chacun d’intégrer facilement des séquences vidéo sur son site Web sans avoir à recourir à la technologie propriétaire Flash. Il y a toutefois un problème.

Le problème est qu’il n’y a pas de codec standard pour HTML5. Les principaux compétiteurs sont H264 et Theora et il semble que ce dernier l’emporte pour le moment du côté des navigateurs. Une vidéo encodée avec Theora peut être vue à la fois des utilisateurs de Firefox, Chrome et Opera alors qu’avec H264 il vous manque les utilisateurs de Firefox et Opera. Si l’on considère que Firefox est, de loin, le plus répandu des navigateurs implémentant HTML5, encoder votre vidéo exclusivement en H264 revient à vous tirer une balle dans le pied.

Il y a une raison simple qui explique que Mozilla soit vent debout contre H264 : le codec est criblé de brevets. Cela signifie que, si vous utilisez le codec dans certaines parties du monde, vous vous exposez à devoir verser une redevance à la MPEG-LA qui gère les brevets de H264 (entre autres). Et, en effet, la MPEG-LA a clairement indiqué fin janvier que les utilisateurs finaux pouvaient eux aussi être la cible de contentieux relatifs aux brevets.

« J’aimerais aussi préciser que, bien que nos licences ne soient pas souscrites par les utilisateurs finaux, toute personne de la chaîne d’utilisation est responsable si un produit est utilisé sans licence » explique Allen Harkness, en charge des licences pour la MPEG-LA. « En conséquence, la redevance acquittée par le fournisseur d’un produit couvre l’utilisateur final, mais, lorsque la redevance n’a pas été acquittée, le produit est utilisé sans autorisation et toute personne de la chaîne (fournisseur ou utilisateur) peut en être tenue pour responsable ».

Étant donné que H264 est clairement incompatible avec les idéaux du logiciel libre, Mozilla a décidé de s’y opposer farouchement. Le refus d’Opera de souscrire une licence pour H264 n’a, de toute évidence, rien à voir avec un quelconque idéal (Opera étant un logiciel propriétaire après tout) mais la société norvégienne considère que le montant de la redevance est simplement trop élevé.

Apple pousse depuis longtemps H264 dans l’ensemble de ses logiciels et produits tandis que, du point de vue de Google, la redevance à acquitter pour avoir le droit d’utiliser H264 représente des clopinettes. Le dernier grand acteur à ne pas s’être prononcé était Microsoft qui, comme on pouvait s’y attendre, vient de choisir H264 simplement parce que la licence et le codec sont déjà inclus dans Windows. Le fait que des processeurs spécialisés dans le décodage de H264 soient disponibles sur les appareils portables constitue un autre atout tandis que Theora (ainsi que tout autre codec libre de brevet comme Dirac) ne peut se permettre ce luxe.

Du coup, des développeurs Web et autres pontes commencent à soutenir que Mozilla devrait rentrer dans le rang et souscrire une licence pour H264 sinon ils risquent de tuer la vidéo via HTML5. « J’ai des raisons de croire que la décision de Mozilla de ne pas prendre en charge les vidéos encodées en H264 dans la balise video de HTML5 à cause des nombreux brevets de ce codec est une mauvaise décision qui, à moins qu’ils ne changent d’avis, détruira tout espoir d’inaugurer une nouvelle ère où la vidéo serait accessible en ligne sans plugin » écrit Brian Crescimanno, un développeur Web qui est dans le métier depuis 1997.

Il explique qu’en campant sur ses positions, Mozilla va obliger les gens à continuer à utiliser Flash pour la vidéo vu que personne ne va encoder la vidéo deux fois uniquement pour qu’elle soit lue aussi par Firefox et Opera ; ils vont juste proposer aux utilisateurs de Firefox et Opera la vidéo encodée en H264 via Flash au lieu de ré-encoder la vidéo en Theora. Il fait remarquer également que Mozilla prenait en charge le format GIF du temps où il était propriétaire.

« Je conteste l’idée que être idéaliste soit votre raison d’être », écrit Crescimanno. « Je crois que votre responsabilité première en tant qu’éditeur d’un navigateur Web est de rendre le Web meilleur. C’est certainement ce que vous pensez sincèrement faire mais honnêtement, soyons réaliste, la seule chose que vous allez réussir c’est rendre la balise video de HTML5 inutilisable ».

Le billet de Crescimanno a été repris par John Gruber qui, rien de surprenant, abonde dans son sens : « par conséquent même ceux qui utilisent la dernière version de Firefox seront traités comme s’ils utilisaient un navigateur antique » explique Gruber. « L’intransigeance au nom de l’ouverture aura pour résultat que les utilisateurs de Firefox se verront proposer de la vidéo au moyen du plugin fermé Flash tandis qu’en coulisses la vidéo sera de toutes façons encodée en H264 ».

Gruber et Crescimanno soutiennent en fait que Mozilla devrait laisser son idéal de côté et se montrer pragmatique en implémentant le H264.

Petit retour en arrière. Il y dix ans de cela, le Web n’était pas encore la formidable source d’informations et de divertissements que nous connaissons aujourd’hui, il était à peine en train d’émerger. C’est ce moment qu’ont choisi les développeurs Web pour prendre au nom du « pragmatisme » une série de décisions d’une stupidité monumentale, décisions dont nous payons encore le prix une décennie plus tard.

Quand les développeurs Web se sont retrouvés face aux gigantesques parts de marché d’Internet Explorer 6, ils ne sont soucié de rien d’autre que de rendre les sites visibles pour cette triste version du navigateur, en faisant fi des standards au nom du « pragmatisme ». À cause de cette attitude, les autres navigateurs ont éprouvé les pires difficultés à concurrencer IE6, simplement parce que leurs utilisateurs ne pouvaient consulter leurs sites préférés optimisés pour IE6.

Dix ans plus tard, nous en voulons encore à Microsoft pour son Internet Explorer 6 qui aura rendu le Web dépendant à son égard (le nombre de sites spécifiques à IE est aujourd’hui devenu très faible mais pas nul) alors que la véritable raison pour laquelle IE est devenu si dominant et difficile à renverser est que les développeurs ne se sont pas donnés la peine de penser au delà du « pragmatisme » et de coder pour autre chose qu’IE.

Puis il y a eu Flash. Est-ce Microsoft qui nous a imposé Flash ? Est-ce Adobe qui nous a mis un revolver sur la tempe pour nous forcer à télécharger le plugin ? Non. Là encore ce sont les développeurs Web qui l’ont déployé partout sur le Web au nom du pragmatisme. Nous, les utilisateurs, ne décidons pas de télécharger Flash : nous y sommes forcés parce que les développeurs Web utilisent Flash pour tout et n’importe quoi, depuis les boutons jusqu’au lettres capitales illustrées.

Dix ans plus tard, Flash est devenu lui aussi un boulet qui entrave le Web. Les plateformes minoritaires comme Linux et Mac OS X n’ont pas suffisamment d’importance aux yeux d’Adobe pour l’inciter à développer correctement Flash dessus, sans parler de plateformes plus confidentielles encore, comme Syllable ou Haiku, qui n’ont pas du tout accès à Flash, rendant ainsi des sites aussi populaires que YouTube complètement inutilisables.

Qui allons-nous blâmer cette fois ? Je vois des développeurs Web et des blogueurs de renom comme Gruber s’en prendre à Adobe alors qu’en réalité ce sont les développeurs Web qui ont choisi Flash et l’ont rendu omniprésent sur le Web.

Et nous voilà à nouveau devant un problème similaire. Nous avons le choix pour le codec vidéo de HTML5 : l’un est libre, gratuit et n’est pas soumis à brevet, l’autre est breveté jusqu’à l’os et est tout sauf libre ou gratuit. Il y beaucoup de discussions pour savoir lequel des deux est de meilleure qualité, et vous trouverez des gens intelligents détaillant tests et arguments en faveur de l’un ou l’autre des deux codecs. Le seul avantage du H264 est, de toute évidence, le support matériel.

Et tandis que nous nous tenons à la croisée des chemins, ce sont encore les développeurs Web qui veulent faire le mauvais choix simplement parce qu’ils sont incapables de voir plus loin que le bout de leur nez. Ils se fichent de savoir à quoi ressemblera le Web dans dix ou même seulement cinq ans (quand la période d’essai gratuite sur le Web de H264 aura expiré), ils ne sont intéressés que par le présent. Ils ont fait des choix plus désastreux les uns que les autres, des choix qui ont gravement nuit au Web, et, pourtant, il faudrait que nous les écoutions encore ?

Cher Mozilla, contemple l’histoire du Web et vois l’impact désastreux d’Internet Explorer et de Flash. Regarde bien ensuite qui a fait en sorte que ces technologies nous soient imposées. Alors, et seulement alors, prends en compte à leur juste valeur leur opinion sur cette question.

A défaut, je prédis de quoi nous discuterons dans cinq ou dix ans : les développeurs Web et les pontes comme Gruber se lamenteront en se demandant comment le Web a pu embrasser sans restriction H264 à présent que la MPEG-LA a décidé de faire respecter ses brevets. Ils trouveront quelqu’un à blâmer : Microsoft, Adobe ou la lune, et, encore une fois, ils refuseront d’assumer leurs responsabilités.

Parfois il faut se jeter à l’eau. Bien sûr la transition vers un codec libre et gratuit sera difficile, mais les bénéfices escomptés le justifient amplement. Je préfère avoir affaire à une situation compliquée maintenant plutôt que de devoir faire face dans cinq ou dix ans à une situation aussi inextricable que celle engendrée par IE6 et Flash.

Si Google is not evil alors qu’il le prouve en libérant le format vidéo du Web ! Tel était le titre d’un récent article évoquant la situation actuelle et future de la vidéo en lecture continue (ou streaming), avec l’apparition des navigateurs compatibles HTML5 et sa fameuse balise <video>.

Or, mauvaise nouvelle pour Firefox, c’est le H.264 qui sera lui aussi implémenté dans la prochaine version d’Internet Explorer, neuvième du nom. Tristan Nitot en parle dans son billet Internet Explorer 9 : à boire et à manger.

Crédit : Simon Gee Giraudot (Creative Commons By-Sa)

Le 15 juin 2009 Daniel Cohn-Bendit publiait une tribune dans Le Monde au titre étonnant : Faisons passer la politique du système propriétaire à celui du logiciel libre.

Il récidive aujourd’hui dans Libération en profitant du clin d’œil historique que lui offre la date du 22 mars, pour lancer un nouvel appel au lendemain des élections régionales : Changer la politique pour changer de politique.

Extraits :

Le mouvement politique que nous devons construire ne peut s’apparenter à un parti traditionnel. Les enjeux du 21e siècle appellent à une métamorphose, à un réagencement de la forme même du politique. La démocratie exige une organisation qui respecte la pluralité et la singularité de ses composantes. Une biodiversité sociale et culturelle, directement animée par la vitalité de ses expériences et de ses idées. Nous avons besoin d’un mode d’organisation politique qui pense et mène la transformation sociale, en phase avec la société de la connaissance.

J’imagine une organisation pollinisatrice, qui butine les idées, les transporte et féconde d’autres parties du corps social avec ces idées. En pratique, la politique actuelle a exproprié les citoyens en les dépossédant de la Cité, au nom du rationalisme technocratique ou de l’émotion populiste. Il est nécessaire de « repolitiser » la société civile en même temps que de « civiliser » la société politique et faire passer la politique du système propriétaire à celui du logiciel libre.

(…) Ni parti-machine, ni parti-entreprise, je préférerais que nous inventions ensemble une « Coopérative politique » – c’est à dire une structure capable de produire du sens et de transmettre du sens politique et des décisions stratégiques. J’y vois le moyen de garantir à chacun la propriété commune du mouvement et la mutualisation de ses bénéfices politiques, le moyen de redonner du sens à l’engagement et à la réflexion politique.

(…) Encore une fois, l’important est moins d’où nous venons, mais où nous voulons aller, ensemble. C’est l’esprit même du rassemblement qui a fait notre force, cette volonté de construire un bien commun alternatif.

Ajoutez à cela le fait que parmi les signataires du Pacte du logiciel libre de l’April, près de la moitié sont d’Europe Écologie, dont on notera l’existence des groupes Culture et logiciels libres et Accès aux Savoirs / Propriété Intellectuelle, et vous obtenez selon moi un mouvement politique loin devant tous les autres en France actuellement pour ce qui concerne le logiciel libre et sa culture.

Tellement loin qu’à mon humble avis il « tue dans l’œuf » l’émergence d’un Parti Pirate national. Et pour appuyer mes dires, je vous propose reproduit ci-dessous un article fort intéressant issu justement du site d’Europe Écologie.

Et je le reproduis d’autant plus facilement que l’ensemble du site est sous licence libre Creative Commons By-Sa !

Je précise que je ne suis pas d’Europe Écologie (ni d’un autre parti d’ailleurs) et que je ne demande qu’à être contredit dans les commentaires 😉

Gaelle Krikorian – 5 novembre 2009 – Europe Écologie

Quel est le point commun entre un réseau de malades du sida thaïlandais, des militants pour la réduction des émissions polluantes suédois, des mobilisations d’internautes en France, des manifestations de fermiers indiens, d’associations de mal-voyants américains, de producteurs de coton kenyans, ou l’appel d’un philosophe argentin poursuivit en justice. Tous sont parties prenantes d’au moins un des conflits qui ont émergé depuis une dizaine d’années et mettent en question le système actuel de protection de la propriété intellectuelle.

La question de l’accès aux médicaments génériques dans les pays en développement a sans doute été l’une des revendications les plus visibles tant auprès du grand public que dans les sphères politiques. Elle a donné lieu à une forte mobilisation internationale. Mais en dépit d’avancées symboliques dans le cadre de l’Organisation Mondiale du Commerce (OMC), les malades des pays en développement restent globalement écartés de l’accès aux médicaments contre nombre de maladies, infectieuses (sida, hépatites, etc.) ou non-infectieuses (cancer, maladies cardio-vasculaire, etc.).

Parallèlement à ces inégalités d’accès, il est devenu de plus en plus évident que le bénéfice social escompté de l’application de la protection de la propriété intellectuelle –constituer une incitation et un moteur à la recherche médicale– était de moins en moins garanti. Dans le même temps, le cloisonnement de la connaissance par l’instauration de monopoles et la culture du secret, la restriction de ce qui appartient au domaine public ou relève d’un savoir commun, la limitation ou la disparition des exceptions qui permettent de faire prévaloir le droit des individus ou l’intérêt des sociétés, entravent la recherche et à l’innovation. Concrètement, les innovations réelles se font de plus en plus rares et de vastes domaines de recherche sont ignorés parce qu’ils n’ouvrent pas sur des opportunités financières jugées suffisantes. Ces échecs motivent débats et réflexions (par exemple au sein de l’OMS, de l’OMPI ou de différents Parlements) afin de permettre, grâce à divers mécanismes (la création de prix à l’innovation, de fonds internationaux, de traités internationaux pour la recherche, etc.), le financement d’une recherche adaptée aux besoins des différentes populations (du Nord et du Sud) sans compromettre l’accès de ses fruits au plus grand nombre.

En termes d’accès, ce qui vaut pour les médicaments s’applique à toutes sortes d’autres produits de la connaissance : logiciels, bases de données, musiques, films, livres (et notamment l’édition scolaire). L’accès à un libre flux d’idées ou d’informations est essentiel au développement de n’importe quel pays. Or, l’inégalité d’accès à l’éducation, aux connaissances et aux technologies est une réalité qui s’exacerbe avec l’accroissement des inégalités sociales dans le monde. Elle compromet la participation des populations à la production de savoirs nouveaux et donc exclut et entretient l’exclusion d’une partie importante de la population mondiale de la « société de l’information».

Dans le domaine du logiciel, la protection de la propriété intellectuelle qu’elle soit opérée par le biais d’outils juridiques ou de moyens techniques tend à interdire la reproduction, et par extension refreine la création en limitant les usages et les échanges. Alors que le logiciel n’entre en principe pas dans le champ du droit du brevet en Europe, l’Office européen accorde des brevets pour des logiciels. Ainsi, la même dynamique que dans la recherche médicale se met en place. Contrevenant aux principes de non exclusion et de non appropriation, qui caractérise les biens immatériels, les systèmes de protection en place favorisent les comportements opportunistes d’appropriation à des fins privées qui peuvent affecter la création, le développement et la diffusion d’un produit ou d’un service donné.

Ces réflexions émergent actuellement à propos de la lutte contre le changement climatique. À l’instar de la nécessité de développer des technologies moins polluantes ou non polluantes, le transfert de technologie est indispensable pour que les pays en développement puissent mettre en place des politiques industrielles, énergétiques et agricoles qui limitent la croissance de leurs émissions, puis la réduise. L’UNFCCC et le Protocole de Kyoto encouragent le transfert de technologie, comme avant eux les accords de l’OMC et de nombreux traités internationaux. Dans les faits pourtant, qu’il s’agisse de technologies non polluantes ou de technologies d’une toute autre nature, les transferts de technologies sont extrêmement limités entre pays industrialisés et pays en développement, et la propriété intellectuelle représente souvent un véritable obstacle. C’est pourquoi, dans le cadre des négociations pour le traité de Copenhague, les pays en développement revendiquent notamment l’application du droit à suspendre la propriété intellectuelle lorsque cela est nécessaire.

Le système actuel de propriété intellectuelle entraîne et entretient ainsi des discriminations fortes entre pays, entre classes d’individus, ou entre individus. Certaines populations, comme les aveugles et mal-voyants, sont en raison de handicaps particuliers plus exposées aux inégalités que crée le système de protection de la propriété intellectuelle. Dans le même temps, ces situations particulières soulèvent des problèmes ou dysfonctionnements qui concernent également d’autres catégories de populations.

Les discriminations produites par le système de propriété intellectuelle touchent d’autant plus de monde que le champs de ce qui est concerné par la propriété intellectuelle s’étend ––au vivant par exemple. En Inde, comme dans un certain nombre de pays en développement, des agriculteurs se sont mobilisés contre les droits privés sur les semences et le vivant en général et contre la biopiraterie qui permettent à une dizaine de firmes multinationales (comme Monsanto, Syngenta, Bayer and Dow Chemical) de devenir progressivement propriétaire de la biodiversité pourtant nécessaire à la sécurité alimentaire des populations des pays en développement.

Le terme de propriété intellectuelle a été créé et son utilisation s’est répandue à partir du milieu des années 1960. Il suggère une analogie avec la propriété physique qui a progressivement conduit le législateur à aborder brevets, marques et droits d’auteur comme s’il s’agissait d’objets physiques. Réussir à imposer ce terme a signé le succès de l’offensive stratégique menée par les détenteurs de droits – industries pharmaceutiques, industries du divertissement et de la culture. La construction même du terme est en soit une entreprise idéologique favorisant le renforcement des droits de certains ou de certains types de droits. Il s’agit tout à la fois d’élargir le champ de ce que l’on protège, en rognant de plus en plus sur le domaine public, d’allonger la durée des protections tout en inventant de nouvelles formes de monopoles (exclusivité des données, etc.).

Le mouvement lancé par les détenteurs de droits exclusifs depuis la fin des années 1970 n’a eu de cesse de complexifier un système qui se montre à la fois de plus en plus englobant et de plus en plus rigide. La stratégie menée conjointement par les pouvoirs publics et les détenteurs de droits est globalement, à l’image de la nouvelle loi Hadopi en France, de renforcer l’arsenal juridique tout en développant la répression des comportements. La répression du téléchargement est l’un des exemples les plus emblématiques de l’ampleur nouvelle qu’a pris cette tendance dans les pays riches. Ainsi en France un usager du peer-to-peer a récemment été condamné à 10 000 € d’amende. La répression s’exerce dans de nombreux pays sous de nombreuses formes : descentes policières contre les vendeurs de rues (présents de Manille à New York), confiscation d’ordinateur aux frontières, saisie de médicaments par les douanes, action en justice contre des professeurs trop zélés dans leur mission d’éducation et de démocratisation du savoir.

Ce système concourt à limiter l’accès à de nombreux produits dont des produits de santé vitaux. Il renforce les inégalités d’accès aux connaissances et aux savoirs, ce qui nuit au développement et à la cohésion sociale. Par les déséquilibres qu’il établit entre droits des détenteurs de brevets et droits des individus ou des sociétés, il est responsable du développement de pratiques anticoncurrentielles qui imposent des dépenses injustifiées aux individus comme aux sociétés. Alors qu’il est en théorie au service de la création, il renforce ou au minimum ignore les obstacles croissants que rencontrent les auteurs, artistes et inventeurs pour la création et l’innovation dérivée, tandis que les mécanismes supposés rémunérer les individus et communautés créatives, mais qui sont dans les faits inefficaces et injustes pour les créateurs comme pour les consommateurs, perdurent. En favorisant la concentration et le contrôle de la « propriété intellectuelle », il nuit au développement, à la diversité culturelle et au fonctionnement démocratique des institutions et des sociétés. Les mesures techniques destinées à forcer l’exécution des droits de propriété menacent les exceptions fondamentales sur les droits d’auteur qui bénéficient aux personnes atteintes de handicaps, aux bibliothèques, aux éducateurs, aux auteurs et consommateurs, tandis qu’elles mettent en danger la protection des données personnelles et les libertés. D’une façon générale, on peut s’interroger sur la légitimité de l’exclusivité lorsque celle-ci contrevient au droit à l’information, favorise le monopole privé sur le savoir et le patrimoine commun de l’humanité, niant ainsi l’utilité sociale du partage et le caractère relationnel de la création et limitant l’économie du savoir au bénéfice d’une partie limitée de la population mondiale.

De nouveaux modes de production et de nouveaux modèles industriels émergent avec les technologies digitales et l’Internet. Ceci affecte la création, la fabrication, la circulation et la valorisation des produits et services issus de la connaissance. Se pose la question de savoir comment ces évolutions s’opèrent, par quels principes elles sont guidées, si elles accroissent ou au contraire peuvent réduire les inégalités, quelle place elles font au non marchand, quels domaines elles lui confient, comment se redessinent les échanges au cœur même du système marchand. Pour l’heure, les nouvelles formes de production, de travail et de collaboration, plus propices à la création dans l’environnement digitale et avec l’Internet sont freinées par le modèle qui repose sur la protection toujours accrue des droits de propriété intellectuelle et d’une façon générale au modèle propriétaire qui est appliqué. Elles mettent en évidence le caractère absurde et obsolète du système en place, autant qu’elles se heurtent à son inflexibilité et ses tendances jusqu’au-boutistes.

Les conflits actuels sur la propriété intellectuelle et les mobilisations autour de « l’accès aux savoirs » qui ont émergé ces 10 dernières années attestent de l’intérêt d’une approche qui privilégie la notion de « l’accès » comme enjeu de revendications. Pratiquement, de nombreuses réflexions ont lieu sur le développement d’alternatives pratiques au modèle actuel qui soient à la fois moins excluant, plus juste et plus efficace – nouveaux modèles de financement, de répartition, de rémunération, de collaboration et de partage, etc. Ces mobilisations nous proposent, au travers du prisme de l’accès, de penser les problèmes différemment pour traduire les conflits sous des formes politiques mais aussi pour penser de solutions nouvelles.

La question de l’accès aux savoirs est une question centrale pour toute politique de transformation écologique et sociale. Elle est déterminante à l’émancipation des personnes. Elle est essentielle pour préserver la biodiversité et éviter les prédations commerciales. Elle est fondamentale à la richesse de l’innovation et aux transferts de technologies indispensables pour répondre aux crises et assurer le développement des sociétés.

Comme évoqué dans le billet Mark Shuttleworth d’Ubuntu n’est pas motivé par la haine de Microsoft, la distribution GNU/Linux Ubuntu a changé de peau.

Et c’est l’éternelle querelle des Anciens et des Modernes qui recommence…

(avec en prime un bon gros troll Apple à l’orée du bois)

Crédit : Simon Gee Giraudot (Creative Commons By-Sa)