Castopod : la voix du fédivers

Plus de soixante-quinze millions de podcasts sont téléchargés chaque mois dans notre pays par plus de douze millions de personnes.

Qui les fait ? Qui les écoute ? Nous avons interrogé Benjamin Bellamy, co-créateur de Castopod —en audio, s’il vous plaît.

La transcription de l’entretien

Bonjour ! Selon une enquête Médiamétrie sortie en décembre 2022 « Les chiffres clés de la consommation de podcasts en France », plus de soixante-quinze millions de podcasts sont téléchargés chaque mois dans notre pays par plus de douze millions de personnes. C’est donc un phénomène qui a conquis toute la Gaule. Toute, pas tout à fait puisqu’il reste au moins un indi… irréductible, voilà, je commence à bafouiller, c’est bien, qui est passé à côté c’est-à-dire moi.

Aujourd’hui nous avons eu l’idée d’interviewer Benjamin qui, lui, est très impliqué dans le monde du podcast et pour lui faire honneur nous faisons donc cet entretien en audio, ce qui n’est pas l’habitude dans le Framablog.

Benjamin, est-ce que tu peux te présenter ?

Oui, bien sûr, Frédéric. Bonjour. Donc je m’appelle Benjamin Bellamy.

En deux mots je suis né longtemps avant les réseaux sociaux mais après les cartes perforées et tout petit je suis tombé dans la marmite informatique.

J’écoute des podcasts depuis pas mal de temps et il y a deux ans avec trois associés j’ai créé une société qui y est exclusivement consacrée, Ad Aures.

Est-ce que tu peux présenter Castopod ? C’est quoi ? Un logiciel, une plate-forme, un oiseau, une fusée ?

Castopod qui donc est développée par Ad Aures, c’est un peu tout ça à la fois.

C’est d’abord un logiciel codé en PHP qui permet à toutes et à tous d’héberger plusieurs podcasts. Une fois en place, c’est-à-dire cinq minutes après avoir dézippé le paquet et lancé l’assistant d’installation c’est une plateforme d’hébergement de podcasts multipodcasts multi-utilisatrices multi-utilisateurs et enfin peu de gens le savent mais en imprimant le code source de Castopod sur une feuille A4 on obtient un superbe oiseau.

Pour la fusée en revanche j’avoue on est super en retard et rien n’est prêt.

Enfin, plus sérieusement, Castopod permet à tout le monde de mettre des podcasts en ligne afin qu’ils soient disponibles sur n’importe quelle plateforme d’écoute donc ça peut être évidemment Apple Podcast, Google Podcast, Deezer, Spotify, Podcast-Addict, PostFriends, Overcast,… Il y en a plein d’autres, donc vraiment partout. Castopod apporte tout ce dont on a besoin donc de la gestion de fichiers sonores MP3 évidemment à la gestion des métadonnées, des titres, des descriptions, la génération du fameux RSS, l’export de clips vidéo à partager sur les réseaux sociaux, les mesures d’audience etc.

Et d’autre part, Castopod est adapté tout autant aux podcastrices et aux podcasteurs en herbe qu’aux professionnels les plus chevronnés puisque avec une seule installation on peut avoir autant de podcasts qu’on veut autant de comptes utilisateurs qu’on veut et enfin Castopod est open source, libre et gratuit, et il promeut et intègre des initiatives ouvertes telles que celles de Podcasting 2.0 qui permet entre autres la gestion de transcription et de sous-titrage de liens de financement de chapitres de géolocalisation de contenu de gestion des intervenants et de commentaires inter-plateforme et encore plein d’autres choses.

Qu’est-ce qui t’a poussé à lancer Casopod ?

Qu’est-ce qui m’a poussé à lancer Castopod, tu veux dire : qui m’a poussé à lancer Castopod ? D’une certaine manière c’est Framasoft.

En fait en mars 2019 alors que je cherchais une plateforme de podcasts compatible avec le fédivers j’ai contacté Framasoft pour savoir si vous aviez pas ça dans les tuyaux. Naïvement j’étais persuadé que la réponse serait « ben oui, évidemment » et là la douche froide : « non pas du tout ».

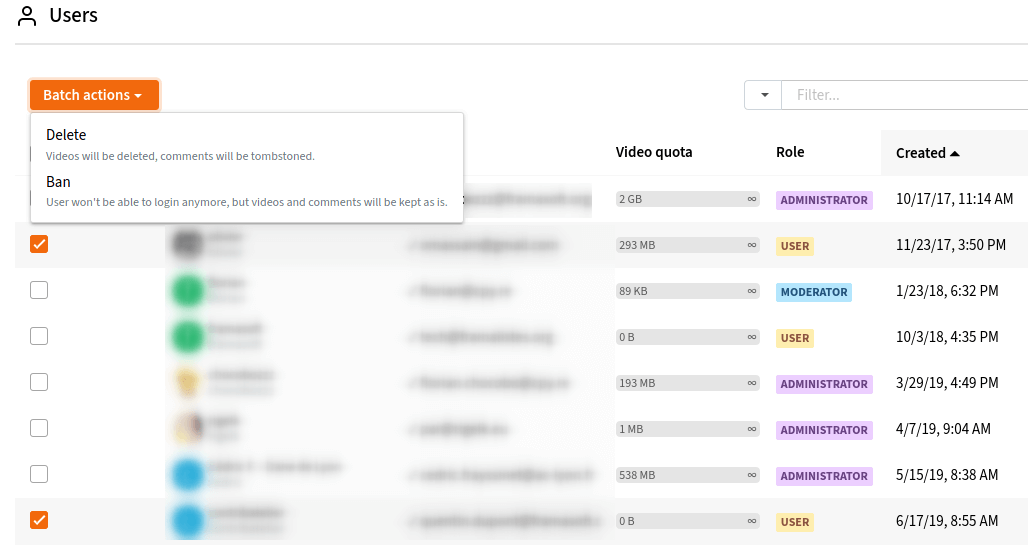

Et à ce moment-là Chocobozzz m’avait expliqué qu’avec les développements de Peertube et Mobilizon qui avaient été lancés un petit peu avant en décembre 2018 Framasoft n’avait pas le temps de se consacrer à un autre projet.

Heureuse coïncidence, à ce moment-là Ludovic Dubost le créateur de Xwiki m’a raconté comment il avait obtenu un financement de NLnet pour CryptPad. Donc j’ai déposé un dossier qui a été accepté immédiatement et qui en plus de nous faire très plaisir nous a confortés quant à la pertinence du projet.

Les podcasts m’ont l’air d’être gratuits dans la majorité des cas. Quel est le modèle économique ? Comment est-ce qu’ils en vivent, les gens ?

Il y a plusieurs modèles économiques du podcast.

Déjà effectivement il est important de noter qu’aujourd’hui quatre-vingt-dix-neuf pour cent des podcasts n’ont pas de modèle au sens capitaliste du terme, ce qui ne veut pas pour autant dire qu’ils sont gratuits.

Les podcastrices et les podcasteurs se rémunèrent de façon indirecte par le plaisir que ça procure, pour la promotion d’un autre produit ou service, pour l’exposition médiatique, etc. et quant au pourcent restant… Il existe plein de manières de gagner de l’argent.

On peut vendre un abonnement, encourager ses auditrices et ses auditeurs à donner des pourboires, on peut gagner des bitcoins par seconde d’écoute, on peut lire de la publicité, on peut produire un podcast de marque, on peut insérer automatiquement des spots publicitaires sonores, on peut afficher de la publicité à l’écran… par exemple chez Ad Aures notre spécialité c’est l’affichage publicitaire de recommandations contextuelles donc sans cookie ni profilage de l’internaute.

Et quel est le modèle économique de Castopod, alors ? Si je te dis que la société Ad Aures est l’équivalent de Canonical pour Ubuntu, est-ce que tu le prends mal ?

En fait c’est plutôt flatteur. On n’a pas du tout la prétention de devenir le Canonical du podcast même si effectivement on peut y voir des similitudes.

Pour répondre à ta question comme je l’ai laissé entendre plus tôt Castopod a bénéficié d’une subvention européenne qui a permis de financer le démarrage du développement. Ad Aures, la société que j’ai créée avec mes associés a également financé une grosse part du développement.

On compte sur les contributions de toutes celles et ceux qui souhaitent qu’on puisse continuer à maintenir et à faire grandir Castopod au travers de la plateforme Open Collective et enfin à on lance à l’heure où on parle tout juste d’une offre d’hébergement payante clés en main qui va donc permettre à toutes et à tous d’utiliser Castopod sans avoir à s’occuper du moindre aspect technique de l’hébergement.

On se rapproche plutôt du modèle de Piwigo, alors ?

Euh, exactement, ouais.

Alors la question qui pique. Moi je te connais, on s’est rencontrés, euh, il n’y a pas si longtemps que ça, au salon Open-Source Experience et je te connais comme un vrai libriste très engagé… et tu proposes de mettre de la pub sur les «postcasses» des gens ! J’arriverai jamais à prononcer «podcast» correctement ! Alors est-ce que la pub c’est compatible avec ton engagement libriste ?

Alors je vois pas pourquoi ça ne serait pas parce que en fait publicité et open source, ces deux concepts ont absolument rien à voir, même si je comprends ce que tu veux dire.

Personnellement, moi, je considère que la publicité en soi déjà ce n’est pas sale et c’est pas honteux et… Ce qui lui a donné une mauvaise réputation c’est le profilage à outrance des internautes est ça ouais c’est pas terrible, je suis d’accord mais justement nous ce qu’on propose c’est des publicités qui sont non invasives sans profilage sans cookie, pertinentes parce que en relation directe avec le contenu qui les héberge et ça permet d’offrir une rémunération à celles et à ceux qui produisent les contenus.

Chez nous il n’y a pas de pub pour le tout dernier jeu super addictif ou le top dix des choses qu’on ignorait pouvoir faire avec un cure-dent et un balai de chiottes.

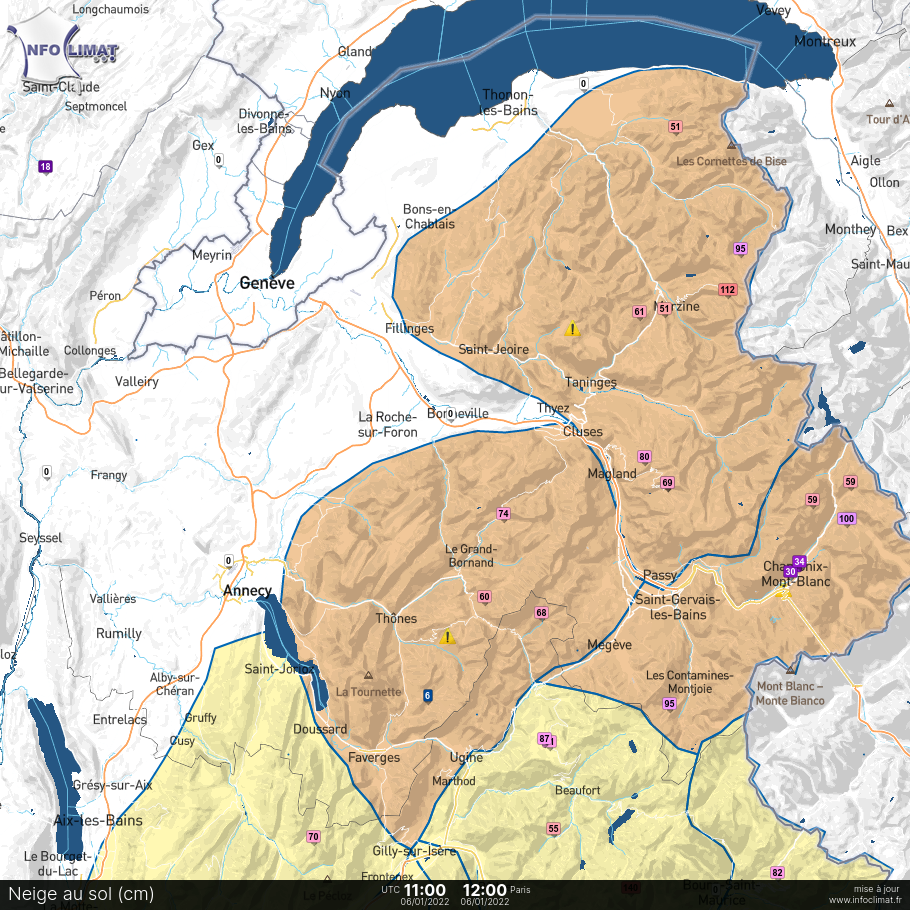

Nous on va plutôt mettre en avant un bouquin en lien direct avec les métadonnées et avec le contenu sonore du podcast grâce au concept que notre moteur d’analyse sémantique aura détecté.

Alors d’un point de vue pratique comment est-ce qu’on fait pour avoir des podcasts dans son smartphone sans blinder sa mémoire ? Parce que moi j’oublie pas que je suis toujours à court de mémoire.

Eh eh, c’est là que que je vois qu’effectivement tu n’es pas un expert du podcast parce que un podcast en moyenne c’est quarante minutes.

Pour avoir une bonne qualité, voire même une très bonne qualité il faut compter 192 kilobits par seconde. Ce qui fait que un bon gros podcast ça fait moins de 100 méga-octets. Si en plus tu considères que aujourd’hui on est connecté la plupart du temps à Internet du coup pour écouter un podcast il n’y a pas nécessairement besoin de le pré-télécharger. On se rend vite compte que l’espace de stockage nécessaire c’est pas vraiment le souci.

OK, alors moi j’ai un autre problème quand est-ce que les gens ont le temps d’écouter des podcasts ? En faisant autre chose en même temps ?

Bah ça c’est la magie du podcast. Le podcast il laisse les mains et les pieds et les yeux totalement libres. Si tu fais le bilan d’une journée, en fait, tu te rends compte que les occasions elles sont super nombreuses.

Tu as le petit-déj, dans ta voiture, dans les transports, en faisant du sport, en attendant un rendez-vous, en faisant son ménage. Personnellement je ne fais plus la vaisselle sans mon podcast.

OK, mais le temps d’une vaisselle suffit pour écouter un podcast ? C’est quoi la durée idéale d’un podcast ?

Alors… J’ai envie dire déjà ça dépend de ta dextérité à faire la vaisselle. Peut-être que la mienne est pas au top et que justement comme j’écoute des podcasts, eh bien, je ne progresse pas beaucoup. La durée idéale d’un podcast, ben, c’est un peu comme la longueur idéale des jambes, c’est quand elles touchent bien le sol. C’est affaire de contexte parce que si euh les statistiques font état donc d’une durée moyenne de quarante minutes il y a tout plein de circonstances pour écouter un podcast. Donc en fait il y a plein de durées idéales.

Le contexte d’écoute c’est un critère déterminant.

Je ne vais pas chercher le même type et la même longueur, la même durée, de podcast pour le café du matin que pour le café du TGV Paris-Biarritz ! À chaque contexte d’écoute il y a une durée idéale.

Alors, qui produit des podcasts ? Est-ce qu’il y a une grosse offre française ? Moi je ne connais que celui de Tristan Nitot mais en effet je ne suis pas spécialiste.

Sur les quatre millions de podcasts dans le monde il y en a 72 000 qui sont francophones ce qui veut dire qu’il y en a beaucoup et qui a beaucoup plus d’heures de podcasts francophones publiés chaque jour qu’il y a d’heures dans une journée. Même si tu les écoutes en vitesse deux fois sans dormir tu ne pourras pas tout écouter.

L’une des particularités du marché français c’est l’importance de l’offre radiophonique parce que les Françaises et les Français sont très attachés à leurs radios, bien plus que dans les autres pays du monde, d’ailleurs. Et donc c’est naturellement qu’on retrouve les radios en bonne place dans les études d’écoute de podcasts. En France il y a également beaucoup de studios de podcasts d’une très grande qualité, vraiment beaucoup, et enfin et c’est ce qui est génial avec le podcasting : n’importe qui peut se lancer que ce soit pour une heure une semaine un an ou dix.

Ma fille a lancé le sien à dix ans !

Ah oui, les poésies d’Héloïse, tu m’as dit ça tout à l’heure.

C’est ça !

Est-ce qu’on a besoin de beaucoup de matériel pour faire un podcast ?

On a besoin que d’un bon micro, des idées, évidemment, euh, d’Audacity, Castopod, et ça suffit, hop-là, on se lance ?

La première chose dont on a besoin c’est l’envie puis l’idée et euh… et c’est tout !

Aujourd’hui n’importe quel téléphone moderne est capable d’enregistrer une voix bien mieux que les enregistreurs hors de prix qu’on avait dans les années quatre-vingts !

Si tu savais combien de podcasts sont en fait enregistrés au téléphone sous une couette ou dans une taie d’oreiller ! Bien entendu, et ce n’est pas valable que pour le podcast, hein, plus on avance et plus on devient exigeant et un bon microphone et une bonne carte son, ça fera vite la différence. Mais les contraintes techniques ne doivent pas brider la créativité.

En ce qui concerne le montage donc tu as cité Audacity. Je l’utilise de temps à autre mais je suis plutôt «Team Ardour». La grosse différence c’est qu’Audacity est destructif. C’est-à-dire que tu ne peux pas annuler une manipulation que tu as faite il y a deux heures alors qu’avec Ardour qui est non-destructif… deux ans après avoir bossé sur un montage tu peux encore tout corriger et revenir sur n’importe quelle opération.

Et enfin sur l’hébergement bah il y en a pour tous les besoins, tous les goûts, tous les profils, tous les podcasts, mais la seule solution qui à la fois open source certifié podcasting 2.0 et connectée au fédiverse c’est Castopod.

Qu’est-ce que tu écoutes, toi, comme podcasts ? Est-ce que tu as des conseils pour les personnes qui souhaitent une sélection ?

On mettra les liens dans les commentaires.

Ah c’est un peu audacieux de demander à un inconnu un conseil podcast, c’est un peu comme demander un conseil gastronomique à un inconnu dans la rue.

Surtout que personnellement j’ai une sélection qui est assez éclectique et pas très originale.

Dans les podcasts que j’écoute régulièrement… Il y a Podland, Podnews, Podcasting 2.0, The Europeans, Décryptualité, Libre à vous, L’Octet vert que tu as cité et Sans Algo. Et puis j’écoute aussi beaucoup de d’émission de radio du service public podcastées quand elles sont pas sauvagement supprimées des plateformes ouvertes, suivez mon regard…

Alors c’est quoi ton regard ? Tu peux les citer ou… ?

Non je ne veux me fâcher avec personne.

J’ai vu que Castopod était compatibles Activitypub. Alors ça veut dire quoi concrètement pour les gens qui nous écoutent ?

Alors

Activitypub c’est un protocole… c’est un protocole standard normalisé par le W3C, donc c’est pas vraiment des rigolos quand il s’agit de définir une norme, qui permet à toutes les plateformes de réseaux sociaux qui l’implémente de connecter leur contenu et leurs utilisatrices et leurs utilisateurs entre eux l’ensemble des plateformes qui utilisent Activitypub est appelé le fédiverse qui est un mot-valise contraction de «univers» et «fédérer». La plus emblématique de ces plateformes c’est Mastodon quel est donc une plateforme de microblogging semblable à Twitter qui connaît un succès considérable depuis 2017 et récemment on en entend beaucoup parler suite au rachat de Twitter et on compte aujourd’hui plusieurs milliers de serveurs Mastodon et plusieurs millions d’utilisatrices et utilisateurs.

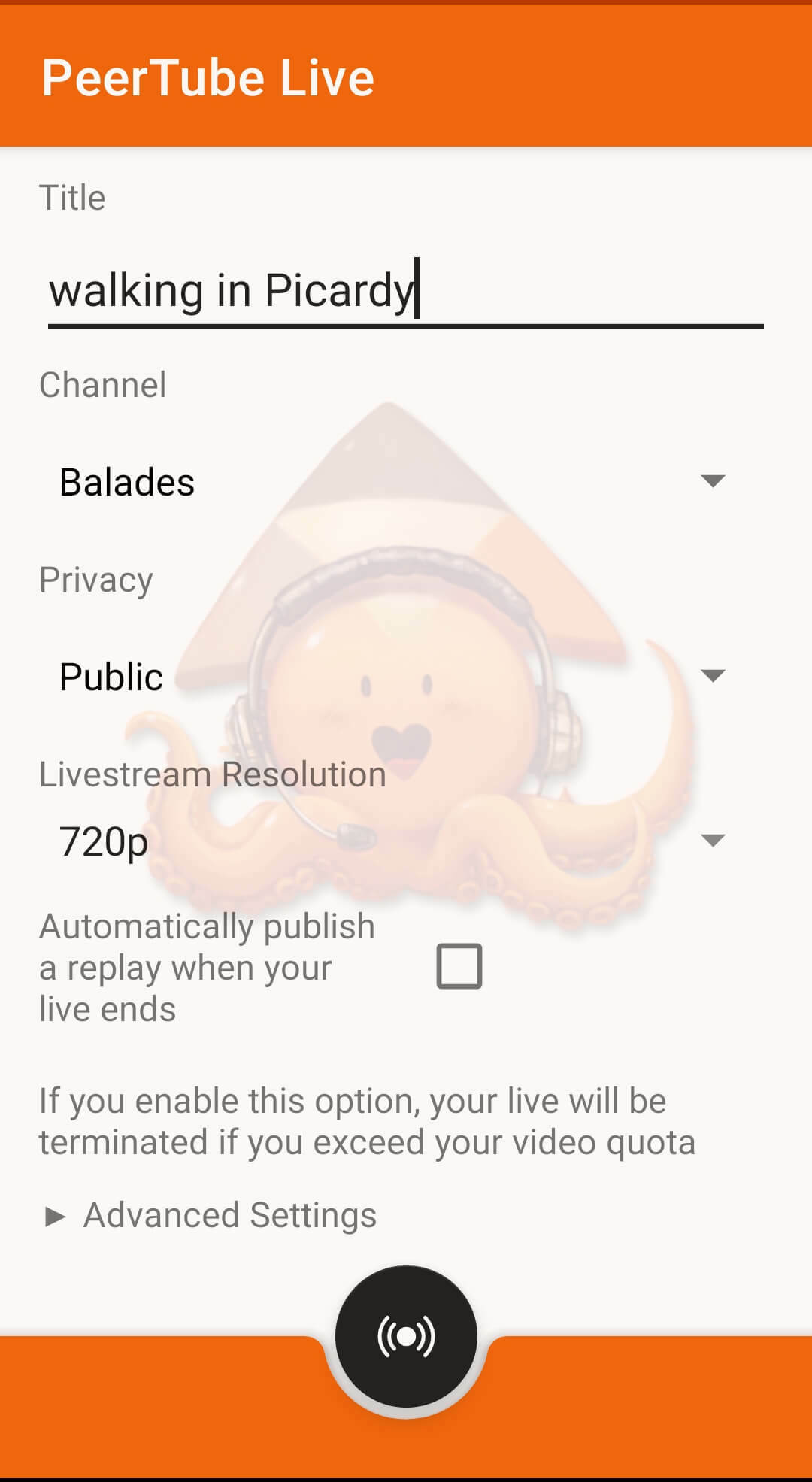

Là où franchement ça devient génial et même au-delà de Mastodon c’est que le fédiverse permet de mutualiser et d’interconnecter plein plein plein de serveurs sur des technologies diverses, différentes, pourvu qu’il implémente Activitypub. Par exemple une utilisatrice ou un utilisateur pourra depuis un un compte Mastodon donc un unique compte Mastodon interagir avec d’autres qui sont connectés depuis un ou plusieurs serveurs Pixelfed, du partage de photos façon Instagram depuis des serveurs Peertube partage de vidéos façon Youtube depuis des serveurs Bookwyrm qui est un service de partage de critiques littéraires depuis les serveurs Funkwhale qui permet du partage de musique depuis Mobilizon, nous en parlions tout à l’heure, qui permet de partager de l’organisation d’événements et depuis Castopod qui permet le partage de podcasts.

Donc concrètement imagine c’est comme si depuis ton compte Twitter tu pouvais « liker » une photo Instagram, commenter une vidéo Youtube, partager une musique SoundCloud.

Alors évidemment bah ça c’est pas possible. C’est pas possible chez les GAFAM.

Mais sur le fédivers ça l’est ! C’est possible, et c’est possible aujourd’hui ! Ce qui fait que ben avec Castopod le podcast est le réseau social donc tes auditrices et tes auditeurs peuvent commenter, partager ou aimer un épisode directement sans aucun intermédiaire. Aucun intermédiaire, qu’il soit technique ou juridique, hein sans GAFAM, sans plateforme privative entre les deux tu as la garantie de ne pas te prendre un «strike» parce que tu as fait usage de ton droit de citation tu ne vas pas avoir ton compte bloqué parce que t’as utilisé des mots-clefs qui sont indésirables et pas de censure automatique par un idiot de «bot» qui ne sait dialoguer qu’en éructant des réponses pré-formatées.

Et tout cela en étant accessible à des millions d’utilisatrices et utilisateurs sur des milliers de serveurs du fédivers. Honnêtement, n’ayons pas peur de le dire, l’avenir des réseaux sociaux sera fédivers ou ne sera pas !

Ça me rappelle quelqu’un, tiens… Alors tu as mentionné, quand on a parlé de podcast, tout à l’heure, tu vois je n’arrive pas à le prononcer, décidément.

Tu as mentionné Podcast-Index quand on s’est parlé en préparant l’interview et tu as parlé de Podcasting 2.0 tout à l’heure. Qu’est-ce que c’est ?

Alors…

Hum…

Laisse-moi chausser mes lunettes parce que cette question nécessite qu’on s’arrête une petite heure, une petite heure et demie sur

l’histoire du podcast.

Je ne suis pas sûr qu’il nous reste autant (de temps).

Alors là je vais… je vais abréger.

Bien avant les iPods, en 1989, l’émission « l’illusion d’une radio indépendante » (“Иллюзия независимого радио”) ouvre la voie aux podcasts qu’on connaît aujourd’hui en proposant en URSS des émissions sonores qui à l’époque étaient diffusées sur des cassettes et des bandes magnétiques et de « URSS » à « RSS » il n’y a qu’un U, celui de « Uuuuuuh ! quel jeu de mot tout pourri !» jeux de mots que je m’abstiendrai donc de faire.

Trop tard !…

Et donc sans jeu de mots et bien plus tard c’est en octobre 2000 que Tristan Louis, comme son nom peut le laisser penser il est français, il a l’idée d’inclure des fichiers MP3 dans un flux RSS. RSS lui-même créé et promu par des véritables légendes tel que Ramanathan V. Guha, Dave Winer ou Aaron Swartz.

Et donc il crée la technologie qui est celle que tous les podcasts du monde utilisent encore aujourd’hui. Après ça alors qu’on parlait plutôt d’audio blogging à l’époque, Ben Hammersley, journaliste au Guardian, est le premier à lancer le mot podcast en février 2004 qui est un mot-valise entre « iPod » et broadcasting, broadcasting pour « diffusion » en anglais.

Ce qui fera vraiment connaître le podcast au grand public c’est d’abord les contenus par exemple “Daily Source Code” d’Adam Curry lancé à l’été 2004, et ensuite l’intégration des podcasts par Apple dans iTunes 4.9 en juin 2005.

Et puis pas grand-chose pendant toute une décennie ! En fait l’histoire du podcast elle aurait pu s’arrêter là.

Mais en 2014, Sarah Koenig va bousculer littéralement un écosystème un peu moribond en publiant Serial le podcast aux 350 millions de téléchargements et c’est à ce moment-là qu’un véritable engouement populaire pour les podcasts apparaît.

C’est impressionnant, comme chiffre !

Ah oui, c’est impressionnant, oui… C’est impressionnant surtout que ça n’arrête pas de croître ! C’est un très bon podcast d’ailleurs Serial, j’adore. Il y a trois saisons et les trois sont très très bien. Si on comprend l’anglais c’est vraiment un podcast à écouter, Serial.

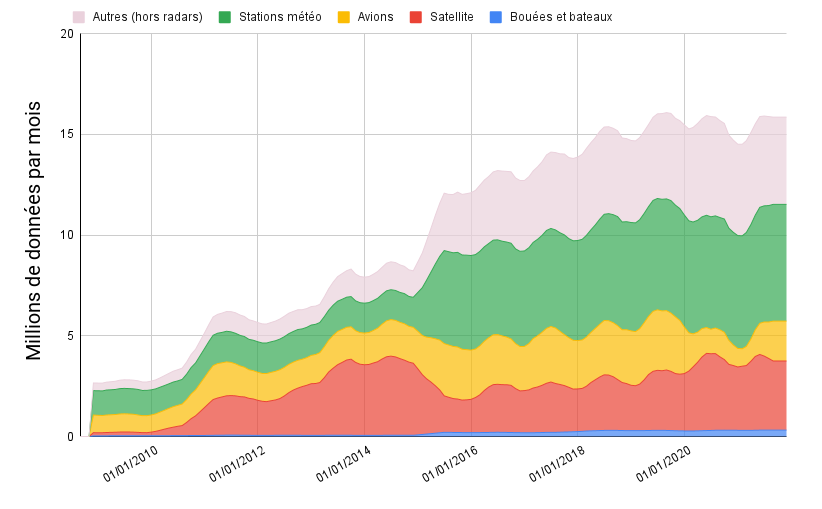

Néanmoins malgré ce renouveau force est de constater que,en plus de quinze ans, pas une seule – et alors que les usages du web entre-temps ont été révolutionnées par le haut débit les smartphones les réseaux sociaux le cloud etc. – donc pas une seule innovation technologique n’est venue bousculer le podcast.

Statu quo fonctionnel et technologique.

Apple règne toujours en maître absolu sur son annuaire de podcasts et rien n’a évolué et à l’été 2019 Adam Curry le même que cité tout à l’heure et Dave Jones, insatisfaits de cette situation, décident de lancer en parallèle, non pas un non pas deux, mais bien trois projets afin de secouer un peu tout ça.

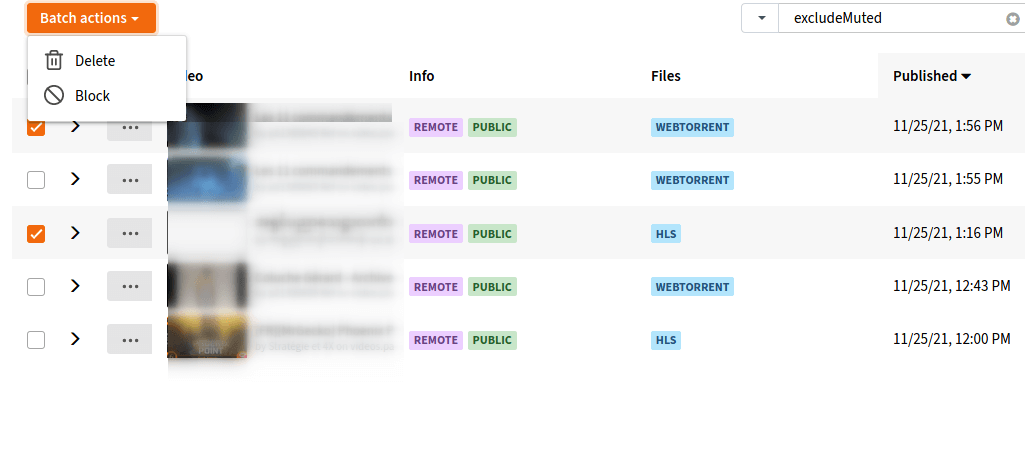

Premièrement et pour mettre fin à la dépendance vis-à-vis de l’index d’Apple ils créent un index de podcasts qui s’appelle Podcast-Index, pas super original, mais au moins on comprend ce que c’est. Il faut comprendre que là où l’index d’Apple requiert une validation d’Apple pour ajouter le moindre podcast mais également pour lire le contenu de l’index ce qui fait qu’Apple en fait a le pouvoir de vie ou de mort sur n’importe quelle application d’écoute qui n’utiliserait que son index.

Là où l’index d’Apple est soumis au bon vouloir d’Apple, Podcast-index est libre.

Il est libre en lecture et en écriture mais attention, vraiment libre par exemple la base de données de Podcast-index, elle est librement téléchargeable dans son intégralité en un clic depuis la page d’accueil. Tu n’as même pas besoin de créer un compte, de filer ton adresse mail, ton numéro de portable, ou le nom de jeune fille de ta mère. Et en plus de ça des API sont librement disponibles pour les applications mobiles Podcast-index référence aujourd’hui plus de quatre millions de podcasts. Apple aujourd’hui en a deux millions et demi.

Deuxièmement et pour rattraper le temps perdu, Adam et Dave décident de proposer de nouvelles fonctionnalités en créant des nouvelles méta-données, le « Podcast Namespace », qui ouvre la voie à ce qu’ils appellent « Podcasting 2.0 ».

Parmi les nombreuses fonctionnalités qui comprend comment on peut noter ben donc la gestion de transcription et de sous-titrage les liens de financement le chapitrage la géolocalisation contenus la gestion d’un intervenant. Il y en a plein d’autres ayant des nouvelles tout le temps, l’ensemble de ces spécifications euh et de ses innovations est librement consultable en ligne sur Github (on mettra le lien dans l’article, dans la description) et librement consultable encore une fois en lecture et en écriture.

C’est là en fait le troisième volet la troisième révolution, le mot est à peine exagéré hein qu’Adam et Dave vont apporter aux podcasts ; ils ont créé une communauté libre et ouverte où tout le monde peut apporter son temps son talent ou son trésor et force est de constater que ça fonctionne du tonnerre. En moins de six mois, alors que je rappelle qu’aucune innovation n’avait bousculé le podcast en quinze ans, en moins de six mois il y a plein d’applications d’écoute et d’hébergeurs évidemment dont Castopod qui ont rejoint le mouvement et qui ont intégré tout ou partie de ces nouvelles fonctionnalités. Donc cette communauté elle se rassemble sur Github sur Mastodon sur podcastindex.social dans un podcast éponyme et lors de réunions où on parle plutôt «techos».

Enfin le résultat c’est que la liste des applications et des services qui sont compatibles podcasting 2.0 est disponible sur le site podcasting.com. Clairement c’est sur ce site et sur podcastindex.org qui faut aujourd’hui choisir son application ou son hébergeur.

Alors moi je suis allé tourner un peu sur les sites de Castopod, je suis allé voir blog.castopod.org mais alors tout est en anglais là-dedans !

J’ai cherché un un petit bouton pour changer de langue et il n’y en a pas. Je croyais que le projet était français ? Pourquoi ça cause pas la langue de Molière ?

Le projet est français mais il est avant tout européen, enfin en tous cas d’un point de vue chronologique et et donc naturellement on a commencé par l’anglais et on n’a pas eu le temps de traduire cette partie-là mais ça va venir vite, c’est promis.

Oui parce que la doc en revanche elle a son site en français doc.castopod.org/fr et là j’étais content j’aurais dû commencer par là parce que il y a plein d’explications dans la doc.

Oui, alors la doc, on a pris le temps de la traduire en français et en plus la communauté aidant elle est également disponible en plus de l’anglais en brésilien1 et en norvégien et d’autres langues arriveront derrière.

Mais alors je suppose que c’est en fonction des contributeurs et des contributrices que le projet évolue ? Vous avez besoin de contributeurs de contributrices ? Comment est-ce qu’on peut faire pour vous aider ?

Ouais tout à fait mais Castopod c’est avant tout un projet ouvert hein donc le le code source est ouvert mais pas seulement on a besoin de développeuses et de développeurs mais également de traductrices de traducteurs de testeuses de testeurs de prescriptrices et de prescripteurs qui prêchent la bonne parole (merci Framasoft !) et puis de financement via Open Collective.

D’accord ! Alors comme d’habitude on te laisse le mot de la fin dans le Framablog. Est-ce qu’il y a des questions qu’on ne t’a pas posées ? Est-ce qu’il y a des choses que tu as envie d’ajouter ?

Écoute, je trouve que tu as mené cette interview d’une main de maître.

Merci de m’avoir reçu ! En fait je voudrais juste dire aux gens : essayez le podcast.

Vous avez un téléphone vous pouvez vous y mettre ; il ne faut pas être timides hein lancez-vous attendez pas des mois avant de créer le premier épisode car une fois qu’on a une idée on enregistre on publie et puis c’est ce que j’aime avec le podcast, on peut changer de modèle on peut changer de format on peut changer ce qu’on veut on peut tester il y a des hébergeurs pour tout le monde. Évidemment moi je vous engage à aller sur castopod.org pour voir ce que c’est pour voir ce qu’on propose.

Ah, si vous avez un peu la fibre technique eh bien n’hésitez pas à le télécharger et à l’installer, sachant que si vous avez pas la fibre technique et bah allez plutôt sur castopod.com où on propose des prestations d’hébergement clé en main. Et puis bon podcasting et bonne écoute !

Ah bah je vais m’y mette du coup je vais essayer de trouver quelques podcasts intéressants parce que c’est pas du tout ma culture ! En tout cas voilà grâce à toi je vais écouter des podcasts.

Merci beaucoup d’être venu parler avec nous et puis on espère longue vie à Castopod.

Merci à Framasoft.

À bientôt !

Pour aller plus loin

Sources, sites mentionnés

- https://www.mediametrie.fr/sites/default/files/2020-09/Les%20chiffres%20cl%C3%A9s%20de%20la%20consommation%20des%20podcasts%20en%20France.pdf

- https://podmust.com/podcast-definition-histoire/

- https://adaures.com/

- https://blog.castopod.org/

- https://docs.castopod.org/fr/

- https://podcastindex.org/

- https://github.com/Podcastindex-org/podcast-namespace

- https://nlnet.nl/project/Castopod/

- https://cryptpad.fr/

- https://opencollective.com/castopod

- https://www.audacityteam.org/download/

- https://community.ardour.org/download

- https://podcastindex.social/ sur Mastodon

- https://www.w3.org/TR/activitypub/

- https://fr.wikipedia.org/wiki/Fediverse

- https://pixelfed.org/

- https://bookwyrm.social/

- https://funkwhale.audio/

- https://joinmobilizon.org/fr/

L’illustration « Fred répète » a été réalisée avec Gégé, le générateur de Geektionnerd basé sur des dessins sous licence libre de SImon « Gee » Giraudot

Musique : Creative Commons by sa 2.5 license – Antiblues – from www.dogmazic.net/Tdbt

Podcasts

- Podland : https://www.podland.news/

- Podnews : https://podnews.net/

- Podcasting 2.0 : https://podcastindex.org/podcast/920666

- The Europeans : https://europeanspodcast.com/

- Code source : https://www.leparisien.fr/podcasts/code-source/

- Décryptualité : https://april.org/category/type-de-publication/decryptualite

- Libre à vous : https://www.libreavous.org/

- L’Octet vert : https://www.standblog.org/blog/post/2021/02/26/Je-lance-un-podcast-l-Octet-Vert

- Sans Algo : http://www.slate.fr/audio/sans-algo/

- Serial : https://serialpodcast.org/

- Les poésies d’Héloïse : https://lespoesiesdheloise.fr/