Pour ceux qui arrivent encore à résister aux sollicitations permanentes d’Internet pour réussir l’exploit de parcourir jusqu’au bout de longs documents, nous vous proposons aujourd’hui la lecture d’un article de Jean-Pierre Archambault, paru initialement dans la revue Terminal, qui interroge le présent mais surtout l’avenir des ressources pédagogiques à l’ère du numérique.

Pour ceux qui arrivent encore à résister aux sollicitations permanentes d’Internet pour réussir l’exploit de parcourir jusqu’au bout de longs documents, nous vous proposons aujourd’hui la lecture d’un article de Jean-Pierre Archambault, paru initialement dans la revue Terminal, qui interroge le présent mais surtout l’avenir des ressources pédagogiques à l’ère du numérique.

Parce que si l’on n’y prend pas garde, on pourrait bien vite se retrouver peu ou prou en face des mêmes tensions que celles qui ont été mises à jour lors de l’examen du projet de loi Création et Internet. Quid en effet d’un monde[1] où la propriété finirait par contraindre de trop l’accès et le partage, a fortiori à l’école ?

Numérique, droit d’auteur et pédagogie

Jean-Pierre Archambault

Terminal n° 102, Automne-Hiver 2008-2009, édition l’Harmattan, p. 143-155.

Les ressources pédagogiques utilisées dans les cours sont l’un des cœurs de l’enseignement, correspondant à des démarches et des conceptions d’apprentissage. Il y a les ressources que se procurent les enseignants. Éditées à des fins explicitement pédagogiques ou matériaux bruts non conçus initialement pour des usages scolaires, mais y trouvant naturellement leur place, comme une œuvre musicale ou une reproduction de tableau. Leurs modèles économiques et leurs modalités de propriété intellectuelle, vis-à-vis de l’institution éducative sont nécessairement distincts.

Il y a aussi les ressources produites par les enseignants eux-mêmes, aujourd’hui dans le contexte radicalement nouveau issu de l’omniprésence de l’ordinateur et d’Internet, à des échelles dont les ordres de grandeur sont sensiblement différents de ceux de l’ère du pré-numérique. Elles sont élaborées dans des processus collaboratifs qui appellent nécessairement des réponses en termes de droits d’auteur de nature à permettre et favoriser l’échange par une circulation fluide des documents.

La problématique juridique est vaste. Nous examinerons les licences de logiciels et de ressources libres – certains points qui font débat comme la sécurité juridique, considération importante pour les établissements scolaires. En effet, elles éclairent et illustrent la situation nouvelle et irréversible créée par l’irruption du numérique dans les processus de création de biens informationnels et la place de ceux-ci, sans cesse croissante, relativement et en valeur absolue. Nous poserons la question de l’exception pédagogique, en relation avec les missions de l’École et l’exercice concret du métier d’enseignant, au temps nouveau du numérique.

Un modèle français

Les ressources pédagogiques, au premier rang desquelles les manuels scolaires, mais aussi la banale préparation de cours, l’article ou la photographie « sur laquelle on est tombé »… ont toujours joué un rôle important dans l’exercice du métier d’enseignant, variable selon les disciplines. Comme support de cours bien sûr, mais aussi comme vecteur de mise en oeuvre de nouveaux programmes ou support de formation (derrière un scénario pédagogique, il y a toujours une pratique professionnelle). Il existe un modèle français de l’édition scolaire dont la figure centrale, le manuel des élèves, relève pour l’essentiel du secteur privé. Ce modèle a acquis ses lettres de noblesse et fait ses preuves depuis deux siècles. L’histoire de l’édition scolaire en France est l’histoire des relations entre trois acteurs majeurs, l’État, les éditeurs et les auteurs – des enseignants et des inspecteurs – et de leurs rapports de force mouvants, dans lesquels il arrive que la technique intervienne. Ainsi, à partir de 1811, un auteur ne peut plus soumettre directement à l’État un manuscrit sous prétexte, parmi d’autres raisons, que son examen est long et difficile. Une proposition de manuel doit être obligatoirement communiquée sous forme d’imprimé. L’éditeur devient, de fait, incontournable.

Depuis une quarantaine d’années, les manuels scolaires se sont profondément transformés. L’iconographie occupe jusqu’à 50 % de la surface. L’ouvrage permet des lectures plurielles et des usages multiples, qui préfigurent ceux de l’hypermédia. Il n’y a plus de cours en tant que tel… Le résultat combiné de cette complexité croissante des manuels, de la concurrence des méthodes actives et de la souplesse de la photocopie est sans appel : on constate depuis les années quatre-vingt une tendance à la perte de vitesse de l’utilisation du manuel traditionnel, même si l’attachement symbolique demeure[2][3]. L’enfant chéri de l’édition scolaire connaît une forme de crise…

Une rupture

…et le numérique arrive dans ce contexte. Rude concurrent ! En effet, le manuel scolaire, ce livre d’une centaine de pages, qu’on ne lit plus d’une façon linéaire mais dans lequel on navigue avec des index et des renvois, ce livre ne saurait rivaliser avec Internet et le multimédia, leurs hyperliens, leurs millions de pages et leurs outils de recherche automatisée. Le livre n’est désormais plus « l’enfant unique ».

Plus généralement, le numérique transforme radicalement le paysage éditorial installé. Certes, les enseignants ont toujours réalisé des documents à l’intention de leurs élèves, en préparant leurs cours. Jusqu’à l’arrivée de l’ordinateur et d’Internet, une élaboration collaborative avec des collègues et la visibilité des ressources produites ne pouvaient aller au-delà d’un cercle restreint et rapproché. Modifier un document écrit à la main était et demeure une opération lourde, qui plus est quand il circule et que chacun y met sa griffe. Dans les années 70 encore, les photocopieuses étaient rarissimes, les machines à alcool fastidieuses à utiliser.

Des échanges sur une plus grande échelle supposaient de mettre en forme des notes manuscrites, et la machine à écrire manquait de souplesse, ne tolérant pas vraiment les fautes de frappe. Le manuel scolaire était alors la seule perspective pour une diffusion élargie, l’éditeur le passage obligé, et on lui accordait d’autant plus facilement des droits sur la fabrication des ouvrages que l’on ne pouvait pas le faire soi-même ! Mais, aujourd’hui, les conditions de la production des ressources pédagogiques, numériques pour une part en augmentation régulière, ont donc radicalement changé, du fait de la banalisation des outils informatiques de réalisation des contenus (du traitement de texte aux logiciels de publication) et d’Internet qui favorise à la fois les productions individuelles et le développement du travail collectif des enseignants, dans leur établissement, ou disséminés sur un vaste territoire, à la manière des programmeurs qui écrivent des logiciels libres.

Il y a une transférabilité de l’approche du libre, des logiciels à la réalisation des autres biens immatériels. Internet permet aux auteurs de toucher un vaste public potentiel qui peut aisément reproduire leurs documents, les utiliser, les modifier… La profusion des ressources éducatives que l’on peut consulter sur Internet est là pour en témoigner. En nombre, les enseignants auteurs-utilisateurs sont devenus un acteur autonome à part entière de l’édition scolaire. On peut, pour le moins, parler de turbulences dans le secteur[4][5].

Sésamath

Cette association est synonyme d’excellence en matière de production pédagogique et de communauté d’enseignants-auteurs-utilisateurs. En effet, Sésamath a reçu une mention d’honneur pour le prix 2007 Unesco-Roi Hamad Bin Isa Al-Khalifa sur l’utilisation des technologies de l’information et de la communication dans l’éducation. L’Unesco a décidé d’attribuer une mention spéciale au projet de manuel libre « pour la qualité de ses supports pédagogiques et pour sa capacité démontrée à toucher un large public d’apprenants et d’enseignants ». L’association a également été récompensée aux Lutèce d’Or (Paris, capitale du libre). Elle regroupe une soixantaine de professeurs de mathématiques de collèges. De l’ordre de 400 contributeurs-auteurs utilisent régulièrement les outils de travail coopératif qu’elle a mis en place (Wiki, Spip, forums, listes de diffusion…). Animée d’une volonté forte de production de ressources sous licence libre, et si possible formats ouverts, Sésamath ne soutient que des projets collaboratifs dont elle favorise et encourage les synergies. L’association donne les résultats : environ un million de visiteurs sont comptabilisés chaque mois sur l’ensemble de ses sites. Parmi les projets soutenus par l’association figure Mathenpoche. Dix académies hébergent le logiciel sur un serveur local, en plus du serveur mis à disposition par Sésamath pour les professeurs des autres académies, en partenariat avec le Centre de ressources informatiques de Haute-Savoie (Citic74).

Ce sont ainsi 5 000 professeurs qui utilisent la version réseau de Mathenpoche à laquelle sont inscrits 260 000 élèves. Plus de 160 000 connexions élèves sont enregistrées sur les serveurs chaque mois, auxquelles il faut ajouter 236 000 connexions en accès libre sur le site public de Mathenpoche. MathémaTICE est une revue en ligne sur l’intégration des TICE dans l’enseignement des mathématiques, née en septembre 2006. Enfin, Le Manuel Sésamath pour la classe de cinquième, premier manuel scolaire libre, fruit du travail collaboratif d’une cinquantaine de collègues, s’est vendu à 72 000 exemplaires à la rentrée 2006. Le Manuel Sésamath pour la quatrième s’est vendu, lui, à plus de 90 000 exemplaires en septembre 2006. à n’en point douter, en cette rentrée 2008, le Manuel de troisième connaîtra le succès, comme ses prédécesseurs.

Les communautés d’enseignants auteurs-utilisateurs se multiplient[6][7][8]. Utilisant à plein les potentialités d’interaction du Web, elles fonctionnent comme les communautés de développeurs de logiciels libres. Leurs membres ont une vision et une identité communes. Organisées pour fédérer les contributions volontaires, dans une espèce de synthèse de « la cathédrale et du bazar », ces communautés répondent à des besoins non ou mal couverts et doivent compter en leur sein suffisamment de professionnels ayant des compétences en informatique. Les maîtres mots de la division du travail y sont « déléguez » et « distribuez ».

Les licences de logiciels libres

Les logiciels libres sont désormais une composante à part entière de l’informatique[9]. Parmi les raisons qui expliquent cette rapide évolution, le fait que l’approche du libre, qui relève du paradigme de la recherche scientifique, est en phase avec la nature profonde de l’activité d’écriture de logiciels (difficile par exemple de mener des projets combinant des millions et des millions de lignes de programme quand on n’a pas accès au code source) et qu’elle est ainsi gage d’efficacité et de qualité. Les enseignants utilisent des logiciels libres et certains en produisent. Pour autant, le long fleuve du libre, en général et dans l’éducation en particulier, n’est pas toujours tranquille. Intimement liées au modèle économique, il y a les réponses en termes de droit d’auteur. Et il arrive que des questions juridiques soient mises en avant, notamment celles ayant trait à la compatibilité des licences libres avec le droit français, à une certaine insécurité juridique. Qu’en est-il exactement ?[10].

La typologie classique des licences Logiciel libre comprend deux ensembles principaux, licences avec ou sans copyleft, et un cas spécial : le domaine public. La caractéristique des licences sans copyleft, dites type BSD est de ne pas obliger à conserver la même licence pour une oeuvre dérivée. Le code des logiciels utilisant ces licences peut donc être intégré dans du logiciel propriétaire ou du logiciel libre avec copyleft.

Les licences avec copyleft exigent qu’un logiciel dérivé conserve son statut de logiciel libre, notamment par la fourniture du code source de la version modifiée. En pratique, cela signifie qu’il n’est pas possible de diffuser un logiciel propriétaire incorporant du code utilisant une telle licence. La principale licence de ce type est la GNU General Public licence (GNU GPL) de la FSF (Free Software Fondation). D’autres licences de ce type sont la Lesser General Public License (LGPL) de la FSF, qui offre la possibilité de lier dynamiquement le programme à une application propriétaire. La LGPL est notamment utilisée par le projet OpenOffice.org. La licence CeCILL est une licence francophone proposée par le CEA, le CNRS et l’Inria pour les mondes de la recherche, de l’entreprise et des administrations, et plus généralement pour toute entité ou individu désirant diffuser ses résultats sous licence de logiciel libre, en toute sécurité juridique. Les auteurs de CeCILL l’ont déclarée compatible avec la GNU GPL. Et la FSF a indiqué que CeCILL faisait partie des licences compatibles avec la GNU GPL. Chaque licence doit préciser les licences qui lui sont compatibles.

« Une complexité conceptuelle de la licence GPL est qu’elle prétend ne pas être un contrat, ce qui peut poser des difficultés de compréhension en Europe ». Si, aux États-Unis, la GPL s’appuie essentiellement sur le copyright, en France et dans de nombreux pays d’Europe, l’habitude est de licencier les logiciels par des contrats, acceptés par les deux parties avec les clauses de responsabilité inhérentes aux contrats logiciels. « L’utilisation licite d’un programme sous GNU GPL n’impose pas une relation contractuelle entre l’utilisateur et le titulaire des droits d’auteur »[11]. Cette différence d’appréciation et la volonté d’avoir une licence d’origine française ou européenne basée sur une mécanique contractuelle sont à l’origine de la rédaction des licences CeCILL et EUPL. « Néanmoins, la validité de la licence GPL a été confirmée à plusieurs reprises par des tribunaux européens ». La diffusion sous des licences d’origine américaine comme la GNU GPL pouvant poser certaines questions de droit, engendrant des incertitudes qui peuvent dissuader des entreprises ou des organisations d’utiliser ou d’apporter leurs contributions aux logiciels libres. Dans ce contexte, le Cea, le Cnrs et l’Inria ont donc entrepris la rédaction de contrats de licences de logiciels libres visant à accroître la sécurité juridique « en désignant un droit applicable (et les tribunaux compétents pour juger d’éventuels litiges), en l’occurrence le droit français, conforme au droit européen et qui a vocation à concerner 27 pays », à préciser exactement l’étendue des droits cédés et à encadrer « la responsabilité et les garanties accordées par les concédants dans les limites permises par le droit français et européen ». Il y a une version française qui, avec la version anglaise fait également foi. Elle s’impose, de par la loi, aux organismes de recherche et établissements publics français.

L’utilisateur secondaire, c’est-à-dire la personne admise à utiliser un logiciel libre (vous et moi) à l’exclusion de tout acte de copie, de modification, d’adaptation et de distribution, est dans une situation juridique spéciale. Il n’a pas de relation contractuelle avec le concédant de la licence dans la mesure où il n’a pas consenti à la licence et ne connaît pas le plus souvent le concédant, auteur du logiciel libre qu’il utilise. « Il ne paraît pas possible de faire valoir un éventuel consentement implicite à la conclusion d’une licence et ce d’autant plus que le droit français ne permet pas en cette matière les accords tacites ».

Ces difficultés tiennent pour une part au droit, français notamment, qui, s’il accorde aux auteurs un droit exclusif sur leurs créations, ne dit rien d’explicite quant à des modalités leur permettant de faire connaître leurs volontés concernant les usages de leurs œuvres. Il y a là un vide juridique, sinon une forme d’incohérence. Cela étant, les licences de type GPL sont particulièrement protectrices des droits des utilisateurs dans la mesure où les contributeurs successifs s’obligent les uns les autres à respecter les dits droits, en s’appuyant sur les traités internationaux en matière de droit d’auteur. De plus, la publication et l’utilisation par les administrations françaises et européennes de licences libres (comme CeCILL et EUPL) traduisent la maturation juridique de la diffusion du libre, contribuant ainsi de fait, plus que fortement, à créer un environnement « sécurisé » pour les utilisateurs. Et puis, il y a des millions et des millions d’utilisateurs de logiciels libres en France et dans le monde. Une des vertus du droit étant de s’adapter aux évolutions, technologiques en particulier… l’insécurité, très relative, ne manquera pas de n’avoir été que momentanée.

Les licences de ressources libres

Les enseignants et les institutions éducatives ont encore tendance à mettre en ligne des ressources pédagogiques sans se poser explicitement la question de leurs licences. D’où un certain flou. Mais les licences de ressources libres ont commencé à faire leur chemin dans les problématiques éditoriales. Leur objectif est de favoriser le partage, la diffusion et l’accès pour tous sur Internet des œuvres de l’esprit, en conciliant les droits légitimes des auteurs et des usagers. Cela passe par des modalités juridiques correspondant aux potentialités de la Toile, notamment à cette possibilité de diffusion quasi instantanée d’une ressource immatérielle à des milliers et des millions de personnes. Le projet Creative Commons s’y emploie[12]. Il a vu le jour à l’université de Standford, au sein du Standford Law School Center for Internet et Society, Lawrence Lessig en étant l’un des initiateurs. Il s’agit donc d’adapter le droit des auteurs à Internet.

Creative Commons renverse le principe de l’autorisation obligatoire. Il permet à l’auteur d’autoriser par avance, et non au coup par coup, certains usages et d’en informer le public. Il est autorisé d’autoriser. Métalicence, Creative Commons permet aux auteurs de se fabriquer des licences, dans une espèce de jeu de Lego simple, constitué de seulement quatre briques. Première brique : attribution. L’utilisateur, qui souhaite diffuser une œuvre, doit mentionner l’auteur. Deuxième brique : commercialisation. L’auteur indique si son travail peut faire l’objet ou pas d’une utilisation commerciale. Troisième brique : non-dérivation. Un travail, s’il est diffusé, ne doit pas être modifié. Quatrième brique : partage à l’identique. Si l’auteur accepte que des modifications soient apportées à son travail, il impose que leur diffusion se fasse dans les mêmes termes que l’original, c’est-à-dire sous la même licence. La possibilité donnée à l’auteur de choisir parmi ces quatre composantes donne lieu à onze combinaisons de licences. Grâce à un moteur de licence proposé par le site de Creative Commons, l’auteur obtient automatiquement un code HTML à insérer sur son site qui renvoie directement vers le contrat adapté à ses désirs.

L’exception pédagogique

Les enseignants utilisent des documents qu’ils n’ont pas produits eux-mêmes, dans toutes les disciplines, mais particulièrement dans certaines d’entre d’elles comme l’histoire-géographie, les sciences économiques et sociales ou la musique : récitation d’un poème, lecture à haute voix d’un ouvrage, consultation d’un site Web… Ces utilisations en classe ne sont pas assimilables à l’usage privé. Elles sont soumises au monopole de l’auteur dans le cadre du principe de respect absolu de la propriété intellectuelle. Cela peut devenir mission impossible, tellement la contrainte et la complexité des droits se font fortes. Ainsi pour les photographies : droits du photographe, de l’agence, droit à l’image des personnes qui apparaissent sur la photo ou droit des propriétaires dont on aperçoit les bâtiments… Difficile d’imaginer les enseignants n’exerçant leur métier qu’avec le concours de leur avocat ! Mais nous avons vu les licences Creative Commons qui contribuent, en tout cas sont un puissant levier, à développer un domaine public élargi de la connaissance. Et la GNU GPL et le CeCILL qui permettent aux élèves et aux enseignants de retrouver, dans la légalité, leurs environnements de travail sans frais supplémentaires, ce qui est un facteur d’égalité et de démocratisation. Mais la question de l’exception pédagogique dans sa globalité, une vraie question, reste posée avec une acuité accrue de par le numérique : quelque part, le copyright est antinomique avec la logique et la puissance d’Internet.

L’exception pédagogique, c’est-à-dire l’exonération des droits d’auteurs sur les oeuvres utilisées dans le cadre des activités d’enseignement et de recherche, et des bibliothèques, concerne potentiellement des productions qui n’ont pas été réalisées à des fins éducatives. Par exemple, le Victoria and Albert Museum de Londres, à l’instar du Metropolitan Museum of art de New York, a décidé de ne plus facturer le droit de reproduction des œuvres de sa collection lorsqu’elles sont publiées à des fins d’enseignement, leur mise en ligne restant cependant soumise à conditions 13.

La société Autodesk a ouvert un portail étudiant de l’ingénierie et de la conception numérique depuis lequel les élèves, étudiants et enseignants de toutes les disciplines peuvent notamment télécharger gratuitement des versions pour étudiants de ses logiciels, toutes ses ressources concernant la conception architecturale, la conception graphique, le génie civil et la conception mécanique et électrique.

L’activité d’enseignement est désintéressée et toute la société en bénéficie. L’éducation n’est pas un coût mais le plus nécessaire (et le plus noble) des investissements. L’exception pédagogique a donc une forte légitimité sociétale. De plus, entrés dans la vie active, les élèves auront naturellement tendance à, par exemple, préconiser les logiciels qu’ils auront utilisés lors de leur scolarité. En la circonstance le système éducatif promeut des produits qu’il a pendant longtemps payé cher (avant que le libre contribue à une baisse sensible des prix pratiqués). D’un strict point de vue économique, il ne serait nullement aberrant que ce soit au contraire les éditeurs qui payent pour que les élèves utilisent leurs produits ! On n’en est pas encore là. Sans nier certains excès auxquels la photocopie non maîtrisée peut donner lieu, il ne faut pas oublier que les établissements d’enseignement contribuent déjà à la défense du droit d’auteur en versant des sommes importantes (près de trois millions d’euros de la part des universités) pour la photocopie d’œuvres protégées, au nom de la fameuse lutte contre le « photocopillage ». Les bibliothèques, quant à elles, doivent déjà faire face au paiement de droits de prêt diminuant fortement leur pouvoir d’achat.

On distingue le cas de l’édition scolaire dont la raison d’être est de réaliser des ressources pour l’éducation, et qui bien évidemment doit en vivre. L’édition scolaire traverse une période de turbulences de par le numérique. Les questions posées sont notamment celles de son positionnement par rapport aux productions enseignantes, du caractère raisonnable ou non des prix pratiqués, de l’existence d’un marché captif, d’un nouveau modèle économique combinant licences libres et rémunération sur les produits dérivés… mais pas celle du bien-fondé d’une légitime rémunération d’un travail fait, dans le contexte d’une école républicaine gratuite et laïque. Deux types de solutions existent pour assurer l’exception pédagogique : la voie contractuelle et la voie législative.

La voie contractuelle

En mars 2006, le ministère de l’Éducation nationale a signé des accords avec les syndicats d’éditeurs. Ils concernent les œuvres des arts visuels ; les enregistrements sonores d’oeuvres musicales, la vidéo-musique et les interprétations vivantes des œuvres musicales ; les œuvres cinématographiques et audiovisuelles ; les livres et les musiques imprimées ; les publications périodiques imprimées. Ils autorisent et limitent certains usages d’œuvres protégées par les enseignants, à des fins d’illustration des activités d’enseignement et de recherche. Ils couvrent une période allant de janvier 2007 à 2009, date à laquelle une exception sera inscrite dans le Code de la Propriété intellectuelle (CPI).

Les publics visés sont notamment la classe et la formation initiale. Les cas autorisés sont la diffusion ou projection en classe d’œuvres protégées de tout enregistrement audio (même intégral), de toute image, texte ou de partition, de toute œuvre audiovisuelle obtenue par un canal hertzien gratuit, de toute représentation (interprétation en particulier) en classe d’une œuvre ; la reproduction papier d’œuvres protégées pour les élèves de la classe (10 % maximum d’un livre ou d’une partition, 30 % d’un périodique) avec selon les types d’établissements un quota de copies par élève et par an ; la reproduction numérique d’images protégées donnée à titre temporaire pour toute œuvre diffusée en classe, avec un maximum de 20 images incorporées dans chaque travail pédagogique ou de recherche mis en ligne sur Intranet et des limitations (400 × 400 pixels, 72 dpi, pas de recadrage, pas d’accès direct aux œuvres, pas d’indexation, déclaration des œuvres par formulaire à l’AVA) ; la diffusion audio et audiovisuelle lors de concours ou colloques (extraits audio d’une œuvre limités à 30 secondes dans la limite de 10 % de la durée totale chacun, représentants, additionnés, moins de 15 % du total).

Les accords ne concernent notamment pas l’analyse d’une œuvre pour elle-même, la formation continue, l’utilisation en classe de DVD ou de VHS du commerce (les droits de diffusions ou de prêt doivent être alors acquittés par les centres de documentation des établissements), la création de bases d’œuvres protégées numérisées consultables en Intranet (sous forme de fichiers image, son ou vidéo en particulier), la distribution de fichiers numériques d’œuvres protégées aux élèves, la possibilité de faire des liens profonds sur des sites pour disposer, par exemple, d’extraits audio organisés de manière thématique.

Pour les livres et les musiques imprimées, les accords prévoient des vérifications (Article 10) : « Les représentants des ayants droit pourront procéder ou faire procéder à des vérifications portant sur la conformité des utilisations d’œuvres visées par l’accord au regard des clauses de l’accord. Les agents assermentés de chaque représentant des ayants droit auront la faculté d’accéder aux réseaux informatiques des établissements afin de procéder à toutes vérifications nécessaires. Ils pourront contrôler notamment l’exactitude des déclarations d’usage et la conformité de l’utilisation des œuvres visées par l’accord avec chaque stipulation de l’accord. En cas de manquement à ces obligations contractuelles, les représentants des ayants droit pourront requérir du chef d’établissement ou du responsable du réseau le retrait des œuvres ou extraits d’œuvres visées par l’accord utilisé illicitement. En cas de contestation sur l’application de l’accord, le comité de suivi se réunit pour constater l’absence de respect d’une clause de l’accord et proposer une solution aux parties. » Cette possibilité d’intrusion sur les réseaux des établissements scolaires a été diversement appréciée.

Des entraves à l’activité pédagogique

Les limitations prévues dans les accords (nombre de pixels, durée des extraits…) ne sont pas sans poser de réels problèmes pédagogiques. Yves Hulot, professeur d’éducation musicale à l’IUFM de Versailles (Cergy-Pontoise), en pointent quelques-uns. La combinaison d’une résolution limitée à 400 × 400 pixels et d’une définition de 72 dpi de la représentation numérique d’une œuvre avec une utilisation portant sur l’œuvre intégrale empêche le recours à des photos de détails des oeuvres.

Par exemple : « Le tableau Les noces de Cana de Véronèse comporte une intéressante viola da braccio au premier plan. Avec une telle limite de résolution sur cet immense tableau, il est impossible de projeter et de zoomer convenablement sur ce détail. Qui peut croire justifier de telles limitations ? » La durée des extraits d’une oeuvre musicale crée également des obstacles de nature pédagogique. « Si je travaille en classe de troisième sur la compagnie des Ballets russes, il me semble évident que pour apprécier l’importance de la révolution qu’elle apporta, une analyse d’au moins deux ballets s’impose, en l’occurrence L’après-midi d’un faune et Le sacre du Printemps, ce qui permet d’aborder deux musiciens capitaux, Debussy et Stravinsky. Le premier dure environ dix minutes, le second environ trente. Habitués que sont nos élèves à côtoyer majoritairement le genre chanson, il me semble utile de les confronter à d’autres durées et d’autres langages musicaux ou chorégraphiques. Mais je crains qu’à trop limiter l’activité pédagogique des enseignants on finisse par empêcher ceux qu’ils éduquent de réellement avoir les clés d’accès à la culture ! »

La voie législative

Les contenus numériques en ligne sont quasiment absents des accords précités. Est-ce un hasard ? L’affrontement fondamental est-il prudemment différé ? C’est principalement l’écrit numérique qui est envisagé, l’audio et l’audiovisuel en étant exclus. La mise en ligne d’images protégées suppose qu’elles soient incorporées à un travail pédagogique ou de recherche, et qu’elles soient limitées en qualité et en quantité. Ces accords couvrent essentiellement des activités de diffusion en classe, les seuls cas de reproduction à des fins de distribution concernent la photocopie. Les possibilités d’échange de fichiers numériques avec les élèves et les étudiants sont donc limitées, tout comme les échanges entre collègues lors de travaux interdisciplinaires.

Ils favorisent une offre éditoriale qui est de type catalogue et non sur-mesure ou granulaire malgré les développements récents de l’offre numérique. « En dehors du cadre et des limites prévus par les accords, l’obtention dans l’enseignement des droits d’exploitation d’œuvres protégées, représente une double difficulté : savoir à quels ayants droit demander les autorisations et avoir le budget éventuellement nécessaire pour s’en acquitter. D’où la nécessité de proposer un dispositif permettant aux enseignants d’être à la fois clairs du point de vue juridique et d’obtenir facilement les droits pour ce qu’ils se proposent de faire pour leurs élèves ou leurs étudiants. »[13]

Les enjeux de l’exception pédagogique demeurent

À l’occasion de la transposition par le Parlement, en 2006, de la directive européenne sur les Droits d’auteurs et les droits voisins dans la société de l’information (Dadvsi), qui prévoit la possibilité d’une exception pédagogique, la CPU (Conférence des présidents d’université) et l’ADBU (Association des directeurs de bibliothèque universitaire), constatant que la France était est l’un des rares pays européens à ne pas l’avoir retenue dans son projet de loi, redoutaient que cette législation n’aboutisse à une domination accrue de la littérature de langue anglaise déjà majoritaire parmi les ressources d’information disponibles en ligne, notre seule référence devenant Google et nos seules sources étant les données anglo-saxonnes.

Un amendement adopté lors du débat de 2006, applicable en 2009 (CPI L122-5 3-e), définit l’exception pédagogique comme : « La représentation ou la reproduction de courtes œuvres ou d’extraits d’œuvres, autres que des œuvres elles-mêmes conçues à des fins pédagogiques, à des fins exclusives d’illustration ou d’analyse dans le cadre de l’enseignement et de la recherche, à l’exclusion de toute activité ludique ou récréative, et sous réserve que le public auquel elles sont destinées soit strictement circonscrit au cercle des élèves, étudiants, enseignants et chercheurs directement concernés, que leur utilisation ne donne lieu à aucune exploitation commerciale, et qu’elle soit compensée par une rémunération négociée sur une base forfaitaire nonobstant la cession du droit de reproduction par reprographie mentionnée à l’article L. 122-10 ». Il comporte des aspects restrictifs. Le rendez-vous de 2009 est important.

Un usage loyal

Pierre-Yves Gosset, délégué de Framasoft, se prononce pour un système de fair use à l’américaine. Aux États-Unis, le fair use, (usage loyal, ou usage raisonnable, ou usage acceptable) est un ensemble de règles de droit, d’origine législative et jurisprudentielle, qui apportent des limitations et des exceptions aux droits exclusifs de l’auteur sur son œuvre (copyright). Il essaie de prendre en compte à la fois les intérêts des bénéficiaires des copy – rights et l’intérêt public, pour la distribution de travaux créatifs, en autorisant certains usages qui seraient, autrement, considérés comme illégaux. Des dispositions similaires existent également dans beaucoup d’autres pays.

Les critères actuels du fair use aux États-Unis sont énoncés au titre 17 du code des États-Unis, section 107 (limitations des droits exclusifs : usage loyal (fair use) : « Nonobstant les dispositions des sections 106 et 106A, l’usage loyal d’une oeuvre protégée, y compris des usages tels la reproduction par copie, l’enregistrement audiovisuel ou quelque autre moyen prévu par cette section, à des fins telles que la critique, le commentaire, l’information journalistique, l’enseignement (y compris des copies multiples à destination d’une classe), les études universitaires et la recherche, ne constitue pas une violation des droits d’auteur. Pour déterminer si l’usage particulier qui serait fait d’une œuvre constitue un usage loyal, les éléments à considérer comprendront : l’objectif et la nature de l’usage, notamment s’il est de nature commerciale ou éducative et sans but lucratif ; la nature de l’œuvre protégée ; la quantité et l’importance de la partie utilisée en rapport à l’ensemble de l’œuvre protégée ; les conséquences de cet usage sur le marché potentiel ou sur la valeur de l’œuvre protégée. Le fait qu’une œuvre ne soit pas publiée ne constitue pas en soi un obstacle à ce que son usage soit loyal s’il apparaît tel au vu de l’ensemble des critères précédents ». « L’originalité du fair use par rapport aux doctrines comparables est l’absence de limites précises aux droits ouverts : alors que les autres pays définissent assez précisément ce qui est autorisé, le droit des États-Unis donne seulement des critères (factors) que les tribunaux doivent apprécier et pondérer pour décider si un usage est effectivement loyal. Par conséquent, le fair use tend à couvrir plus d’usages que n’en autorisent les autres systèmes, mais au prix d’un plus grand risque juridique. »

De la propriété à l’accès ?

Lors des Rencontres de l’Orme 2008, Frédérique Muscinési, médiatrice culturelle, a risqué le débat : « Aujourd’hui, l’intermédiaire ne peut plus constituer l’agent de la culture établie, ni du discours officiel. Il doit réfléchir, à l’heure des nouvelles technologies et de la substitution progressive de la propriété par la notion d’accès, à son rôle dans le cadre d’une probable et enfin réalisable démocratisation de la culture, non de sa consommation que son propre rôle antérieur rendait impossible ou invalidait, mais de sa création. » Elle a rappelé que « l’imitation et la modification sont à la base de la création entendue comme mémoire et transmission, puisqu’elles sont le moteur de l’apprentissage, processus ou objet même de la création ».

En conséquence, la propriété intellectuelle appliquée aux objets ou aux expériences artistiques, a passé d’être un appui aux auteurs à celui des industries culturelles qui, restreignant l’accès à l’objet de création, restreignent par là même ses possibilités. Culture et éducation cheminent ensemble, c’est bien connu…

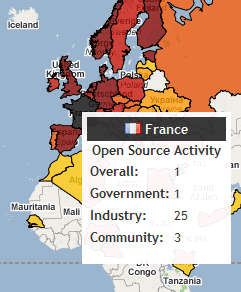

Les classements valent ce qu’ils valent mais, dans le climat de sinistrose ambiant, ne boudons pas notre plaisir de voir la France arriver tout simplement première sur la toute récente carte du monde de l’activité Open Source que nous propose Red Hat, les USA, par exemple, n’arrivant qu’en neuvième position.

Les classements valent ce qu’ils valent mais, dans le climat de sinistrose ambiant, ne boudons pas notre plaisir de voir la France arriver tout simplement première sur la toute récente carte du monde de l’activité Open Source que nous propose Red Hat, les USA, par exemple, n’arrivant qu’en neuvième position. Framasoft en général et le Framablog en particulier vous ont souvent raconté des histoires de

Framasoft en général et le Framablog en particulier vous ont souvent raconté des histoires de  Ceux qui ont eu, comme moi, la curiosité de goûter du bout des lèvres au navigateur

Ceux qui ont eu, comme moi, la curiosité de goûter du bout des lèvres au navigateur  Vu le developpement croissant du

Vu le developpement croissant du  Pour ceux qui arrivent encore à résister aux

Pour ceux qui arrivent encore à résister aux  Comme vous le savez, la loi

Comme vous le savez, la loi Nous sommes en mars 2009. Vous êtes un organisme public souhaitant offrir à son personnel une formation bureautique à distance. Comment vous y prendriez-vous ?

Nous sommes en mars 2009. Vous êtes un organisme public souhaitant offrir à son personnel une formation bureautique à distance. Comment vous y prendriez-vous ? On attendait la dépêche AFP sur THE manifestation du moment, à savoir

On attendait la dépêche AFP sur THE manifestation du moment, à savoir