Il était une fois un livre sur et avec Richard Stallman

Le livre Richard Stallman et la révolution du logiciel libre – Une biographie autorisée, qui est sorti le 21 janvier aux éditions Eyrolles, possède trois auteurs.

Le livre Richard Stallman et la révolution du logiciel libre – Une biographie autorisée, qui est sorti le 21 janvier aux éditions Eyrolles, possède trois auteurs.

Il y a bien entendu Sam Williams, auteur de la version d’origine en anglais. Mais si nous n’étions qu’en face de sa simple traduction, il demeurerait alors le seul auteur de l’ouvrage. Or deux autres noms apparaissent : Richard Stallman lui-même et Christophe Masutti de Framasoft.

Pourquoi cette originalité et pourquoi méritent-ils tous deux de venir s’associer à Sam Williams ? Vous le saurez en parcourant l’histoire peu commune de ce livre, telle qu’elle a été vécue par Christophe.

Il nous propose une très jolie formule pour expliquer les intentions et les apports de Stallman :

il a souhaité « hacker » le livre.

Avec le même état d’esprit, ou plutôt la même éthique, que lorsqu’il se trouvait, plusieurs dizaines d’années auparavant, jeune programmeur parmi les siens au département de recherche en intelligence artificielle du MIT.

Il était une fois un livre sur et avec Richard Stallman

Christophe Masutti – janvier 2010 – GNU Free Documentation License

Tout a commencé en mars 2007, lorsque Alexis Kauffmann a posté un message sur le forum du réseau Framasoft, invitant les volontaires à participer à la traduction du livre de Sam Williams, Free as in Freedom: Richard Stallman’s Crusade for Free Software, publié en 2002 chez O’Reilly sous la licence libre GNU Free Documentation License.

Tout a commencé en mars 2007, lorsque Alexis Kauffmann a posté un message sur le forum du réseau Framasoft, invitant les volontaires à participer à la traduction du livre de Sam Williams, Free as in Freedom: Richard Stallman’s Crusade for Free Software, publié en 2002 chez O’Reilly sous la licence libre GNU Free Documentation License.

Framasoft a une certaine habitude des traductions et s’est même constitué avec le temps une équipe entièrement dédiée à cela, le groupe Framalang. Il se trouve qu’à cette époque Framalang ne chômait pas et nous ne souhaitions pas leur rajouter une charge de travail supplémentaire avec un livre de quelque 300 pages !

Nous avons donc fait le choix de proposer directement le projet dans un wiki public, et pas n’importe lequel d’entre eux : Wikisource, la bibliothèque libre du réseau Wikimedia. Lors d’une conférence tenue aux Rencontres mondiales du logiciel libre 2009 de Nantes, Alexis donne plus de détails sur le mode opératoire : quelqu’un avait déjà traduit la préface et le premier chapitre du livre sur un site personnel, ce qui nous a servi de base pour créer la structure de l’ensemble du projet sur Wikisource. L’objectif était bien entendu d’arriver à nos fins mais il s’agissait également d’une expérience, celle d’une ambitieuse traduction collaborative et spontanée ouverte à tous, exactement comme on crée, modifie et améliore les articles de Wikipédia.

Un an plus tard, le bilan était contrasté. Nous avions bénéficié de l’exposition de Wikisource et de nombreuses personnes étaient venues participer. Mais quantitativement il restait encore beaucoup à faire et qualitativement ce qui avait été fait manquait singulièrement de cohérence et d’harmonie (ne serait-ce que pour se mettre d’accord sur la traduction de tel ou tel terme important et récurrent). Et puis nous butions sur des questions aussi élémentaires que la décision de « clore » un chapitre traduit, ce qui sur un wiki aussi fréquenté ne va pas de soi.

Ne nous en déplaise, il fallait mettre un peu de « cathédrale dans le bazar », c’est-à-dire un peu de verticalité dans l’horizontalité du projet. Alexis a alors pris la décision de relancer le projet sur le blog de Framasoft, en invitant les bonnes volontés à se regrouper sur une liste de discussion dédiée et créée pour l’occasion. Pour ma part, je pris l’initiative d’animer cette liste qui compta rapidement une bonne dizaine d’inscrits (dans le livre vous trouverez en préambule les remerciements à cette liste nominative de participants).

Notre première décision consista à créer ailleurs un deuxième wiki, mais cette fois-ci loin des regards du réseau Wikimedia. Il ne s’agissait pas de jouer les cachottiers, mais nous en étions arrivés à la conclusion qu’il n’était plus possible de continuer à travailler sur Wikisource, dans la mesure où à tout moment une personne externe à la liste pouvait s’en venir tout « bouleverser » (c’est, j’en conviens fort bien, ce qui fait tout le charme de Wikipédia, mais à cette période d’un projet si spécifique nous souhaitions avant toute chose être efficaces et coordonnés dans notre travail).

Nous nous trouvions cependant face à un dilemme : d’un côté la traduction d’origine sur Wikisource restait bien entendu ouverte et continuait sa vie de texte wiki (bien que fort peu active, puisque la liste avait capté une bonne part de l’énergie disponible) et de l’autre côté, le travail sur notre nouveau wiki prenait forme et la traduction avançait plutôt bien. Une fois terminée, notre intention était de reverser la traduction de Free as in Freedom dans Wikisource, quitte à « écraser » les contributions effectuées dans l’intervalle (ces contributions peuvent néanmoins être réhabilitées grâce à l’historique des modifications). Aujourd’hui, on peut donc trouver sur Wikisource cette traduction française de Free as in Freedom publiée par Sam Williams en 2002. Modulo le fait que quelqu’un est peut-être venu en déplacer un mot il y a une heure 😉

Notre traduction avançait donc plutôt bien jusqu’à obtenir une forme convenable à la relecture en novembre 2008, avec en prime la décision définitive d’en faire un volume de plus de la collection de livres libres Framabook.

Une petite parenthèse est ici nécessaire. En effet, nous travaillions depuis peu en étroite collaboration avec l’équipe de La Poule ou l’Oeuf, qui est une chaîne éditoriale en ligne pour la production de livres, pensés comme unités d’une collection, permettant un rendu final de type TeX, PDF, ePub ou HTML. Ce livre était aussi pour nous l’occasion d’implémenter dans le système non seulement l’ouvrage mais aussi la maquette générale de notre collection Framabook. Nous sommes très heureux du résultat car non seulement la Poule ou l’Oeuf a servi pour la mise en page du livre publié chez Eyrolles, mais ce sont désormais tous les framabooks qui vont bénéficier de la puissance de cet outil et des compétences de l’équipe de la Poule ou l’Oeuf.

Parenthèse fermée. Un mois plus tard, en décembre 2008, j’écrivis à Sam Williams pour lui demander une préface. Il accepta, tout en me précisant qu’il aurait bien aimé que Richard Stallman eût participé aux éventuelles modifications de l’ouvrage en anglais mais que finalement cela ne s’était pas produit. À ce moment-là, je ne compris guère l’allusion qui trouva son explication quelques jours plus tard.

Nous réfléchissions également aux illustrations possibles de l’ouvrage. Il y avait une belle photo de Richard Stallman dans le livre d’origine chez O’Reilly, tirée du site web personnel de Richard. Je contacte donc ce dernier, non seulement pour lui demander l’autorisation d’utiliser sa photo, mais aussi pour l’informer que nous comptions publier la traduction en français (une traduction en italien avait été publiée en 2003).

C’est là que tout a basculé (positivement).

Il faut savoir que le livre Free as in Freedom n’a jamais obtenu l’appui formel de Richard Stallman. Pire : Richard aurait déjà affirmé qu’il était hors de question de venir lui demander un autographe sur le livre. On peut légitimement se demander pourquoi… Certes le travail de Sam Williams est d’abord un travail de journaliste, et il dresse un portrait sans concession de la personnalité de Richard Stallman : introverti, controversé, irascible et intransigeant. Tous ceux qui se sont rendus au moins une fois à l’une de ses conférences et qui sont au courant de ses activités, ont une bonne idée de ce que je veux dire.

Mais ce n’est pas sur ce point que Richard Stallman était en désaccord avec l’ouvrage : il y avait des erreurs manifestes voire des interprétations faussées dans les faits concrets relatés dans l’ouvrage. En somme, un travail mené un peu trop vite et sans assez de recul. Par ailleurs, un programmeur de l’envergure de Richard Stallman met un point d’honneur à vouloir reformuler avec exactitude les approximations, même lorsqu’elles ont été commises volontairement dans le but de rendre l’ouvrage plus accessible. Il n’en demeure pas moins que sous le prétexte de l’accessibilité, certaines approximations transformaient carrément le propos ou les évènements. La manière dont Richard a agit sur le texte est relatée dans sa préface et lorsque le propos relève notamment de l’interprétation personnelle de Sam Williams, les ajouts de Richard sont clairement identifiés dans le livre par des encarts et des notes de bas de page. Les lecteurs pourront donc se faire une bonne idée des transformations ainsi opérées, quitte à aller voir et comparer avec l’original de Sam Williams.

Je prends un exemple : lorsque Sam Williams relate la tension entre Eric S. Raymond et Richard Stallman, on comprend que Raymond accuse Richard d’être la principale cause du manque de réactivité du projet Hurd (le projet de noyau du système GNU), et que cette accusation est fondée (on se doute néanmoins que Raymond n’a pas bien digéré la fin de non recevoir pour les modifications de l’éditeur Emacs qu’il voulait imposer). Pour Williams, et aussi pour Raymond, c’est le « micro-management » à la Stallman, c’est à dire sans concession, qui a freiné Hurd, avec pour conséquence la popularisation du noyau Linux, qui obéit, lui, à un schéma de développement beaucoup plus ouvert. Il serait pourtant simpliste de se contenter de cette interprétation. Richard l’explique autrement, tant en montrant que Hurd n’est pas une mince affaire qu’en montrant aussi que le noyau Linux n’est pas la panacée du point de vue technique comme du point de vue éthique (le plus important à ses yeux).

Bref, suite à mon courriel, Richard me répondit qu’il désirait apporter quelques précisions sur l’épisode LMI et Symbolics, deux entreprises qui débauchèrent le gros de l’équipe de hackers du MIT au début des années 1980. Cet épisode était très important, mais il ne touchait en gros qu’une dizaine de paragraphes dans l’ouvrage. Lorsque j’en fis référence à l’équipe de notre liste de discussion, tout le monde approuva l’idée.

Pourtant, au fil des échanges, Richard me confia qu’il n’avait jamais lu le livre de Sam Williams, et qu’en lisant les chapitres en anglais que je lui envoyais (repris depuis le site personnel de Sam Williams), il ressentait fortement le besoin de le réécrire.

Et tout l’art du hacker se révéla.

Alors que je lui suggérais d’écrire lui-même son autobiographie (d’un certain côté, j’anticipais sur mes craintes : la retraduction de l’ensemble à partir de toutes ces nouvelles modifications !), il se contenta de me renvoyer des chapitres réécris, sur lesquels je faisais un « diff » (une commande Unix permettant d’afficher les différences entre deux fichiers) pour pouvoir implémenter ces modifications dans la traduction française.

Après tout, qu’est-ce qu’un hacker ? Le lecteur en trouvera une bonne définition historique en annexe de l’ouvrage. L’essentiel est de comprendre que « hacker » signifie surtout améliorer, et qu’un bon hacker qui se respecte ne supporte pas l’imperfection. En toute logique, Richard ressentait tout simplement l’envie irrésistible de « hacker » le livre de Sam Williams. Qui d’autre sinon lui ?

J’énonce tout ceci avec le recul que me permet la parution de l’ouvrage. Dans les faits, je recevais plusieurs courriels par semaine contenant les modifications de Richard. Je les implémentais après les avoir lues, demandé des précisions, et argumenté lorsqu’elles étaient discutables. Bref, un travail soutenu qui nous amena Richard et moi jusqu’au début de l’été 2009.

Un mois auparavant, Alexis avait rencontré Muriel Shan Sei Fan, directrice de la collection Accès Libre aux éditions Eyrolles. Et entre la poire et le fromage, il évoqua « l’aventure » de cette traduction qu’il continuait à suivre attentivement. Muriel trouva le projet tant est si bien intéressant qu’elle nous proposa de le publier chez eux.

Nous acceptâmes, mais ce serait vous mentir que d’affirmer que ce fut une décision facile et unanime dans l’équipe. En effet, nous avons, et nous avons encore, nos habitudes chez InLibroVeritas, l’éditeur si particulier et attachant de tous les autres framabooks, avec qui nous travaillons main dans la main depuis des années pour défendre et faire la promotion du logiciel libre et sa culture.

Plusieurs arguments ont cependant pesé dans la balance. Tout d’abord nous n’avions plus affaire cette fois à un livre sur un logiciel libre particulier (Thunderbird, OpenOffice.org, LaTeX, Ubuntu…). Nous étions face à un livre mutant, une traduction devenue « biographie autorisée » car modifiée et enrichie pour l’occasion par son sujet même. Et pas n’importe quel sujet : la plus illustre des personnalités de la jeune histoire du logiciel libre. Cela méritait assurément de rechercher la plus grande exposition possible. Outre sa capacité de diffusion et distribution, Eyrolles nous offrait aussi son expertise et expérience. Le livre avait été traduit et une première fois relu, mais nous étions néanmoins conscients de sa perfectibilité de par les conditions mêmes de sa réalisation mentionnées plus haut (sachant de plus qu’à ce moment précis de l’histoire Richard n’en avait toujours pas fini avec ses propres modifications). Eyrolles a ainsi retravaillé le texte et mis à disposition du projet plusieurs personnes non seulement pour effectuer de nouvelles relectures mais parfois même pour retraduire certains passages. J’ajoute que nous appréciions la collection pionnière Accès Libre qui abrite en son sein de nombreux ouvrages de qualité sur le logiciel libre. Et enfin dernier argument et non des moindres : sous notre impulsion, Eyrolles allait pour la première fois publier d’emblée un livre sous licence libre, avec tous les avantages et inconvénients que cela suppose.

Nous nous rencontrâmes in the real life, Muriel, Richard, Alexis et moi, au cours d’un déjeuner en marge des Rencontres mondiales du logiciel libre de Nantes en juillet 2009. Nous discutâmes des modalités de publication et surtout, justement, de la question de la licence. L’ouvrage d’origine étant sous licence GNU Free Documentation License (à cause d’un Stallman insistant, Sam Williams s’en explique à la fin de son livre), sa traduction ne pouvait que l’être également. Or publier sous licence libre n’était pas dans les habitudes d’Eyrolles et cela ne rentrait pas forcement dans les « cases » de ses contrats types (rien que le fait d’interdire la classique interdiction de photocopier était une nouveauté). De plus nous connaissons les positions sans concession de Stallman dès que l’on touche à ces questions de licence. Mais nous avons néanmoins réussi sans trop de mal à nous mettre d’accord, et il faut rendre ici hommage aux éditions Eyrolles d’avoir su s’adapter et innover.

La dernière ligne droite fut en tout cas aussi passionnante que stressante, avec ses nombreux va-et-vient entre Richard (apportant ses dernières modifications), Eyrolles (éditant à la volée l’ensemble de l’ouvrage), La Poule (obligée à mettre en forme un texte sans cesse en mouvement) et moi (dispersé un peu partout). Toujours est-il que vers la fin décembre 2009, ouf, nous étions prêts et le projet bouclé. Nous méritions tous ce beau cadeau de Noël que nous nous offrions là 😉

De leur côté, Richard Stallman et John Sullivan vont très prochainement publier en anglais le livre dans sa nouvelle version, aux éditions internes à la Free Software Foundation, ajoutant ainsi une dimension supplémentaire au projet. Non seulement nous touchons les lecteurs francophones, mais le monde anglophone pourra aussi se délecter de ce « hack biographique ». Grâce à la licence libre (et aux efforts de quelques uns), le livre, parti des États-Unis, revient à la maison après un détour par la France qui l’aura transformé !

Pour moi, ce livre n’est pas seulement une biographie, même s’il en a l’apparence et la saveur. Il s’agit d’une histoire, celle du mouvement pour le logiciel libre, qui a influencé profondément l’histoire générale de l’informatique depuis la fin des années 1960. On considère généralement cette histoire à travers celle de l’industrie logicielle ou des composants d’ordinateurs. Mais il manque souvent une approche en termes de pratiques d’ingénierie et de circulation de l’information. Le logiciel libre constitue en cela une belle illustration de l’ingénierie logicielle, qui avance non seulement par projet, mais aussi parce qu’elle est fondamentalement un débat permanent sur la disponibilité et le partage de l’information. Lorsque le partage d’idées est impossible (notamment à cause des brevets) et lorsque les développeurs et les utilisateurs sont restreints dans leurs libertés, alors c’est la société toute entière qui pâti de la pénurie de code et de libertés.

Tous les métiers ont leur déontologie. Les informaticiens ont une éthique et ceux qui la distillent sont les hackers. Par delà ses actes et ses programmes, l’un des principaux mérites de Richard Stallman est d’avoir réussi à concentrer et matérialiser cette éthique dans une simple licence (la fameuse GNU General Public License), qui va non seulement fonder, défendre et diffuser le logiciel libre mais qui constitue aujourd’hui une référence et une source d’inspiration pour d’autres mouvements émancipateurs. En fait, les programmes ont toujours été libres, et c’est un non-sens éthique qui les a rendu privateurs à un moment donné. L’histoire de l’informatique est heureusement loin d’être terminée.

Celle de ce livre touche par contre à sa fin, puisqu’il sera officiellement publié le 21 janvier prochain sous le titre Richard Stallman et la révolution du logiciel libre – Une biographie autorisée. Je remercie chaleureusement tous ceux que cette aventure a mis sur notre chemin. Toutes ces rencontres qui font aussi le sel d’un tel projet. À Framasoft, nous sommes fiers d’avoir pu le mener à son terme. Et malgré le labeur qui n’a pas manqué, ce fut un réel plaisir. Plaisir que nous espérons désormais partager avec le lecteur…

Cette histoire touche donc à sa fin, disais-je, mais, licence libre oblige, rien ne dit qu’il ne subisse pas à l’avenir d’autres métamorphoses. Ne serait-ce que parce que Richard est heureusement toujours parmi nous et qu’il lui reste encore certainement de belles pages à écrire dans le livre de sa vie.

Le saviez-vous ? Grâce à la caution de partenaires associatifs et institutionnels a priori au dessus de tout soupçon, Microsoft entre comme dans du beurre (ou presque) à l’Éducation nationale, en déployant tranquillement son vaste et ambitieux programme globalisé « Innovative Schools ».

Le saviez-vous ? Grâce à la caution de partenaires associatifs et institutionnels a priori au dessus de tout soupçon, Microsoft entre comme dans du beurre (ou presque) à l’Éducation nationale, en déployant tranquillement son vaste et ambitieux programme globalisé « Innovative Schools ». Je me souviens d’un temps que les moins de vingt ans ne peuvent pas connaître. C’était avant Internet. La presse avait un surnom :

Je me souviens d’un temps que les moins de vingt ans ne peuvent pas connaître. C’était avant Internet. La presse avait un surnom :  Écrivain, informaticien et cofondateur du registrar français Gandi,

Écrivain, informaticien et cofondateur du registrar français Gandi,

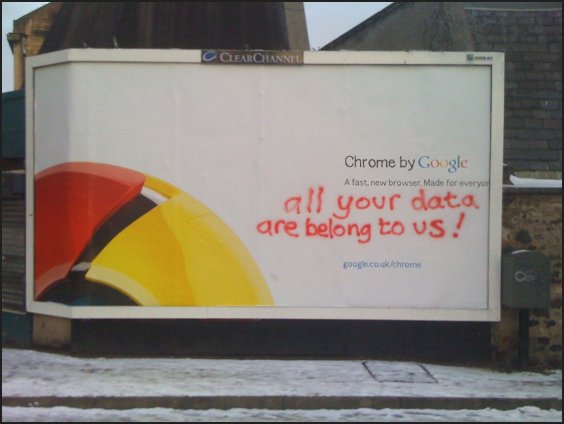

Ah qu’il était doux et rassurant le temps de l’informatique à grand-papa où nous avions nos ordinateurs fixes qui se connectaient de temps en temps et où nous luttions avec confiance et enthousiasme contre le grand-méchant

Ah qu’il était doux et rassurant le temps de l’informatique à grand-papa où nous avions nos ordinateurs fixes qui se connectaient de temps en temps et où nous luttions avec confiance et enthousiasme contre le grand-méchant