Alliance du Bâtiment : un format de fichier ouvert pour la construction

L’interopérabilité logicielle, c’est à dire la capacité de deux logiciels à parler « la même langue », a souvent été évoquée dans le Framablog.

La plupart du temps, il s’agissait pour nous de traiter de bureautique (« Pourquoi mon fichier LibreOffice est-il mal ouvert par cette saleté de Word ?! ») ou de web (« Pourquoi ce site est-il moins bien affiché avec Firefox qu’avec Chrome ? »).

Comme la langue française a besoin de règles de grammaire et d’orthographe, de dictionnaires, etc, les formats de fichiers ont besoin de spécifications, de normes, et d’être correctement implémentés.

Or, quand un format n’a pas de spécification publique et librement implémentable, cela nous rend dépendant⋅e de l’éditeur du logiciel. Un peu comme si un petit groupe de personnes pouvait décréter que vous ne pouviez pas utiliser le mot « capitalisme » parce que ça ne l’arrangeait pas, ou imposait l’interdiction du mot « autrice » (parce que « auteure » n’aurait été acceptée qu’après 2006). Ce serait assez fou, non ? Oh, wait…

Et bien certains formats de fichiers sont clairement verrouillés. Par exemple les fichiers .DWG du logiciel de dessin Autocad sont dans un format fermé. Alors évidemment, d’autres éditeurs ont essayé de « deviner » comment fonctionnait le format .DWG afin de pouvoir ouvrir et enregistrer des fichiers compatibles AutoCAD avec leur logiciel. C’est ce qu’on appelle de la rétro-ingénierie, mais c’est souvent du bricolage, et l’éditeur original peut régulièrement changer la spécification de son fichier pour embêter ses concurrents, voir aller jusqu’à leur intenter des procès.

Or, s’il existe un domaine où les formats de fichiers devraient bien être ouverts, c’est celui de la construction. Nous interagissons toutes et tous avec des bâtiments au quotidien. Qu’il s’agisse de notre logement, de notre lieu de travail, d’un bâtiment public, etc, nous passons d’un bâtiment à l’autre en permanence.

Or, aussi étonnant que cela puisse paraître, il n’existe pas de format de fichiers de description des données utiles à la construction qui soit à la fois public ET largement utilisé. Le logiciel AutoCAD (et son format .DWG) et le logiciel REVIT (pour le processus BIM et ses formats .rfa, .rvt) de la société Autodesk, dominent largement le marché. Et les conséquences sont loin d’être négligeables. Cela « force la main » des différents corps de métiers (architectes, ingénieurs, constructeurs, artisans, etc) à utiliser ces logiciels et entretient le quasi-monopole d’Autodesk sur le marché. Utiliser d’autres logiciels reste possible, mais imaginez les conséquences si ce logiciel fait une « erreur » en ouvrant le fichier « immeuble-de-12-étages.dwg » à cause d’une erreur dans l’interprétation de la spécification….

Par ailleurs, en dehors des descriptions des murs, des calculs de poids de structures, il faut aussi intégrer des éléments comme les chauffages, les canalisations, les circuits électriques, les fenêtres, etc. Les données générées par un bâtiment (ou autre bâti, tel un pont ou une route) sont donc extrêmement nombreuses. La page wikipédia « Liste des logiciels CAO pour l’architecture, l’ingénierie et la construction » est d’ailleurs plus que conséquente, et sa section logiciels libres est plutôt réduite…

Il existe bien des formats standardisés pour gérer la modélisation du bâti immobilier, appelée « BIM ». Ainsi, l’IFC est un format de fichier standardisé (norme ISO 16739) orienté objet utilisé par l’industrie du bâtiment pour échanger et partager des informations entre logiciels. Mais il est assez peu utilisé et souvent décrit en format natif, ce qui rend l’interopérabilité entre logiciels complexe à réaliser malgré l’existence de l’IFC.

Il apparaît donc essentiel de disposer de formats qui soient ouverts (pour permettre l’interopérabilité), et normalisés (validés et éprouvés par les professionnels du métier) pour nos constructions.

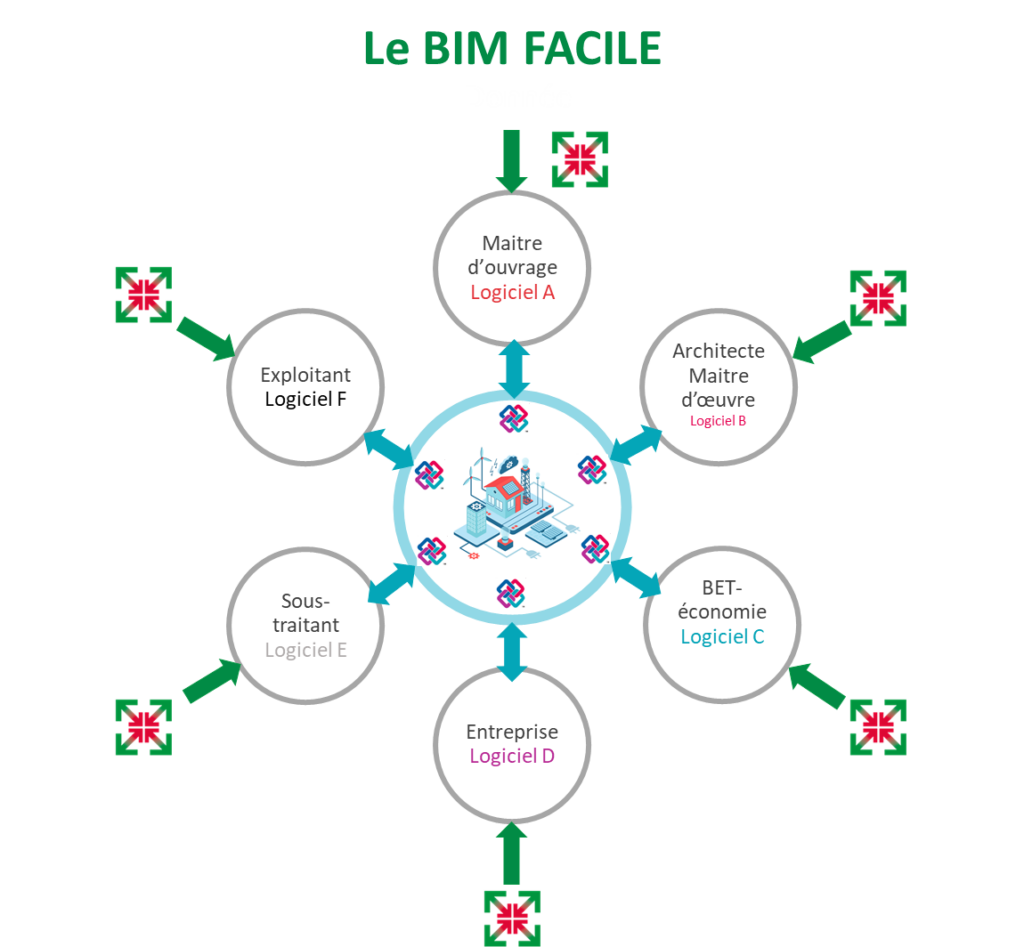

Nous avons rencontré les membres de l’association Alliance Bâtiment qui met à la disposition des maîtres d’ouvrage, maîtres d’œuvre, entreprises, artisans et fabricants PME, TPE, un format ouvert et partagé. Cela permet de normaliser la donnée d’entrée dans les logiciels métiers et rendre les maquettes IFC interopérables. L’accès au processus BIM et l’usage des logiciels BIM est ainsi fortement simplifié !

Bonjour ! Pouvez-vous vous présenter ?

Jean-Paul BRET, Président de l’association : Ma longue carrière professionnelle dans la promotion immobilière à l’OPAC 38, le plus gros bailleur social de l’Isère, et comme Président de la Communauté d’Agglomération du Pays Voironnais (38) durant 12 ans m’incite à penser que le secteur de la construction doit impérativement accélérer sa transition numérique.

J’ai pu constater en engageant de nombreuses opérations de construction que les nombreux acteurs autour d’un projet avaient souvent du mal à se coordonner voire se comprendre. C’est une banalité de parler de retard de travaux, de dépassements budgétaires, de malfaçons pouvant conduire à des conflits et de documents descriptifs des ouvrages difficilement exploitables pour la maintenance des ouvrages.

Thierry LEHNEBACH, Administrateur Délégué : Très tôt, j’ai été motivé par la protection de l’environnement, ce qui m’a conduit à m’engager pour l’écologie. Cela m’a amené à avoir un parcours d’élu, conseiller régional, puis maire et vice président de l’intercommunalité. Dans le même temps, mon activité professionnelle s’est organisée autour de la communication orientée vers le numérique et l’informatique en opensource, puis une dernière activité dans une entreprise artisanale.

Je mets en œuvre ces acquis au service de l’association en tant que cheville ouvrière : communication, animation, gestion.

La transformation numérique de la société ouvre de nouvelles frontières qui donne un avantage disproportionné aux plus puissants qui s’approprient le réel grâce au contrôle de la donnée. Le problème est que la culture de la donnée n’est pas encore développée et qu’il y a une grande naïveté chez tous les décideurs, utilisateurs et simples citoyens.

Didier BALAGUER : Après une première création d’entreprise d’ingénierie spécialisée en acoustique en 1994, j’ai créé datBIM, éditeur de solutions numériques collaboratives pour la construction, en 2000. J’ai identifié dès l’origine qu’une clé de la coopération est l’échange fluide et fiable de données entre les acteurs indépendamment des outils logiciels utilisés, ce qui a amené datBIM à créer le format opendthX.

Faire en sorte que tout type de données soit exploitable dans tout type d’applications à l’image du secteur des télécommunications où 2 correspondants peuvent communiquer indépendamment de la marque de leur téléphone ou des opérateurs de services auxquels ils souscrivent respectivement leur abonnement. La valeur induite par l’interopérabilité des données avec les applications à l’échelle d’un secteur tel la construction Française est estimée à plusieurs dizaines de milliards d’euros par an.

Qu’est-ce qui vous a incité à vous investir en tant que bénévoles dans cette nouvelle association ALLIANCE DU BATIMENT pour le BIM ?

Didier BALAGUER : Ouvrir le format était une évidence, le concéder à ALLIANCE DU BATIMENT, association loi 1901 gouvernée par les acteurs volontaires de la filière, un moyen d’apporter la confiance pour permettre aux acteurs de maîtriser leur devenir numérique pour répondre collectivement aux enjeux de notre société : transition écologique, liberté d’expression et d’entreprendre tout en renforçant la compétitivité de notre économie.

Jean- Paul BRET : Lorsque Didier BALAGUER m’a proposé de créer l’ALLIANCE DU BATIMENT pour le BIM, avec pour objectif de faciliter la transition numérique de la filière avec les outils mis à disposition en opensource, j’ai tout de suite accepté. Cela a conduit au transfert à l’association de la gestion et la gouvernance du format opendthX initialement développé par la société datBIM pour en faire un bien commun, libre d’usage.

L’absence de langage commun et d’interopérabilité entre les données et les outils pénalise souvent la qualité des projets et l’efficacité de toute la filière constructive. Le BIM qui est la numérisation du processus de construction peut améliorer cette situation. C’est un moyen de le faire depuis la phase de conception d’un projet jusqu’à celle de la déconstruction en passant par la construction et l’exploitation.

Mais il ne doit pas être réservé aux grands acteurs de la filière et conduire à une plateformatisation et une appropriation de la valeur par quelques acteurs dominants ou des plateformes de type GAFAM. Or c’est ce qu’il se passe avec les formats propriétaires des logiciels de CAO adaptés pour le BIM.

Il doit être facilement accessible aux PME, TPE et artisans qui représentent environ 95% des entreprises de la filière constructive.

Pour cela nous allons mettre à leur disposition de nouvelles solutions d’interopérabilité qui faciliteront leur manière d’accéder à la donnée sur les objets. Elles leur permettront de contribuer à la production de la maquette numérique. L’enjeu est important puisqu’en cas de succès l’ALLIANCE DU BATIMENT pourrait avoir valeur d’exemple. Cela pourrait à ce titre, être décliné bien au-delà nos frontières.

Nous sommes d’autant plus motivés que ce projet, qui vise à faciliter la coopération au sein de la filière BTP, est totalement en phase avec les objectifs du plan gouvernemental BIM 2022 qui reposent sur le principe directeur du BIM POUR TOUS. Enfin, pour moi le BIM n’est pas seulement une démarche qui permet d’optimiser l’échange d’information et la collaboration entre acteurs d’un projet constructif. C’est aussi un outil au service de la transition écologique puisqu’il permet une véritable traçabilité environnementale.

Dans les deux cas, les enjeux sont cruciaux tant sur le plan de la compétitivité économique que des aspects sociétaux.

Thierry LEHNEBACH : ALLIANCE DU BATIMENT ouvre un front dans le secteur de la construction qui concerne, en terme d’échange de données relatives à l’objet constructif, 25 % du PIB quand on prend en compte l’ensemble des acteurs (BTP, banques, assurances, etc..) en considérant que la donnée numérique doit être un commun dans cette filière.

Pouvez-vous nous expliquer un peu plus ce qu’est le BIM ?

Thierry LEHNEBACH : Le BIM ou Building Information Modeling est la modélisation des informations de la construction. C’est l’utilisation d’une représentation numérique partagée d’un actif bâti. Le BIM facilite les processus de conception, de construction et d’exploitation. Ces actifs bâtis sont des bâtiments, ponts, routes, tunnels, voies de chemin de fer, usines,…

Le processus produit un livrable numérique, le building information model, en français la maquette numérique. C’est le support et en même temps le document numérique du processus qui doit permettre à tous les acteurs de collaborer.

Pouvez-vous nous parler du projet de l’association ?

Thierry LEHNEBACH : ALLIANCE DU BATIMENT pour le BIM met à disposition librement le format opendthX dont elle a acquis les droits exclusifs d’exploitation. Ce format a été développé par la société datBIM pour structurer des bibliothèques d’objets pour le BIM et les diffuser en permettant l’interopérabilité entre tous les logiciels.

La maquette numérique englobe la géométrie de la construction, les relations spatiales, les informations géographiques. Elle englobe également les quantités, ainsi que les propriétés des éléments et sous-éléments de construction. Le format IFC (NF EN ISO 16739) permet de classer ces informations de manière logique selon une arborescence spatiale. Cette arborescence est définie par projet, site, bâtiment, étage, espace, composant.

La maquette numérique standardisée au format international IFC rassemble une bonne partie des informations. Elle rassemble les formes et matériaux, les calculs énergétiques pour le chauffage, la climatisation, la ventilation. Cela comprend également les données sur l’aéraulique, l’hydraulique, l’électricité, radio et télécommunications, levage, emplacement des équipements, alarmes et sécurité, maintenance, etc.

Mais le format IFC n’est pas suffisant pour permettre la réalisation d’un processus BIM abouti. Il y a deux problèmes majeurs :

- Le premier est que les objets au sein de la maquette IFC sont généralement structurés par des formats propriétaires et donc non interopérables. Les différents logiciels métiers utilisés sur un même projet utilisent des formats de données natifs. Ces formats concernent les objets avec des données décrites de différentes manières. L’écosystème BIM est un système multi-entrées dans lequel on introduit des données qui sont doublonnées et redondantes. Celles-ci constituent alors obligatoirement une donnée d’entrée de mauvaise qualité. Par conséquent elle amène à produire collectivement un résultat de piètre qualité. Ce phénomène pénalise des échanges fluides avec les logiciels des autres corps de métiers.

- Le second problème est que les formats propriétaires permettent aux acteurs les plus puissants de s’approprier le contrôle des données, ce qui créé des barrières et ouvre la voie à des situations de monopole de type GAFAM.

La mise en œuvre du BIM doit être simple pour un déploiement généralisé. L’association met à disposition des acteurs le format opendthX et participe aux développements d’outils pour permettre l’accès au BIM à tous les acteurs.

Comment fonctionnent ces outils ?

Didier Balaguer : Le processus collaboratif proposé par ALLIANCE DU BATIMENT s’appelle le BIM CIQO (Collaboration In – Quality Out). Il est basé sur la normalisation de la donnée d’entrée introduite dans les logiciels métiers de la construction et l’enrichissement des « objets » pour permettre la contribution de tous au processus BIM. C’est la raison d’être du format Open dthX.

Le processus CIQO, ou BIM universel, est le traitement du GIGO (Garbage In Garbage Out), caractéristique du BIM complexe multi-formats natifs.

On peut le mettre en œuvre avec eveBIM, logiciel de visualisation / enrichissement de maquettes IFC développé par le CSTB ou en mode saas en cours de développement (bim-universel.com) pour définir des objets BIM sur la base de modèles génériques de type POBIM (Propriétés des objets BIM ), qui est une bibliothèque de 300 modèles d’objets génériques à partir d’un dictionnaire de 3200 propriétés, définies selon la norme NF XP P 07150 devenue en 2020 NF EN ISO 23386.

Cette bibliothèque à été réalisée dans le cadre des travaux du plan de transition numérique du Bâtiment (PTNB) accessible depuis kroqi.MydatBIM.com, plateforme d’objets labellisée par l’AMI (appel à manifestation d’intérêt) kroqi, plateforme de gestion de projets BIM de référence du Plan gouvernemental BIM 2022. Il existe également d’autres bibliothèques :

- POBIM : DCE

- ATELIER BIM VIRTUEL : APS-APD-PRO-DOE Logement collectif

- PCBIM : Autorisations d’urbanisme

- FEDENE : DOE tertiaire & industrie

Comment est organisée votre association ?

Jean-Paul BRET : L’association est structurée par 6 collèges, dont les deux principaux piliers sont les organisations professionnelles telles que des CAPEB et des syndicats qui représentent des acteurs petits et moyens de la filière, et de maîtres d’ouvrage publics et privés. Il y a également des collèges association, organismes de formation, entreprises et citoyens.

Le modèle économique repose sur des adhésions, des financements sur projets et sur le produit de la formation par le biais de modules destinés à être mis en œuvre par des organismes de formation que l’association labellise.

C’est une structure légère qui a vocation à le rester tout en se professionnalisant pour s’inscrire dans la durée.

Selon vous, quels sont les enjeux d’un « BIM libre » ?

Le BIM libre permet à tous les acteurs de la filière des garder leur autonomie sans être rendus dépendants par des outils qu’ils ont eux même développés avec leur compétence mais dans un format qu’ils ne maîtrisent pas. L’interopérabilité complète permet aussi d’envisager le développement de savoir-faire partagés par l’ensemble de la filière pour faire monter celle-ci en efficacité. Il est possible par exemple d’imaginer de mettre en œuvre l’intelligence artificielle pour extraire de plusieurs projets des règles pour optimiser l’efficacité énergétique d’un type de construction.

L’accès à ce processus pour tous les acteurs est aussi un élément important pour les maîtres d’ouvrage qui veulent garder un écosystème d’entreprises de proximité. C’est une garantie pour la résilience des territoires et une sécurité contre la concentration qui conduit aux monopoles de fait.

Quelles sont les particularités de ce format Open dthx ?

Le format Open dthX a été développé par la société datBIM à partir de 2011 dans le cadre d’une collaboration avec l’école Centrale de Lyon et des experts en modélisation de la connaissance et ingénierie des systèmes. Les travaux ont bénéficié du soutien de la région Rhône-Alpes et l’Ademe (Innov’R) ainsi que de l’Europe (GreenConserve pour l’innovation de services à valeur ajoutée pour la construction durable et Eurostars).

L’enjeu de départ est de permettre aux acteurs du bâtiment (fournisseurs de matériaux, architectes, ingénieurs, …) de s’échanger – dès les premières phases du projet – les caractéristiques techniques des produits mis en œuvre dans la construction.

Un Dictionnaire Technique Harmonisé (DTH) a été mis en place à cette fin de nature dynamique afin que la sémantique puisse s’enrichir en fonction des besoins sans perturber les usages du format. Il maintient une liste de propriétés dans différents domaines (géométrique, acoustique, thermique, incendie, environnement, administratif…) en définissant pour chaque propriété un identifiant unique et une unité de mesure standard.

En 2015, la documentation du format est rendue publique, en faisant un format ouvert. Il est proposé à la normalisation entraînant la création d’un groupe d’experts sur les formats d’échange à la commission de normalisation, Afnor PPBIM. En 2019, il permet la distribution de la première bibliothèque d’objets génériques POBIM (propriétés des objets pour le BIM) décrit à partir d’un dictionnaire national de 3200 propriétés issues des travaux réalisés dans le cadre du plan gouvernemental de transition numérique du bâtiment (PTNB). En 2021, le plan gouvernemental BIM 2022 l’expérimente pour la réalisation d’un référentiel d’objets pour produire une maquette numérique contenant les informations nécessaires à l’instruction des autorisations d’urbanisme.

Normaliser la donnée d’entrée dans les logiciels métiers pour produire collectivement un livrable numérique de qualité (au sens interopérabilité du terme : exploiter le livrable qui est une base de données dans une application autre que celle qui l’a produite) et assurer l’enrichissement des objets à l’avancement du projet pour permettre la contribution de tous au processus BIM indépendamment des logiciels utilisés.

Quelle est la licence retenue pour la spécification de ce format ?

L’usage du format Open dthX est soumis à l’acceptation des termes de la licence « Creative Commons Attribution Pas de Modification 3.0 France ».

Sa principale valeur c’est justement qu’il soit unique afin d’assurer l’interopérabilité d’où le choix de ce type de licence. Des variantes porteraient préjudices à l’interopérabilité.

Qui utilise ce format de fichier Open dthx aujourd’hui ? Avec quels logiciels ?

Les utilisateurs du format Open dthX sont les acteurs de la construction : architectes, ingénieurs, entreprises, fabricants, maîtres d’ouvrage qui utilisent des logiciels de CAO tels Revit, ArchiCAD et de visualisation tels eveBIM, ciqo.eu…

De quoi avez-vous besoin aujourd’hui ? Et à plus long terme ?

Le premier enjeux est de faire connaître le projet de l’association. C’est assez difficile car la conscience de l’enjeu est très peu développé chez les décideurs et la communication des leaders du BIM qui vantent la puissance de leurs outils impose l’idée que leurs solutions sont le BIM alors que ces solutions n’en sont qu’une partie et que celle-ci est inadaptée à une approche data performante généralisable.

Nous cherchons aussi des partenaires qui mettent en œuvre ces outils. Nous sommes convaincus que les bénéfices de ces réalisations se diffuseront très rapidement auprès des décideurs vigilants sur les questions de maîtrise des données.

Enfin, nous voulons mettre en place un modèle qui nous permette de nouer des partenariats avec des développeurs qui peuvent proposer des développements qui utilisent le format pour des solutions correspondantes à des besoins métier liés à la construction.

Un mot ou une question à ajouter ?

Nous proposons à tous les décideurs en matière de construction de les accompagner pour mettre en œuvre le BIM universel de façon à avoir le plus grand nombre de références et de cas d’usage à diffuser pour propager la démarche.

Ressource à consulter :

- Site internet de Alliance du Bâtiment : alliance-batiment.org

- Article « C’est quoi, l’interopérabilité, et pourquoi est-ce beau et bien ? »