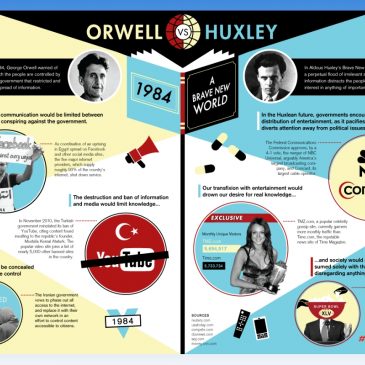

Bifurquer avant l’impact : l’impasse du capitalisme de surveillance

La chaleur de l’été ne nous fait pas oublier que nous traversons une crise dont les racines sont bien profondes. Pendant que nos forêts crament, que des oligarques jouent aux petits soldats à nos portes, et vu que je n’avais … Lire la suite