« Sir » Tim Berners-Lee, le père du Web, a livré ce week-end au magazine Scientific American, une analyse complète lucide et accessible des menaces qui pèsent aujourd’hui sur ce curieux phénomène qui depuis vingt ans a changé la face du monde : Internet.

« Sir » Tim Berners-Lee, le père du Web, a livré ce week-end au magazine Scientific American, une analyse complète lucide et accessible des menaces qui pèsent aujourd’hui sur ce curieux phénomène qui depuis vingt ans a changé la face du monde : Internet.

En termes simples, Berners-Lee revient sur l’universalité de ce réseau, qui n’a pu se développer que grâces à des conditions initiales propices :

- Une technique simple et libre, donc bidouillable par chacun dans son coin;

- Une conception décentralisée, permettant une croissance tous azimuts;

- Le principe de neutralité du réseau, qui permet à tous de proposer du contenu.

Or, force est de constater que ces conditions, qui ont démarqué ce que nous appelons aujourd’hui « Internet » des autres tentatives de mise en réseau à grande échelle d’ordinateurs de par le monde, sont attaquées et mises en péril par de grandes entreprises, et, presque comme une conséquence par de nombreux gouvernements. [1]

À la lecture de ce texte, on peut également se rendre compte que la France est malheureusement en bonne position parmi les gouvernements les plus hostiles au réseau, et que la HADOPI, comme un pavé jeté dans la mare, éclabousse effectivement de honte le pays des droits de l’Homme face à ses voisins. Contrastant par exemple clairement avec le droit au haut débit pour tous mis en place par la Finlande et lui aussi mentionné par Berners-Lee.

Toutefois, la principale qualité de cette riche synthèse est son ton résolument grand public, qui a mobilisé l’équipe Framalang tout un week-end pour venir à bout de la traduction des 6 pages de l’article original en moins de 48h.

Longue vie au Web ! Un appel pour le maintien des standards ouverts et de la neutralité

Long Live the Web, A Call for Continued Open Standards and Neutrality

Tim Berners-Lee – lundi 22 novembre – ScientificAmerican.com

Traduction Framalang : Goofy, Pablo, Seb seb, Misc, Siltaar

Le Web est un enjeu crucial non seulement pour la révolution numérique mais aussi pour notre prospérité — et même pour notre liberté. Comme la démocratie elle-même, il doit être défendu.

Le world wide web est venu au monde, concrètement, sur mon ordinateur de bureau à Genève en Suisse en décembre 1990. Il était composé d’un site Web et d’un navigateur, qui d’ailleurs se trouvaient sur la même machine. Ce dispositif très simple faisait la démonstration d’une idée fondamentale : n’importe qui pouvait partager des informations avec n’importe qui d’autre, n’importe où. Dans cet esprit, le Web s’est étendu rapidement à partir de ces fondations. Aujourd’hui, à son 20ème anniversaire, le Web est intimement mêlé à notre vie de tous les jours. Nous considérons qu’il va de soi, nous nous attendons à ce qu’il soit disponible à chaque instant, comme l’électricité.

Le Web est devenu un outil puissant et omniprésent parce qu’il a été conçu suivant des principes égalitaires et parce que des milliers d’individus, d’universités et d’entreprises ont travaillé, à la fois indépendamment et ensemble en tant que membres du World Wide Web Consortium, pour étendre ses possibilités en se fondant sur ces principes.

Le Web tel que nous le connaissons, cependant, est menacé de diverses façons. Certains de ses plus fameux locataires ont commencé à rogner sur ses principes. D’énormes sites de réseaux sociaux retiennent captives les informations postées par leurs utilisateurs, à l’écart du reste du Web. Les fournisseurs d’accés à Internet sans fil sont tentés de ralentir le trafic des sites avec lesquels ils n’ont pas d’accords commerciaux. Les gouvernements — qu’ils soient totalitaires ou démocratiques — surveillent les habitudes en ligne des citoyens, mettant en danger d’importants droits de l’Homme.

Si nous, les utilisateurs du Web, nous permettons à ces tendances et à d’autres encore de se développer sans les contrôler, le Web pourrait bien se retrouver fragmenté en archipel. Nous pourrions perdre la liberté de nous connecter aux sites Web de notre choix. Les effets néfastes pourraient s’étendre aux smartphones et aux tablettes, qui sont aussi des portails vers les nombreuses informations fournies par le Web.

Pourquoi est-ce votre affaire ? Parce que le Web est à vous. C’est une ressource publique dont vous, vos affaires, votre communauté et votre gouvernement dépendent. Le Web est également vital pour la démocratie, en tant que canal de communication qui rend possible une conversation globale permanente. Le Web est désormais plus crucial pour la liberté d’expression que tout autre média. Il transpose à l’âge numérique les principes établis dans la constitution des États-Unis, dans la Magna Carta britannique et d’autres textes fondateurs : la liberté de ne pas être surveillée, filtrée, censurée ni déconnectée.

Pourtant les gens semblent penser que le Web est en quelque sorte un élément naturel, et que s’il commence à dépérir, eh bien, c’est une de ces choses malheureuses contre lesquelles on ne peut rien faire. Or il n’en est rien. Nous créons le Web, en concevant les protocoles pour les ordinateurs et les logiciels. Ce processus est entièrement entre nos mains. C’est nous qui choisissons quelles caractéristiques nous voulons qu’il ait ou non. Il n’est absolument pas achevé (et certainement pas mort). Si nous voulons contrôler ce que fait le gouvernement, ce que font les entreprises, comprendre dans quel état exact se trouve la planète, trouver un traitement à la maladie d’Alzheimer, sans parler de partager nos photos avec nos amis, nous le public, la communauté scientifique et la presse, nous devons nous assurer que les principes du Web demeurent intacts — pas seulement pour préserver ce que nous avons acquis mais aussi pour tirer profit des grandes avancées qui sont encore à venir.

L’universalité est le principe fondateur

Il existe des principes-clés pour s’assurer que le Web devienne toujours plus précieux. Le premier principe de conception qui sous-tend l’utilité du Web et son développement, c’est l’universalité. Lorsque vous créez un lien, vous pouvez le diriger vers n’importe quoi. Cela signifie que chacun doit être capable de mettre tout ce qu’il veut sur le Web, quel que soit l’ordinateur, le logiciel utilisé ou la langue parlée, peu importe qu’on ait une connexion avec ou sans wifi. Le Web devrait être utilisable par des personnes handicapées. Il doit fonctionner avec n’importe quelle information, que ce soit un document ou un fragment de données, quelle que soit la qualité de l’information — du tweet crétin à la thèse universitaire. Et il devrait être accessible avec n’importe quel type de matériel connectable à Internet : ordinateur fixe ou appareil mobile, petit ou grand écran.

Ces caractéristiques peuvent paraître évidentes, allant de soi ou simplement sans importance, mais ce sont grâce à elles que vous pourrez voir apparaître sur le Web, sans aucune difficulté, le site du prochain film à succès ou la nouvelle page d’accueil de l’équipe locale de foot de votre gamin. L’universalité est une exigence gigantesque pour tout système.

La décentralisation est un autre principe important de conception. Vous n’avez nul besoin de l’approbation d’une quelconque autorité centrale pour ajouter une page ou faire un lien. Il vous suffit d’utiliser trois protocoles simples et standards : écrire une page en HTML (langage de balisage hypertextuel), de la nommer selon une norme d’URI (identifiant uniforme de ressource), et de la publier sur Internet en utilisant le protocole HTTP (protocole de transfert hypertexte). La décentralisation a rendu possible l’innovation à grande échelle et continuera de le faire à l’avenir.

L’URI est la clé de l’universalité (à l’origine j’ai appelé le procédé de nommage URI, Universal Resource Identifier – Identifiant Universel de Ressource ; par la suite il est devenu URL, Uniform Resource Locator – Localisateur Uniforme de Ressource). L’URI vous permet de suivre n’importe quel lien, indépendamment du contenu vers lequel il pointe ou de qui publie ce contenu. Les liens transforment le contenu du Web en quelque chose de plus grande valeur : un espace d’information inter-connecté.

Plusieurs menaces à l’encontre de l’universalité du Web sont apparues récemment. Les compagnies de télévision par câble qui vendent l’accès à Internet se demandent s’il faut pour leurs clients limiter le téléchargement à leurs seuls contenus de divertissement. Les sites de réseaux sociaux présentent un problème différent. Facebook, LinkedIn, Friendster et d’autres apportent essentiellement une valeur en s’emparant des informations quand vous les saisissez : votre date de naissance, votre adresse de courriel, vos centres d’intérêts, et les liens qui indiquent qui est ami avec qui et qui est sur quelle photo. Les sites rassemblent ces données éparses dans d’ingénieuses bases de données et réutilisent les informations pour fournir un service à valeur ajoutée — mais uniquement sur leurs sites. Une fois que vous avez saisi vos données sur un de ces services, vous ne pouvez pas facilement les utiliser sur un autre site. Chaque site est un silo, séparé des autres par une cloison hermétique. Oui, vos pages sur ces sites sont sur le Web, mais vos données n’y sont pas. Vous pouvez accéder à une page Web contenant une liste de gens que vous avez rassemblée au même endroit, mais vous ne pouvez pas envoyer tout ou partie de cette liste vers un autre site.

Cette compartimentation se produit parce que chaque élément d’information est dépourvu d’URI. L’interconnexion des données existe uniquement à l’intérieur d’un même site. Ce qui signifie que plus vous entrez de données, et plus vous vous enfermez dans une impasse. Votre site de réseau social devient une plateforme centrale — un silo de données fermé, qui ne vous donne pas le plein contrôle sur les informations qu’il contient. Plus ce genre d’architecture se répand, plus le Web se fragmente, et moins nous profitons d’un unique espace d’information universel.

Un effet pervers possible est qu’un site de réseau social — ou un moteur de recherche, ou un navigateur — prenne une telle ampleur qu’il devienne hégémonique, ce qui a tendance à limiter l’innovation. Comme cela s’est produit plusieurs fois depuis les débuts du Web, l’innovation permanente du plus grand nombre peut être la meilleure réponse pour contrer une entreprise ou un gouvernement quelconque qui voudrait saper le principe d’universalité. GnuSocial et Diaspora sont des projets sur le Web qui permettront à chacun de créer son propre réseau social sur son propre serveur, et de se connecter à d’autres sur leur site. Le projet Status.net, qui fait tourner des sites comme Identi.ca, vous permet de monter votre propre réseau de micro-blogage à la manière de Twitter mais sans la centralisation induite par Twitter.

Les standards ouverts sont le moteur de l’innovation

Permettre à chaque site d’être lié à n’importe quel autre est nécessaire mais pas suffisant pour que le Web ait une armature solide. Les technologies de base du Web, dont les particuliers et les entreprises ont besoin pour développer des services avancés, doivent être gratuites et sans redevance. Amazon.com, par exemple, est devenu une gigantesque librairie en ligne, puis un disquaire, puis un immense entrepôt de toutes sortes de produits, parce que l’entreprise avait un accès libre et gratuit aux standards techniques qui sous-tendent le Web. Amazon, comme tout usager du Web, a pu utiliser le HTML, l’URI et le HTTP sans avoir à en demander l’autorisation à quiconque et sans avoir à payer pour cela. La firme a pu également bénéficier des améliorations de ces standards développées par le World Wide Web Consortium, qui permettent aux clients de remplir un bon de commande virtuel, de payer en ligne, d’évaluer les marchandises achetées et ainsi de suite.

Par « standards ouverts » je veux dire des standards à l’élaboration desquels peuvent participer tous les spécialistes, pourvu que leur contribution soit largement reconnue et validée comme acceptable, qu’elle soit librement disponible sur le Web et qu’elle soit gratuite (sans droits à payer) pour les développeurs et les utilisateurs. Des standards ouverts, libres de droits et faciles à utiliser génèrent l’extraordinaire diversité des sites Web, depuis les grands noms tels qu’Amazon, Craigslist et Wikipédia jusqu’aux blogs obscurs maintenus par des passionnés, en passant par les vidéos bricolées à la maison et postées par des ados.

La transparence signifie aussi que vous pouvez créer votre site Web ou votre entreprise sans l’accord de qui que ce soit. Au début du Web, je ne devais pas demander de permission ni payer de droits d’auteur pour utiliser les standards ouverts propres à Internet, tels que le célèbre protocole de contrôle de transmission (TCP) et le protocole Internet (IP). De même, la politique de brevets libres de droits du W3C (World Wide Web Consortium) dit que les entreprises, les universités et les individus qui contribuent au développement d’un standard doivent convenir qu’ils ne feront pas payer de droits d’auteur aux personnes qui pourraient l’utiliser.

Les standards libres de droits et ouverts ne signifient pas qu’une entreprise ou un individu ne peut pas concevoir un blog ou un programme de partage de photos et vous faire payer son utilisation. Ils le peuvent. Et vous pourriez avoir envie de payer pour ça, si vous pensez que c’est « mieux » que le reste. L’important est que les standards ouverts permettent un grand nombre d’options, gratuites ou non.

En effet, de nombreuses entreprises dépensent de l’argent pour mettre au point des applications extraordinaires précisément parce qu’elles sont sûres que ces applications vont fonctionner pour tout le monde, sans considération pour le matériel, le système d’exploitation ou le fournisseur d’accés internet (FAI) que les gens utilisent — tout ceci est rendu possible par les standards ouverts du Web. La même confiance encourage les scientifiques à passer des centaines d’heures à créer des bases de données incroyables sur lesquelles ils pourront partager des informations sur, par exemple, des protéines en vue de mettre au point des remèdes contre certaines maladies. Cette confiance encourage les gouvernements des USA ou du Royaume-Uni à mettre de plus en plus de données sur le réseau pour que les citoyens puissent les inspecter, rendant le gouvernement de plus en plus transparent. Les standards ouverts favorisent les découvertes fortuites : quelqu’un peut les utiliser d’une façon que personne n’a imaginée avant. Nous le voyons tous les jours sur le Web.

Au contraire, ne pas utiliser les standards ouverts crée des univers fermés. Par exemple, le systéme iTunes d’Apple identifie les chansons et les vidéos par des URI que l’on ouvre. Mais au lieu d’« http: », les adresses commencent par « itunes: » qui est propriétaire. Vous ne pouvez accéder à un lien « itunes: » qu’en utilisant le logiciel propriétaire iTunes d’Apple. Vous ne pouvez pas faire un lien vers une information dans l’univers iTunes, comme une chanson ou une information sur un groupe. L’univers iTunes est centralisé et emmuré. Vous êtes piégés dans un seul magasin, au lieu d’être sur une place ouverte. Malgré toutes les fonctionnalités merveilleuses du magasin, leurs évolutions sont limitées par ce qu’une seule entreprise décide.

D’autres entreprises créent aussi des univers fermés. La tendance des magazines, par exemple, de produire des « applis » pour smartphone plutôt que des applications Web est inquiétante, parce que ce contenu ne fait pas partie du Web. Vous ne pouvez pas le mettre dans vos signets, ni envoyer par email un lien vers une page pointant dessus. Vous ne pouvez pas le « tweeter ». Il est préférable de créer une application Web qui fonctionnera aussi sur les navigateurs des smartphones et les techniques permettant de le faire s’améliorent en permanence.

Certaines personnes pourraient penser que les univers fermés ne sont pas un problème. Ces univers sont faciles à utiliser et peuvent donner l’impression de leur apporter tout ce dont elles ont besoin. Mais comme on l’a vu dans les années 1990 avec le système informatique bas débit d’AOL, qui vous donnait un accès restreint à un sous-ensemble du Web, ces « jardins emmurés », qu’importe qu’ils soient agréables, ne peuvent rivaliser en diversité, en profusion et en innovation avec l’agitation démente du Web à l’extérieur de leurs portes. Toutefois, si un « clôt » a une emprise trop importante sur un marché cela peut différer sa croissance extérieure.

Garder la séparation entre le Web et l’Internet

Conserver l’universalité du Web et garder ses standards ouverts aide tout le monde à inventer de nouveaux services. Mais un troisième principe — la séparation des couches — distingue la conception du Web de celle de l’Internet.

Cette séparation est fondamentale. Le Web est une application tournant sur Internet, qui n’est autre qu’un réseau électronique transmettant des paquets d’information entre des millions d’ordinateurs en suivant quelques protocoles ouverts. Pour faire une analogie, le Web est comme un appareil électroménager qui fonctionne grâce au réseau électrique. Un réfrigérateur ou une imprimante peut fonctionner tant qu’il utilise quelques protocoles standards — aux États-Unis, on fonctionne sur du 120 volts à 60 hertz. De la même façon, chaque application — parmi lesquelles le Web, les courriels ou la messagerie instantanée — peut fonctionner sur Internet tant qu’elle suit quelques protocoles standards d’Internet, tels que le TCP et l’IP.

Les fabricants peuvent améliorer les réfrigérateurs et les imprimantes sans transformer le fonctionnement de l’électricité, et les services publics peuvent améliorer le réseau électrique sans modifier le fonctionnement des appareils électriques. Les deux couches de technologie fonctionnent en même temps mais peuvent évoluer indépendamment. C’est aussi valable pour le Web et Internet. La séparation des couches est cruciale pour l’innovation. En 1990 le Web se déploie sur Internet sans le modifier, tout comme toutes les améliorations qui ont été faites depuis. À cette période, les connexions Internet se sont accélérées de 300 bits par seconde à 300 millions de bits par seconde (Mbps) sans qu’il ait été nécessaire de repenser la conception du Web pour tirer profit de ces améliorations.

Les droits de l’homme à l’âge électronique

Bien qu’Internet et les principes du Web soient distincts, un utilisateur du Web est aussi un utilisateur d’Internet et par conséquent il compte sur un réseau dépourvu d’interférences. Dans les temps héroïques du Web, il était techniquement trop difficile pour une entreprise ou un pays de manipuler le Web pour interférer avec un utilisateur individuel. La technologie nécessaire a fait des bonds énormes, depuis. En 2007, BitTorrent, une entreprise dont le protocole de réseau « peer to peer » permet de partager les musiques, les vidéos et d’autres fichiers directement sur Internet, a déposé une plainte auprès de la FCC (commission fédérale des communications) contre le géant des fournisseurs d’accès Comcast qui bloquait ou ralentissait le trafic de ceux qui utilisaient l’application BitTorrent. La FCC a demandé à Comcast de cesser ces pratiques, mais en avril 2010 la cour fédérale a décidé que la FCC n’avait pas le droit de contraindre Comcast. Un bon FAI (Fournisseur d’Accès Internet) qui manque de bande passante s’arrangera souvent pour délester son trafic de moindre importance de façon transparente, de sorte que les utilisateurs soient au courant. Il existe une différence importante entre cette disposition et l’usage du même moyen pour faire une discrimination.

Cette différence met en lumière le principe de la neutralité du réseau. La neutralité du réseau garantit que si j’ai payé pour une connexion d’une certaine qualité, mettons 300 Mbps, et que vous aussi vous avez payé autant, alors nos communications doivent s’établir à ce niveau de qualité. Défendre ce principe empêcherait un gros FAI de vous transmettre à 300 Mbps une vidéo venant d’une société de média qu’il posséderait, tandis qu’il ne vous enverrait la vidéo d’une société concurrente qu’à une vitesse réduite. Cela revient à pratiquer une discrimination commerciale. D’autres situations complexes peuvent survenir. Que se passe-t-il si votre FAI vous rend plus facile l’accès à une certaine boutique en ligne de chaussures et plus difficile l’accès à d’autres ? Ce serait un moyen de contrôle puissant. Et que se passerait-il si votre FAI vous rendait difficile l’accès à des sites Web de certains partis politiques, de groupes à caractère religieux, à des sites parlant de l’évolution ?

Hélas, en août Google et Verizon ont suggéré pour diverses raisons que la neutralité ne doit pas s’appliquer aux connexions des téléphones portables. De nombreuses personnes dans des zones rurales aussi bien dans l’Utah qu’en Ouganda n’ont accés à l’Internet que par leur téléphone mobile. Exclure les accès sans fil du principe de neutralité laisserait ces utilisateurs à la merci de discriminations de service. Il est également bizarre d’imaginer que mon droit fondamental d’accés à la source d’information de mon choix s’applique quand je suis sur mon ordinateur en WiFi à la maison, mais pas quand j’utilise mon téléphone mobile.

Un moyen de communication neutre est la base d’une économie de marché juste et compétitive, de la démocratie et de la science. La polémique est revenue à l’ordre du jour l’année dernière pour savoir s’il est nécessaire qu’une législation gouvernementale protège la neutralité du réseau. C’est bien le cas. Même si généralement Internet et le Web se développent grâce à une absence de régulation, quelques principes fondamentaux doivent être protégés légalement.

Halte à l’espionnage

D’autres menaces envers le web résultent d’indiscrétions touchant Internet, ce qui inclut l’espionnage. En 2008, une entreprise du nom de Phorm a mis au point un moyen pour un FAI de fouiner dans les paquets d’informations qu’il envoie. Le fournisseur peut alors déterminer chaque URI sur laquelle un de ses clients a surfé, et ensuite créer un profil des sites que l’utilisateur a visités afin de produire des publicités ciblées.

Accéder à l’information contenue dans un paquet Internet est équivalent à mettre un téléphone sur écoute ou ouvrir le courrier postal. Les URI que les gens utilisent révèlent beaucoup de choses sur eux. Une entreprise ayant acheté les profils URI de demandeurs d’emploi pourrait les utiliser pour faire de la discrimination à l’embauche sur les idées politiques des candidats par exemple. Les compagnies d’assurance-vie pourraient faire de la discrimination contre les personnes qui ont fait des recherches concernant des symptômes cardiaques sur le Web. Des personnes mal intentionnées pourraient utiliser les profils pour traquer des individus. Nous utiliserions tous le Web de façon très différente si nous savions que nos clics pouvaient être surveillés et les données ainsi obtenues partagées avec des tierces personnes.

La liberté d’expression devrait être elle aussi protégée. Le Web devrait être semblable à une feuille de papier blanche : disponible pour y écrire, sans qu’on puisse contrôler ce qui y est écrit. Au début de cette année Google a accusé le gouvernement chinois d’avoir piraté ses bases de données pour récupérer les courriels des dissidents. Ces intrusions supposées ont fait suite au refus de Google d’obéir aux exigences du gouvernement, qui demandait à l’entreprise de censurer certains documents sur son moteur de recherche en langue chinoise.

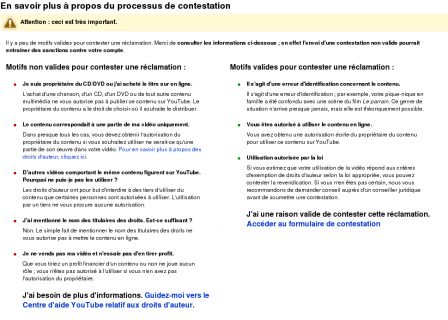

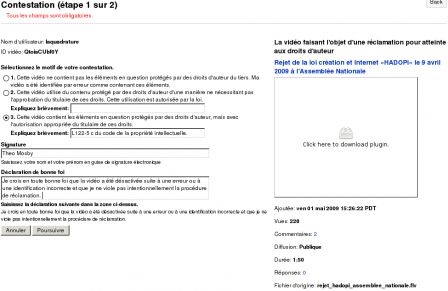

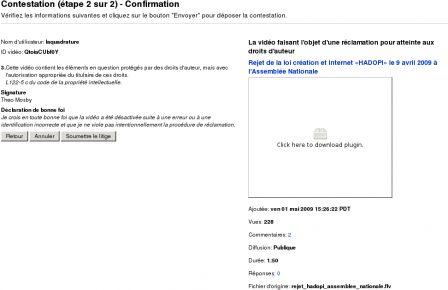

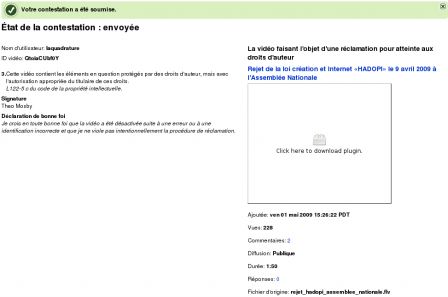

Les régimes totalitaires ne sont pas les seuls qui violent les droits du réseau de leurs citoyens. En France une loi créée en 2009, appelée HADOPI, autorise une administration du même nom à déconnecter un foyer pendant un an si quelqu’un dans la maison est accusé par une compagnie de distribution de médias d’avoir téléchargé de la musique ou des vidéos. Suite à une forte opposition, en octobre le Conseil constitutionnel français a demandé qu’un juge soit saisi du dossier avant que l’accès à Internet ne soit coupé, mais si le juge l’accepte, le foyer familial pourra être déconnecté sans procédure légale digne de ce nom. Au Royaume-Uni, le Digital Economy Act, hâtivement voté en avril, autorise le gouvernement à demander à un FAI (Fournisseur d’Accès Internet) d’interrompre la connexion de quiconque figure dans une liste d’individus soupçonnés de violation de copyright. En septembre, le Sénat des États-Unis a introduit le Combating Online Infringement and Counterfeits Act (loi pour lutter contre la délinquance en ligne et la contrefaçon), qui devrait permettre au gouvernement de créer une liste noire de sites Web — qu’ils soient ou non hébergés aux USA — accusés d’enfreindre la loi, et d’obliger tous les FAI à bloquer l’accès des-dits sites.

Dans de tels cas de figure, aucune procédure légale digne de ce nom ne protège les gens avant qu’ils ne soient déconnectés ou que leurs sites soient bloqués. Compte-tenu des multiples façons dont le Web s’avère essentiel pour notre vie privée et notre travail, la déconnexion est une forme de privation de notre liberté. En s’inspirant de la Magna Carta, nous pourrions maintenant proclamer :

« Aucun individu ni organisation ne pourra être privé de la possibilité de se connecter aux autres sans une procédure légale en bonne et due forme qui tienne compte de la présomption d’innocence. »

Lorsque nos droits d’accès au réseau sont violés, un tollé général est déterminant. Les citoyens du monde entier se sont opposés aux exigences de la Chine envers Google, à tel point que la Secrétaire d’état Hillary Clinton a déclaré que le gouvernement des États-Unis soutenait la résistance de Google et que la liberté de l’Internet — et avec elle celle du Web — allait devenir une pièce maîtresse de la politique étrangère américaine. En octobre, la Finlande a fait une loi qui donne le droit à chaque citoyen d’avoir une connexion à haut débit de 1 Mbps.

Connexion vers l’avenir

Tant que les principes fondamentaux du Web seront maintenus, son évolution ultérieure ne dépendra d’aucun individu ni d’aucune organisation particulière — ni de moi, ni de personne d’autre. Si nous pouvons en préserver les principes, le Web est promis à un avenir extraordinaire.

La dernière version du HTML par exemple, intitulée HTML5, n’est pas simplement un langage de balisage mais une plateforme de programmation qui va rendre les applications Web encore plus puissantes qu’elles ne le sont aujourd’hui. La prolifération des smartphones va mettre le Web encore plus au cœur de nos vies. L’accès sans fil donnera un avantage précieux aux pays en développement, où beaucoup de gens n’ont aucune connexion filaire ou par câble mais peuvent en avoir sans fil. Il reste encore beaucoup à faire, bien sûr, y compris en termes d’accessibilité pour les personnes handicapées, et pour concevoir des pages qui s’afficheront aussi bien sur tous les écrans, depuis le mur d’images géantes en 3D jusqu’à la taille d’un cadran de montre.

Un excellent exemple de futur prometteur, qui exploite la puissance conjuguée de tous ces principes, c’est l’interconnexion des données. Le Web d’aujourd’hui est relativement efficace pour aider les gens à publier et découvrir des documents, mais nos programmes informatiques ne savent pas lire ni manipuler les données elles-mêmes au sein de ces documents. Quand le problème sera résolu, le Web sera bien plus utile, parce que les données concernant presque chaque aspect de nos vies sont générées à une vitesse stupéfiante. Enfermées au sein de toutes ces données se trouvent les connaissances qui permettent de guérir des maladies, de développer les richesses d’un pays et de gouverner le monde de façon plus efficace.

Les scientifiques sont véritablement aux avants-postes et font des efforts considérables pour inter-connecter les données sur le Web. Les chercheurs, par exemple, ont pris conscience que dans de nombreux cas un unique laboratoire ou un seul dépôt de données en ligne s’avèrent insuffisants pour découvrir de nouveaux traitements. Les informations nécessaires pour comprendre les interactions complexes entre les pathologies, les processus biologiques à l’œuvre dans le corps humain, et la gamme étendue des agents chimiques sont dispersées dans le monde entier à travers une myriade de bases de données, de feuilles de calcul et autres documents.

Un expérience réussie est liée à la recherche d’un traitement contre la maladie d’Alzheimer. Un grand nombre de laboratoires privés ou d’état ont renoncé à leur habitude de garder secrètes leurs données et ont créé le projet Alzheimer’s Disease Neuroimaging. Ils ont mis en ligne une quantité phénoménale d’informations inter-connectées sur les patients, ainsi que des scanners cérébraux, une base dans laquelle ils ont puisé à maintes reprises pour faire progresser leurs recherches. Au cours d’une démonstration dont j’ai été témoin, un scientifique a demandé : « quelles protéines sont impliquées dans la transduction des signaux et sont liées aux neurones pyramidaux ? ». En posant la question avec Google, on obtenait 233 000 résultats — mais pas une seule réponse. En demandant aux bases de données inter-connectées du monde entier pourtant, on obtenait un petit nombre de protéines qui répondaient à ces critères.

Les secteurs de l’investissement et de la finance peuvent bénéficier eux aussi des données inter-connectées. Les profits sont générés, pour une grande part, par la découverte de modèles de recherche dans des sources d’informations incroyablement diversifiées. Les données sont également toutes liées à notre vie personnelle. Lorsque vous allez sur le site de votre réseau social et que vous indiquez qu’un nouveau venu est votre ami, vous établissez une relation. Et cette relation est une donnée.

Les données inter-connectées suscitent un certains nombre de difficultés que nous devrons affronter. Les nouvelles possibilités d’intégration des données, par exemple, pourraient poser des problèmes de respect de la vie privée qui ne sont pratiquement pas abordés par les lois existantes sur le sujet. Nous devrions examiner les possibilités légales, culturelles et techniques qui préserveront le mieux la vie privée sans nuire aux possibilités de bénéfices que procure le partage de données.

Nous sommes aujourd’hui dans une période enthousiasmante. Les développeurs Web, les entreprises, les gouvernements et les citoyens devraient travailler ensemble de façon collaborative et ouverte, comme nous l’avons fait jusqu’ici, pour préserver les principes fondamentaux du Web tout comme ceux de l’Internet, en nous assurant que les processus techniques et les conventions sociales que nous avons élaborés respectent les valeurs humaines fondamentales. Le but du Web est de servir l’humanité. Nous le bâtissons aujourd’hui pour que ceux qui le découvriront plus tard puissent créer des choses que nous ne pouvons pas même imaginer.

Plus que jamais d’actualité suite à l’annonce par WikiLeaks du début de la publication de 250 000 câbles diplomatiques américains, voici une (relativement) nouvelle chanson de Dan Bull, sous-titrée comme pour les précédents morceaux par la fine équipe : Koolfy plus Framalang.

Plus que jamais d’actualité suite à l’annonce par WikiLeaks du début de la publication de 250 000 câbles diplomatiques américains, voici une (relativement) nouvelle chanson de Dan Bull, sous-titrée comme pour les précédents morceaux par la fine équipe : Koolfy plus Framalang.

Comme nous l’apprenait

Comme nous l’apprenait

Les licences Creative Commons sont flexibles et puissantes. Extension naturelle de la

Les licences Creative Commons sont flexibles et puissantes. Extension naturelle de la  En quelques mots, Nina Paley c’est cette jeune cinéaste américaine, qui, suite à une mésentente avec les ayants droits de la bande son d’une œuvre qu’elle remixait avec brio dans son long métrage «

En quelques mots, Nina Paley c’est cette jeune cinéaste américaine, qui, suite à une mésentente avec les ayants droits de la bande son d’une œuvre qu’elle remixait avec brio dans son long métrage «

Dans la série « projets Framasoft », je voudrais le FramaDVD. Et plus exactement le « FramaDVD École ».

Dans la série « projets Framasoft », je voudrais le FramaDVD. Et plus exactement le « FramaDVD École ».