Un évènement d’importance est passé totalement inaperçu la semaine dernière du côté des médias francophones (à l’exception notable de Numerama). Il faut dire qu’à priori cela ne nous concerne pas puisqu’il oppose un lobby américain à l’état indonésien.

Un évènement d’importance est passé totalement inaperçu la semaine dernière du côté des médias francophones (à l’exception notable de Numerama). Il faut dire qu’à priori cela ne nous concerne pas puisqu’il oppose un lobby américain à l’état indonésien.

Et pourtant, à l’heure de la mondialisation (de moins en moins heureuse), cet épisode est riche d’enseignements et annonce peut-être la fin de l’enfance et de l’innocence pour le logiciel libre.

« Ils » veulent la guerre économique et politique ? Alors ils l’auront ! Et tant qu’Internet demeurera neutre et ouvert, « nous » ne sommes en rien assurés de la perdre, quand bien même nous n’ayons pas la puissance financière de notre côté et la capacité à mobiliser un bataillon des meilleurs avocats à notre service[1].

En perdant un brin notre sang-froid, nous pourrions presque qualifier cela de « Choc des Civilisations 2.0 » !

Plantons le décor de ce qui ressemble au départ à une information trop grosse pour être vraie.

Compagnies aériennes, paradis fiscaux, organisations terroristes… nombreuses sont les listes noires, émanant d’organismes divers et variés (nationaux ou internationaux, publics ou privés). Ainsi en va-t-il du « Special 301 Report » qui provient du bureau s’occupant officiellement de la politique commerciale internationale des États-Unis (The Office of the United States Trade Representative ou USTR).

Ce rapport vise à examiner chaque année la situation de la protection et de l’application des droits de la « propriété intellectuelle » à l’échelle mondiale. Il classe ainsi les pays en trois catégories : « surveillance en priorité » (on y retrouve en 2009 par exemple la Chine, la Russie et, plus surprenant, le Canada), « surveillance inférieure » et les autres, les bons élèves (cf cette mappemonde Wikipédia).

C”est un instrument de la politique économique internationale des États-Unis, et gare à vous si vous êtes en haut de la pyramide. Parce que vous fabriquez de fausses chaussures Nike, parce que vous produisez des médicaments sans y avoir autorisation, parce que vous proposez, dans la rue ou sur vos serveurs, des versions « piratés » de tel film, musique ou logiciel, etc.

Que la contrefaçon, la copie illégale, le non respect des brevets… fassent du tort à une économie américaine qui repose beaucoup sur l’exploitation de sa « propriété intellectuelle » et constituent par là-même un grand manque à gagner, nul ne le conteste. Qu’adossés à l’USTR on trouve un certain nombre d’associations qui agissent comme des lobbys en poussant le gouvernement américain à faire pression sur les pays incriminés pour qu’ils prennent les mesures nécessaires afin d’améliorer la situation, c’est de bonne guerre, d’autant que l’on connait l’influence et la force de persuasion des États-Unis dans la géopolitique internationale.

Mais que, tenez-vous bien, la volonté d’un état à développer le logiciel libre dans son pays en fasse un ennemi des intérêts américains de la « propriété intellectuelle » propre à vouloir le faire figurer en bonne place dans le « Special 301 Report », c’est nouveau, c’est scandaleux, et c’est ô combien révélateur des craintes, pour ne pas dire de la panique, qu’il suscite désormais dans l’économie « traditionnelle » de la connaissance.

C’est pourtant ce que n’a pas hésité à suggérer la très sérieuse et puissante International Intellectual Property Alliance (ou IIPA), coalition d’associations représentants les plus grandes multinationales des secteurs de la culture, du divertissement et des nouvelles technologies. On y retrouve ainsi le RIAA pour l’industrie musicale (Universal, Warner…), le MPAA pour le cinéma (Walt Disney, Paramount…), l’IFTA pour la télévision, l’ESA pour le jeu vidéo (Electronic Arts, Epic Games…) sans oublier la BSA pour l’informatique (Apple, Microsoft…).

Donc ici l’Inde, la Brésil et surtout l’Indonésie sont pointés du doigt pour la simple et (très) bonne raison qu’ils souhaitent favoriser l’usage du logiciel libre au sein de leur administration ! Vous avez bien lu, mis à l’index non pas parce qu’on veut l’imposer (ce qui aurait pu alors se discuter) mais juste parce qu’on souhaite l’encourager !

Plus c’est gros mieux c’est susceptible de passer, comme dirait le dicton populaire. Mais quels sont alors les (pseudos) arguments avancés ? Vous le saurez en parcourant l’article ci-dessous, traduit du journal anglais The Guardian.

On veut clairement nous abuser en nous faisant croire qu’il y a la « propriété intellectuelle » d’un côté et le logiciel libre de l’autre (qui tel Attila détruirait toute valeur marchande sur son passage). C’est de la propagande économique mais ne nous y trompons pas, c’est également éminemment politique puisque derrière cette initiative se cache une certaine conception du libéralisme et du rôle des états, où vieille Europe et monde anglo-saxon ne sont d’ailleurs pas forcément toujours sur la même longueur d’onde.

Cet épisode est évidemment à rapprocher avec ce qui se passe en ce moment du côté de l’ACTA.

L’ironie de l’histoire (outre le fait que le logiciel libre soit « né » aux USA), c’est que le Framablog passe son temps à patiemment ajouter des pays à sa propre liste blanche des institutions légitimement intéressées par les logiciels, les contenus et les formats libres et ouverts : Suisse, Angleterre, Canada, Brésil, Équateur, Amérique latine… sans oublier les États-Unis d’Obama qui n’en sont plus à un paradoxe près.

La liste est blanche pour certains et noire pour d’autres. Un nouvel échiquier se dessine, et la partie peut alors commencer…

Vous utilisez l’open source ? Vous êtes un ennemi de la nation !

When using open source makes you an enemy of the state

Bobbie Johnson – 23 Février 2010 – The Guardian Blog Technology

(Traduction Framalang : Tinou et Goofy)

Le lobby du copyright aux États-Unis s’est longtemps battu contre les logiciels open source – c’est maintenant au tour de l’Indonésie d’être dans la ligne de mire pour avoir poussé à leur utilisation dans les institutions gouvernementales.

Nous ne sommes que mardi, et cette semaine s’est déjà révélée intéressante pour les droits numériques. Le gouvernement britannique a reformulé sa proposition controversée de riposte graduée, et le traité secret de lutte contre la contrefaçon, l’ACAC (NdT : ou ACTA en anglais), fait de nouveau les gros titres. Pendant ce temps, un juge américain est encore en train de délibérer dans l’affaire Google Books.

Et comme si cela ne suffisait pas, voilà une nouvelle pierre à ajouter à l’édifice branlant des dernières nouvelles, grâce à Andres Guadamuz, professeur de droit à l’université d’Édimbourg.

Suite à des recherches, Guadamuz a découvert qu’un lobby influent demande, en substance, au gouvernement des États-Unis de considérer l’open source comme l’équivalent de la piraterie — voire pire.

Pardon ?

Il apparaît que l’Alliance Internationale pour la Propriété Intellectuelle (NdT : International Intellectual Property Alliance ou IIPA en anglais), groupe qui allie des organisations comme la MPAA et la RIAA, a demandé au représentant américain au commerce d’envisager d’inclure des pays comme l’Indonésie, le Brésil et l’Inde dans sa « Liste de surveillance n°301 », parce qu’ils utilisent des logiciels libres.

Qu’est-ce que la « Liste de surveillance n°301 » ? C’est un rapport sur « le respect réel de la propriété intellectuelle » dans le monde – en réalité une liste de pays que le gouvernement des États-Unis considère comme des ennemis du capitalisme. Elle est souvent utilisée comme moyen de pression commerciale — souvent dans le domaine de l’industrie pharmaceutique et de la contrefaçon — pour essayer de forcer les gouvernements à changer d’attitude.

On pourrait avancer qu’il n’est pas surprenant de la part du représentant américain au commerce — supposé militer pour un capitalisme de l’économie de marché — de ne pas aimer pas les logiciels libres, mais la situation n’est pas aussi simple.

Je sais bien qu’on a tendance à rattacher l’open source aux idéaux socialistes, mais je pense aussi que c’est un exemple de l’économie de marché en action. Quand les entreprises ne peuvent pas jouer contre des concurrents écrasants, elles contournent le problème et trouvent d’autres moyens de réduire les coûts pour rester dans la course. La plupart des logiciels libres, qui n’appartiennent pas à des états, se contentent de pousser la logique de la réduction du coût jusqu’à son terme et se servent de la gratuité comme d’un bâton pour taper sur la concurrence (iriez-vous accuser Google, dont le produit phare est gratuit, d’être anti-capitaliste ?).

Ceci dit, dans les pays où le gouvernement a légiféré en faveur de l’adoption de logiciels libres et/ou open source, cette tactique ne manque pas de cohérence, puisqu’elle attaque des acteurs comme Microsoft. Mais ce n’est pas tout.

Là où ça devient intéressant, c’est que Guadamuz a découvert que les gouvernements n’ont même pas besoin de légiférer. Une simple recommandation suffit.

L’année dernière, par exemple, le gouvernement indonésien a envoyé une circulaire à tous ses ministères et aux entreprises nationales, les incitant à utiliser des logiciels libres. Selon l’IIPA, il « encourage les agences gouvernementales à utiliser des logiciels libres ou open source, avec l’objectif d’en avoir terminé le déploiement fin 2011. On aboutira ainsi, selon la circulaire, à un usage légitime de logiciels libres, ainsi qu’à une réduction générale des coûts en logiciel ».

Rien de grave là-dedans, non ? Après tout, le gouvernement britannique a déclaré qu’il mettrait le turbo sur l’usage de logiciel open source.

Mais l’IIPA suggère que l’Indonésie mérite sa place sur la liste n°301 parce qu’encourager (et non forcer) de telles initiatives « affaiblit l’industrie du logiciel » et « ne contribue pas au respect des droits relatifs à la propriété intellectuelle ».

Extraits de la recommandation :

« La politique du gouvernement indonésien (…) affaiblit l’industrie du logiciel et sabote sa compétitivité à long terme en créant une préférence artificielle pour des sociétés qui proposent des logiciels open source et des services dérivés, et va même jusqu’à refuser l’accès du marché gouvernemental à des entreprises reconnues.

Au lieu de promouvoir un système qui permettrait aux utilisateurs de bénéficier de la meilleure solution disponible sur le marché, indépendamment du modèle de développement, elle encourage un état d’esprit qui ne reconnaît pas à sa juste valeur la création intellectuelle.

Ainsi, elle échoue à faire respecter les droits liés à la propriété intellectuelle et limite également la capacité du gouvernement ou des clients du secteur public (comme par exemple les entreprises nationales) à choisir les meilleures solutions. »

Oublions que cet argument ne tient pas compte du grand nombre d’entreprises qui prospèrent autour du modèle du logiciel open source (RedHat, WordPress et Canonical, pour ne citer qu’eux). Au-delà de ça, voici ce qui me paraît stupéfiant : il suffit de recommander des produits open source — produits qui peuvent être facilement taillés sur mesure sans affecter les règles définies par la licence — pour être accusé de vouloir tout « saboter ».

En fait, la mise en œuvre du respect de la propriété intellectuelle est souvent plus stricte dans la communauté open source, et ceux qui enfreignent les licences ou oublient d’attribuer les crédits à qui de droit sont souvent cloués au pilori.

Si ce que vous lisez vous met hors de vous, vous avez raison. C’est abracadabrant. Mais l’IIPA et l’USTR n’en sont pas à leur coup d’essai : il y a quelques années, ils ont mis le Canada sur leur liste des pays à surveiller en priorité.

Voici un récent article du Guardian qui tourne paradoxalement autour du logiciel libre et des formats ouverts mais sans véritablement les nommer.

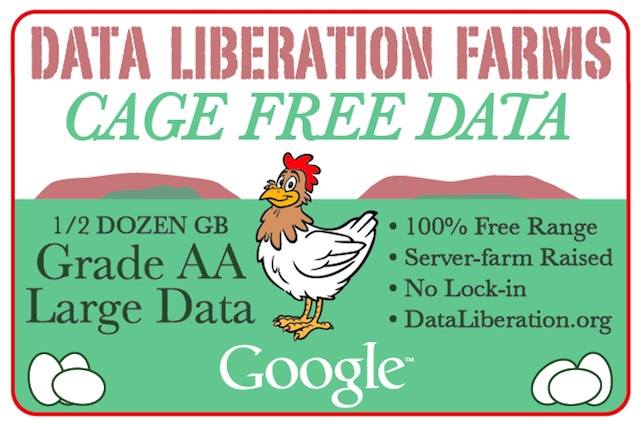

Voici un récent article du Guardian qui tourne paradoxalement autour du logiciel libre et des formats ouverts mais sans véritablement les nommer. Google fait peur et Google le sait. Alors Google fait de gros efforts pour tenter de nous rassurer.

Google fait peur et Google le sait. Alors Google fait de gros efforts pour tenter de nous rassurer.

Un évènement d’importance est passé totalement inaperçu la semaine dernière du côté des médias francophones (à l’exception notable de

Un évènement d’importance est passé totalement inaperçu la semaine dernière du côté des médias francophones (à l’exception notable de  Le 21 mars 2010 aura lieu la dixième édition de l’initiative

Le 21 mars 2010 aura lieu la dixième édition de l’initiative

En décembre dernier

En décembre dernier