Temps de lecture 4 min

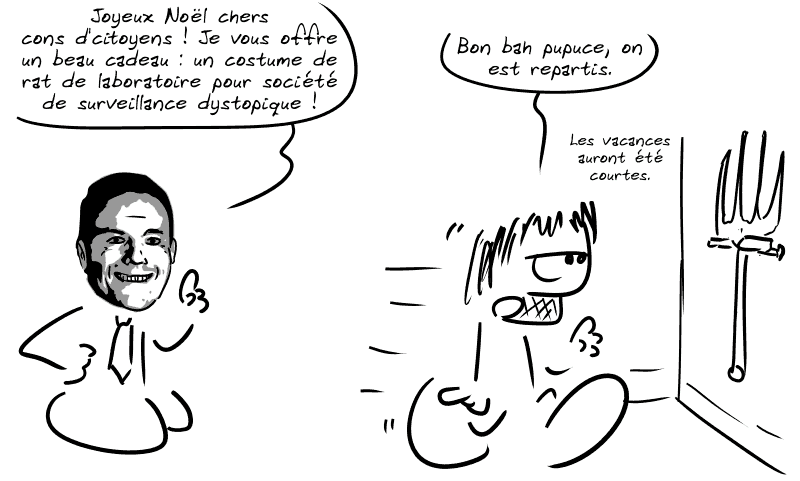

Aujourd’hui, Gee et ses grises bouilles nous causent de reconnaissance faciale, un sujet évoqué par le gouvernement entre le foie gras et la dinde de Noël comme si de rien n’était…

Reconnaissance faciale

Cédric O, secrétaire d’État au Numérique, a annoncé le 24 décembre qu’il souhaitait « ouvrir une phase d’expérimentation » de la « reconnaissance faciale en temps réel sur les images de vidéosurveillance ».

De nombreuses associations dont la Ligue des Droits de l’Homme et la Quadrature du Net se sont élevées contre ce projet.

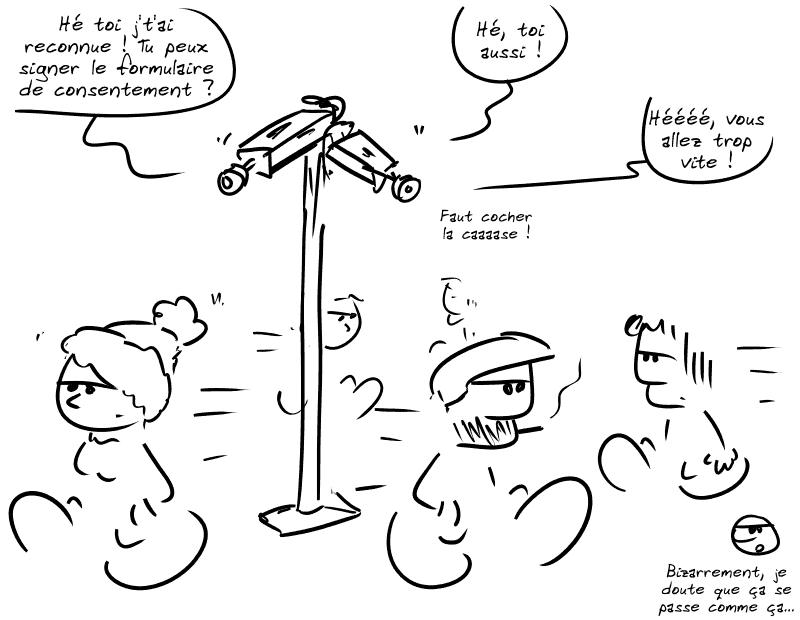

La reconnaissance faciale est déjà utilisée par les forces de l’ordre pour l’authentification de suspects via le fichier TAJ (Traitement des Antécédents Judiciaires), mais l’automatisation du processus et sa généralisation à l’ensemble de la population seraient des violations flagrantes de la RGPD…

La CNIL s’est déjà opposée à une expérimentation de ce type au lycée des Eucalyptus à Nice, considérant que la technologie était légèrement disproportionnée par rapport au but recherché – sécuriser l’accès à l’établissement.

Ce qu’on pourrait faire plus simplement et sans déféquer sur la vie privée de mineurs.

Genre avec des badges.

Justement : quel est le pire dans tout cela ?

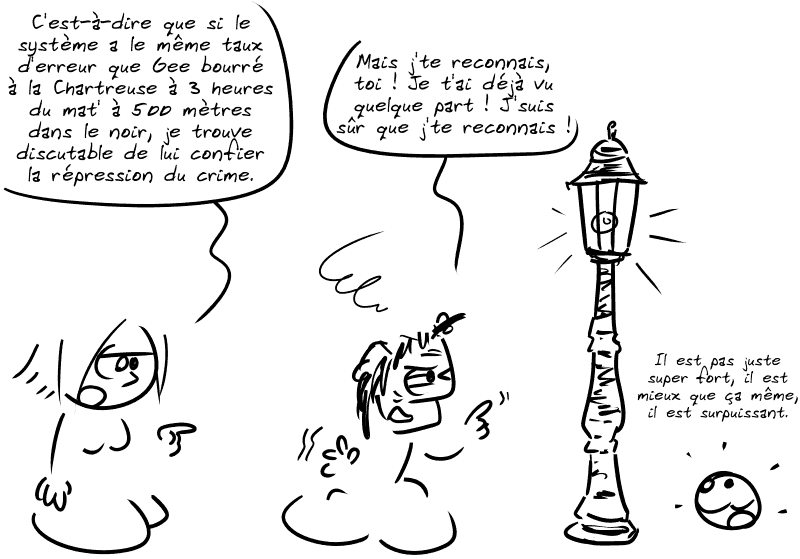

C’est que ça ne marche pas.

L’Université d’Essex a publié une étude montrant que le système de reconnaissance faciale londonien utilisé pour repérer les personnes suspectées de crime dans la foule présentait un taux d’erreur de…

81 %.

Notez par ailleurs que si la reconnaissance faciale marchait à 100 %, ce serait tout aussi flippant mais pour d’autres raisons.

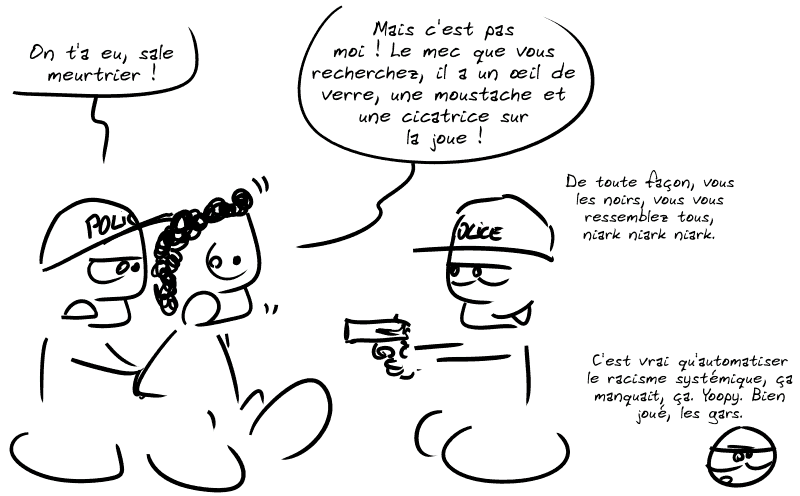

Ajoutons à cela que ce sont des systèmes basés sur de l’apprentissage automatique qui utilise des bases de données reproduisant les biais présents dans ces bases… comme le fait de n’entraîner quasiment que sur des personnes blanches, au hasard.

Les personnes asiatiques ou noires sont ainsi identifiées par erreur 100 fois plus souvent que les personnes blanches d’après une étude du NIST (National Institute of Standards and Technology).

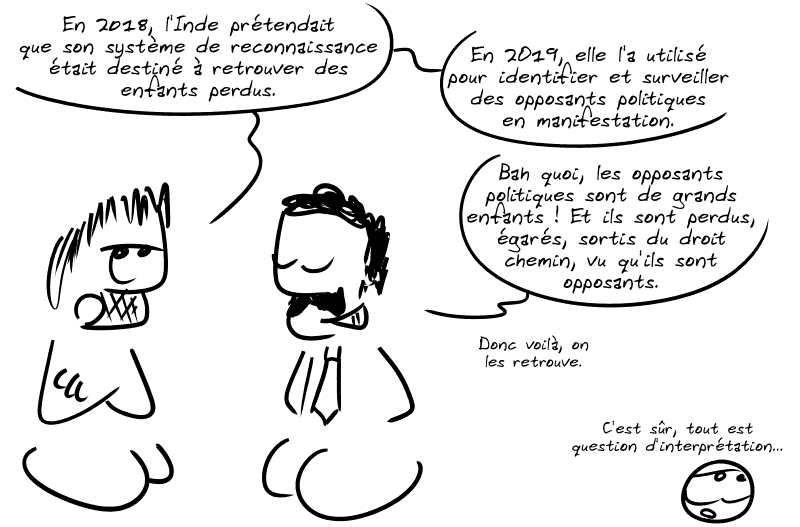

Il y a urgence à empêcher nos gouvernants-savants-fous d’ouvrir la boîte de Pandore, car une fois un tel système mis en place, la question ne sera plus de savoir s’il sera utilisé à mauvais escient, mais QUAND il le sera, et dans quelles proportions.

Et s’il ne fait aucun doute que des techniques pour y échapper se mettront vite en place, ne sous-estimons pas le danger sous prétexte que nous vivrions dans de soi-disant États de droit.

En 2019, un Londonien s’est pris 90 livres d’amende pour avoir délibérément couvert son visage pour échapper à cette reconnaissance.

Alors pourquoi ce genre de technologie devient soudaine-ment un sujet en France ? Obsession sécuritaire ? Volonté d’instaurer pas à pas d’une société de surveillance généralisée ?

Eh bien pas seulement.

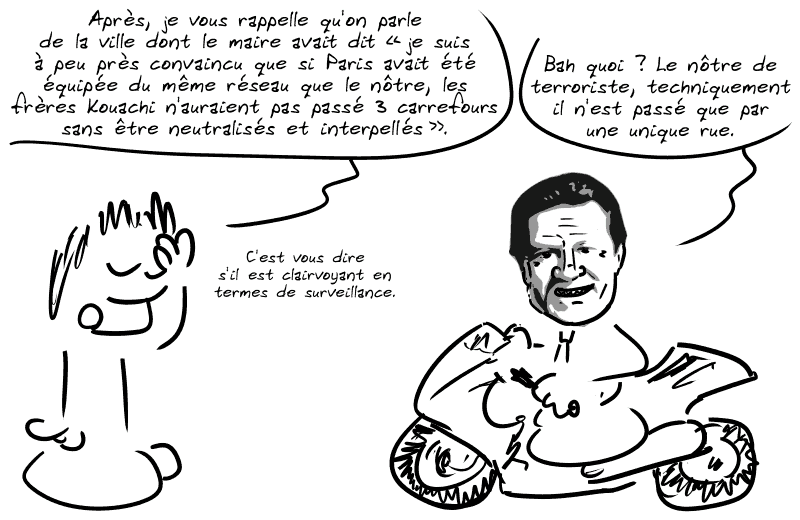

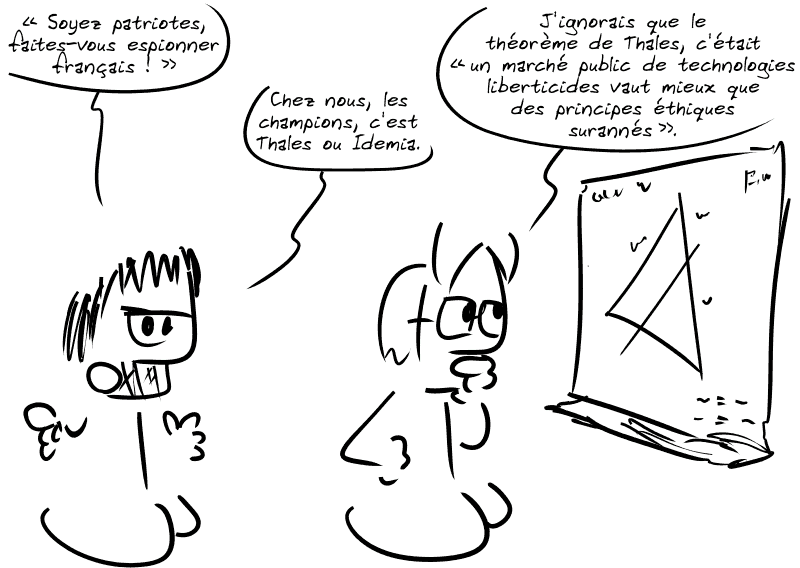

Ce sont comme souvent des intérêts industriels qui sont en jeu.

Face aux géants américains du capitalisme de surveillance que sont Google, Amazon et cie, les industries européennes espèrent tirer leur épingle du jeu en développant des technologies de pointe de surveillance pour les revendre au plus offrant, c’est-à-dire à des gouvernements peu scrupuleux (comme le nôtre).

Idemia, par exemple, vend MorphoFACE, une « solution de reconnaissance faciale et de vérification d’identité » développée à la base par Safran.

Safran, entreprise où Cédric O, le fameux secrétaire d’État en charge du Numérique à l’origine de ce soudain intérêt pour la reconnaissance faciale, a travaillé jusqu’en mai 2017.

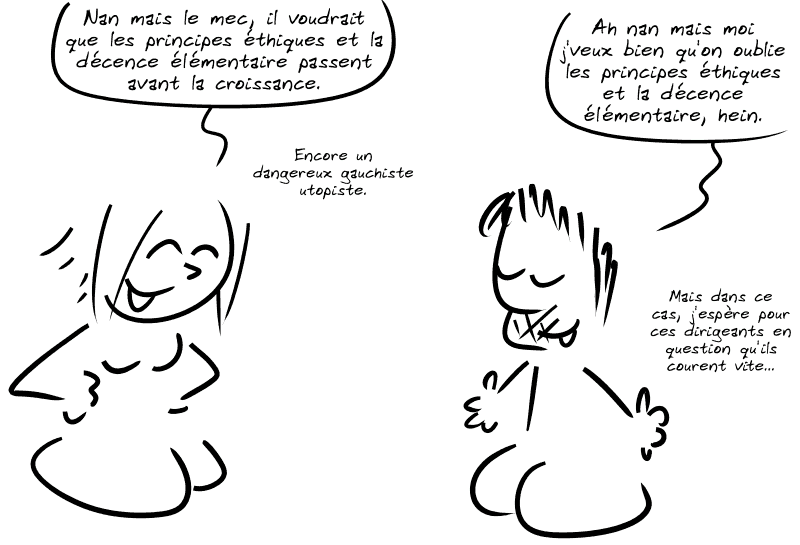

Bref, on avait compris depuis longtemps que la Main Invisible et l’autorégulation du Saint Marché Ouvert aboutissait en général à des niveaux d’éthique autorisant à vendre du beurre aux nazis si ça permettait de gagner 0,1 point de croissance.

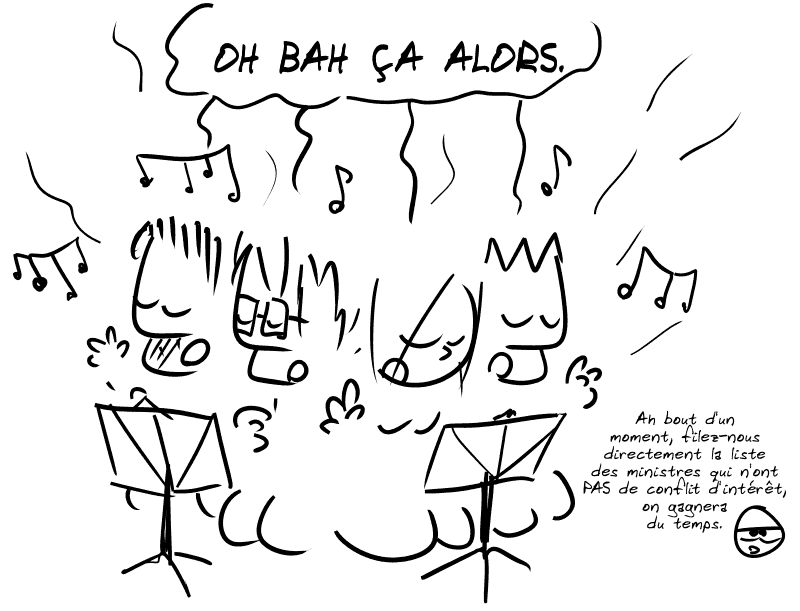

Si les guignolos trempés jusqu’au cou dans les intérêts de grandes entreprises d’intérêt pas-du-tout-public qui nous servent de dirigeants pouvaient au moins faire semblant de nous en protéger, ce serait bien aimable.

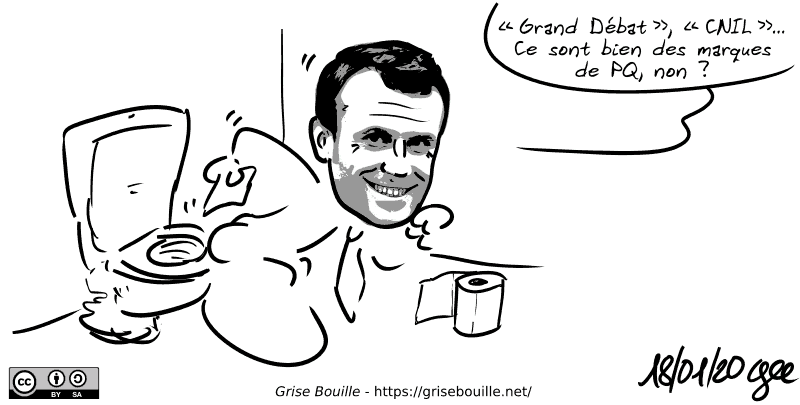

Pour finir, pour faire passer la pilule, on nous annonce qu’un débat sera organisé à l’issue de l’expérimentation, sur le modèle du Grand Débat lancé pour désamorcer le mouvement des gilets jaunes (Grand Débat dont on a pu constater l’IMMENSE utilité et l’IMMENSE capacité à influer sur le cap politique de nos aristocrates).

Sans vouloir avoir l’air pessimiste, si les conclusions de ce débat sont du même tonneau que les avertissements de la CNIL, j’ai une petite idée de l’usage que leur réservera le pouvoir :

Sources :

- Reconnaissance faciale : nos droits et nos libertés ne sont pas à vendre ! (Libération)

- Reconnaissance faciale : pourquoi le projet du gouvernement inquiète (Usbek & Rica)

- Un Anglais écope d’une amende car il se cache d’une caméra de reconnaissance faciale (Le Figaro)

- Reconnaissance faciale en temps réel : « Nous ne voulons pas l’encadrer, nous voulons l’interdire » (Korii)

- https://www.20minutes.fr/high-tech/2642419-20191104-reconnaissance-faciale-outil-surveillance-masse-va-deshumaniser-rapports-sociaux-estime-quadrature-net (20 Minutes)

Crédit : Gee (Creative Commons By-Sa)

bobo38

toujours cool et bien senties ces BDs!!