Temps de lecture 5 min

Google va ajouter de l’IA générative dans Gmail et Docs. Énième actualité d’un feuilleton permanent depuis « l’irruption » de ChatGPT. Et chez moi, un sentiment de malaise, d’incompréhension, et même de colère.

Qu’est-ce que ChatGPT ? Qu’est-ce que l’IA1 ? Ce sont d’abord d’immenses infrastructures : les câbles sous-marins, les serveurs des datacenters, mais aussi nos ordinateurs et nos smartphones. Donc ce sont des terres rares et des minerais, dégueulasses à excaver et à purifier (heureusement un jour il n’y en aura plus2). Ensuite, c’est du traitement MASSIF de données. Du vrai gavage de programmes d’apprentissages par des quantités phénoménales de données. C’est donc des infrastructures (encore) et de l’énergie. Une quantité phénoménale d’énergie, très largement carbonée. Enfin, c’est beaucoup de main-d’œuvre sous-payée pour entraîner, tester, et entretenir les systèmes d’IA. ChatGPT, il ne faut pas l’oublier, ce n’est que la face émergée d’un très très gros iceberg. Très gros et très sale.

Ce n’est pas un film. ÇA, c’est l’ambiance dans une mine de cobalt.

Image issue du documentaire d’Arte : Cobalt, l’envers du rêve électrique

Bref, développer une IA a un coût environnemental et humain énorme (et largement opaque), ce n’est pas que du code informatique tout propre. À la rigueur, si le rapport coût/bénéfice était largement positif… Par exemple, si l’IA développée permettait des économies d’énergie de 30 % dans le monde, ou qu’elle permettait de mieux gérer les flux alimentaires et donc d’endiguer la faim, alors on pourrait sérieusement discuter de moralité (est-ce acceptable de détruire la planète et d’exploiter des humains pour sauver la planète et d’autres humains ?).

Mais à quoi servent ces IA génératives ? Pour le moment, à faire joujou, principalement. À chanter les louanges de l’innovation, évidemment. À se faire peur sur l’éternelle question du dépassement de l’humain par la machine, bien sûr. Et ensuite ? Supprimer des postes dans des domaines plutôt créatifs et valorisés ? Défoncer les droits d’auteur en pillant leur travail via des données amassées sans régulation ? Gagner un peu de temps en rédigeant ses mails et ses documents ? Transformer encore un peu plus les moteurs de recherche en moteurs de réponses (avec tous les risques que ça comporte) ? Est-ce bien sérieux ? Est-ce bien acceptable ?

Tout ça me laisse interrogateur, et même, en pleine urgence environnementale et sociale, ça me révolte. À un moment, on ne peut pas continuer d’alerter sur l’impact environnemental réel et croissant du numérique, et s’enthousiasmer pour des produits comme ChatGPT et consorts. Or souvent, ce sont les mêmes qui le font ! Ce qui me révolte, c’est que toute cette exploitation humaine et naturelle3, inhérente à la construction des Intelligences Artificielles, est tellement loin de ChatGPT que nous ne la voyons pas, ou plus, et nous ne voulons pas la voir. Cela se traduit par tous les messages, enthousiastes et même volubiles, postés quotidiennement, sans mauvaise intention de la plupart de leurs auteur⋅ice⋅s.

Symboliquement, je propose de boycotter ces technologies d’IA génératives. Je ne suis heureusement pas utilisateur de Google et Microsoft, qui veulent en mettre à toutes les sauces (pour quoi faire ?). J’espère que mes éditeurs de services numériques (a priori plus éthiques) ne céderont pas un pouce de leurs valeurs à cette hype mortifère…

Pour poursuivre sa lecture et ses réflexions

- Intelligence artificielle : Nous n’avons pas besoin de plus de contenus, mais de meilleures analyses

- Cobalt, l’envers du rêve électrique

- Ruée minière au XXIè siècle : jusqu’où les limites seront-elles repoussées ? – Aurore Stephant à USI

- La responsabilité chez Fairphone – Agnès Crépet & Alix Dodu – Ethics by design 2020

- Anatomy of an AI system, Kate Crawford and Vladan Joler

- The carbon impact of artificial intelligence

- ? Fondamentalement, l’intelligence artificielle est un mot-valise marketing qui regroupe « l’ensemble de théories et de techniques mises en œuvre en vue de réaliser des machines capables de simuler l’intelligence humaine ». Aujourd’hui, quand on parle d’IA, on parle surtout de programmes d’apprentissages automatiques et d’apprentissage profond. ChatGPT est quant à lui qualifié de modèle d’IA générative, entraîné par apprentissage supervisé et apprentissage par renforcement

- À ce sujet, regarder ce genre de vidéo : Ruée minière au XXIè siècle : jusqu’où les limites seront-elles repoussées ? Aurore Stephant à USI

- Pour approfondir ce sujet, lire l’excellent Contre-atlas de l’intelligence artificielle, de Kate Crawford

Eléonore

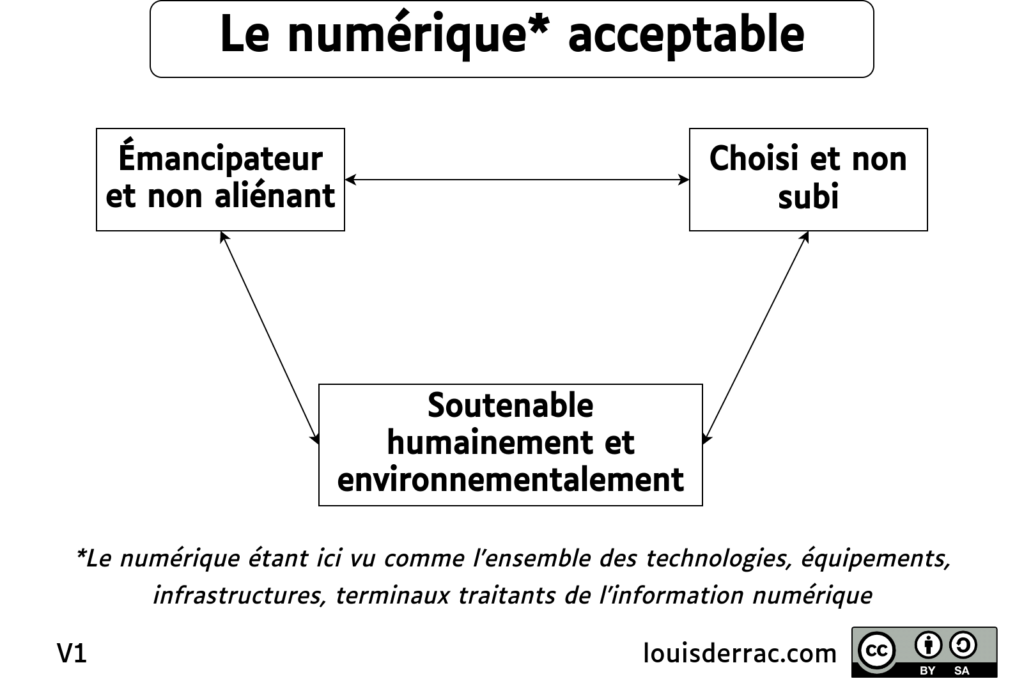

Ce que tu introduis là Louis appelle des kilomètres de lignes non générées par des IA, mais bien par des humains ayant encore gardé le sens de la raison pour tenter de faire entendre raison à la secte des adorateurs de Mammon. Tout ce qui te révolte est légitime, sensé, pesé, argumenté. Mais comment lutter contre des rouleaux compresseurs qui nous incitent depuis plus de vingt ans à… JOUER ? Les technologies numériques ont fait de nous des joueurs, des gamers, des gamblers, des Peter Pan hallucinés, shootés à la dopamine. Ton numérique acceptable relève probablement d’une utopie qui ne convient pas aux habitants du mythe de la caverne mondiale. Pardon de casser l’ambiance, mais tant que l’incendie que le numérique contribue à attiser ne nous léchera pas explicitement les pieds, nous continuerons à détourner le regard et à faire mumuse sur nos dalles de pixels, bien incrustés dans nos rétines et nos neurones. Courage Messire Louis, la route est longue… tu connais la suite !

MELAMED

https://www.cachem.fr/nextcloud-26/

IA(s) dans Nextcloud

sucupira

c’est marrant mais je ne m’attendais pas à un tel article, je peux comprendre l’appel au boycott mais pas avec l’argumentation avancée, car le problème des IA utilisées ou mises en place actuellement, n’est pas un problème de technologie mais plus un problème d’usages et d’objectifs.

il faut que les ia soient au maximum opensources/libres et de ne pas dépendre des GAFAM et autres BATX.

car de toute façon, c’est trop tard le mouvement est lancé, a accéléré et on ne peut plus l’arrêter sauf problèmes mondiaux (guerres, catastrophes, …).

donc il ne faut pas laisser la maitrise de ces outils à un secteur/groupe/entité/…

Louis Derrac

Bonjour,

Merci pour votre commentaire. On a le droit de ne pas être d’accord 🙂 Personnellement je pense que les IA types LLM, quel que soit leur usage final, ne sont pas soutenable humainement et environnementalement. Elles ne sont pas et ne peuvent pas être éthiques. Mais en effet, comme vous dites, le mouvement est lancé. Il va falloir maintenant réfléchir à comment limiter la casse sociale, humaine et environnementale…

EM

« Une quantité phénoménale d’énergie, très largement carbonée. »… sans aucun chiffre, graphique, source, citation ? Je ne dis pas que c’est forcément faux, mais à un moment si on se met tous à écrire des billets de blog sans citer le moins argument pour prouver ce qu’on avance, ça n’est guère plus que de la pollution intellectuelle.

Louis Derrac

Bonjour,

Les chiffres sont de plus en plus nombreux (malgré l’opacité du secteur) et à retrouver si vous le souhaitez sur les sites de l’ADEME, de l’INR, ou encore du Shift Projet. J’ai également cité l’ouvrage de Kate Crawford, qui est extrêmement bien documenté. Vous avez aussi cet article ou encore celui-ci. Ce billet est un billet d’humeur, une opinion à visée réflexive et non un article scientifique, qui se devrait effectivement de chiffrer et sourcer chaque affirmation. Le fait que les infrastructures d’IA consomment énormément d’énergie (depuis les mines jusqu’aux entraînements machine), très largement carbonée, est quand même quelque chose d’assez consensuel.

Bonne journée,

Louis