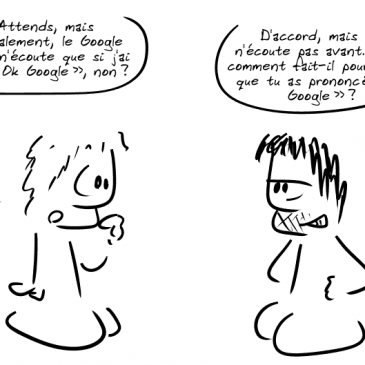

Quand l’actu singe Black Mirror

Lorsqu’il s’est penché sur l’actualité des GAFAM, comme il le fait souvent pour préparer ses BD, l’ami Gee n’a pas pu s’empêcher de trouver des similitudes entre certaines informations et une série d’anticipation fort populaire… Il vous livre le résumé … Lire la suite